HF:

https://huggingface.co/collections/zai-org/glm-45-687c621d34bda8c9e4bf503b

不错不错,今年我国的Ai技术大爆发了。更愿我国的Ai技术百花齐放,遥遥领先。

一超多强,我们国家要多超多强!

写一些我个人的关注点:

Air 的规模很接近Llama4-Scout,这个其实是一个之前被Qwen3漏掉的规模。量化的话能在4卡魔改4090/L20的机器上拿到一定的吞吐量,或者在有64GB+的PC上本地运行。

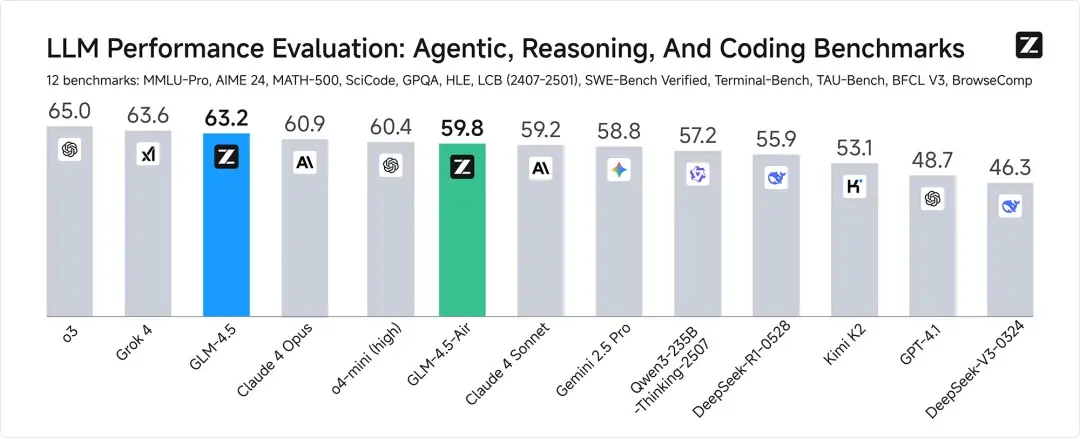

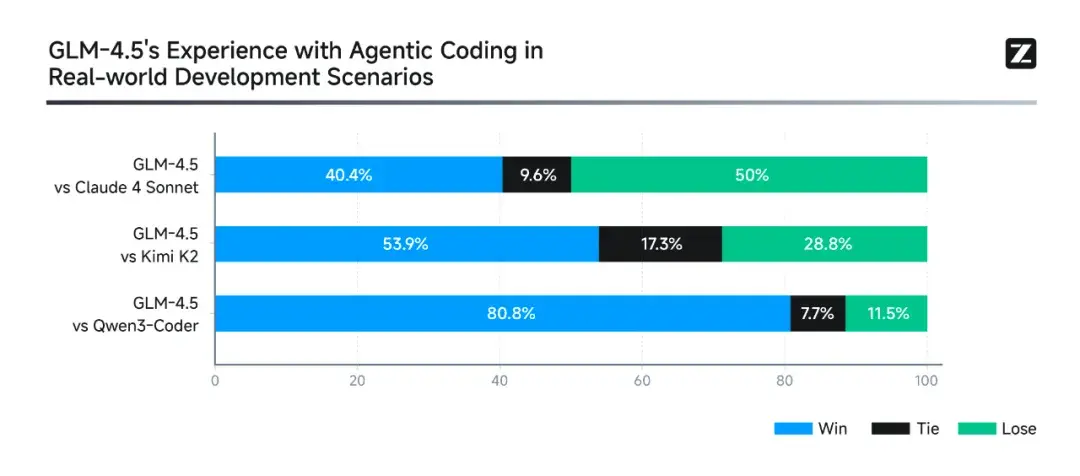

GLM-4.5的规模和Qwen3-480B直接竞争,可以观察一下主打的Agentic Coding性能。

模型训练方面值得关注的点是Muon + 比较常规的GQA(不是GLM4-0414的那种KV cache开销堪比MLA智谱 AI GLM 教程的极少KV head的设计)。

价格很美丽,据说普通版本能达到50tokens每秒,输出速度快确实爽,特别是用惯了ds再用智谱,跟飞起来一样。

还好智谱不怎么没宣发,不然全部人涌进来得卡到爆(bushi)

只能说,智谱体感是真的好强啊,除了没多模态简直是个六边形战士,无解的稳定输出质量高速度快。实测效果在 4.1 以上水准,非常合格。输出稳定质量高速度快,幻觉率极低,这次开源的 k2 没他快,千问没他稳定,两者没他价格便宜,实测体感他最强。

用了很多的大模型下来,还是觉得速度是非常重要的,毕竟都做小功能而已。复杂的目前claude3.7都吃力,更不用说其他模型了。

话说怎么感觉最近越晚出大模型的越强,什么奇怪的设定。

顺带还测试了用glm4.5网页版做的ppt,效果确实不错,能吊打国内其他一些模型,可惜就是不能导出pptx格式。代码方面看了据说还不错,但几次测试下来,不知是不是网页版 max tokens 给得太低了,没有一次代码是写完的,最多九百多吧,也有两三百就截断了的,而gemini是能最多输出2700行代码,再多就截断了,但说这方面好像gemini不错,但glm实验的次数不多,后续还有待考证。

至于处理文字和邮件信息方面,同时用千问/豆包/glm,感觉是glm的回复更好一点,之前写周报就经常用Copliot和智谱清言来偷懒。花几分钟列个大方向和框架,基本AI就能帮我扩展成一小篇周报了,然后再稍微润色下就可以交;省的每周五为周报发愁。

不过它也和其他国产模型一样,存在一个基本问题。

同个需求,qwencoder和glm都是做最基本的实现,虽然也实现了需求,但明显可见不够有深度,claude和gemini都会考虑更多的细节。这就导致项目稍微复杂一点报错就比gemini多几倍,从这个角度来讲,目前它并没有超越gemini。

不过也还好,毕竟现在ai工具的上新速度很快,像gpt4.5版本已经出一段时间,据说快要出5.0了。它也是比较靠前的一款,幻觉不太严重,回答又有条理。问它啥问题,不管是学习上的、工作上的,还是生活里那些稀奇古怪的事儿,它都能给你整出个头头是道的答案。

像AI Agent本地部署大师,它和“AI私房菜”没啥区别了,直接将ds、豆包那几个搬到本地去,都不用担心网络好不好的问题了,而且这个的回答也蛮厉害的,让它帮忙写个报告、分析个数据啥的,都不在话下。

最近还有这个Gemini也推出了新版本,它的上下文处理能力还不错,能应付一些比较复杂的任务,而且生成速度也相对较快,也是办公的一把手。

其实GLM的底子很好,早起 bug 有点多,后面基于这个版本迭代下去,很有希望越做越好。

不过glm一直都是主打一步一步慢慢来的,咱也不可能要求它一下子远超其他所有模型,只能说,有进步就好。

而且最近各家大模型都起来了其实是好事,前ds时代一回事,后ds时代要是起不来,等R2一来就完。

发布者:全栈程序员-站长,转载请注明出处:https://javaforall.net/265688.html原文链接:https://javaforall.net