[‘这篇文章,由AI一键直出⬆️’, ‘今天,智谱发布并开源了’, ‘GLM-4.6V多模态模型’, ‘,一个是向云端服务的106B基础版,一个是面向本地部署的9B轻量版。’, ‘模型下载:’, ‘

https://

huggingface.co/collecti

ons/zai-org/glm-46v

‘, ‘API调用平台:’, ‘

https://www.

bigmodel.cn

‘, ‘MCP调用入口:’, ‘

https://

docs.bigmodel.cn/cn/cod

ing-plan/mcp/vision-mcp-server

‘, ‘开头这篇文章,便是由GLM-4.6V-106B直接生成。’, ‘可以看到,GLM-4.6V除了在视觉理解上能够“看懂”多模态内容外,还具备工具调用能力(Function Call)能够直接做“执行”。’, ‘官方说,这是一个’, ‘原生具备多模态工具调用能力’, ‘的模型。比如,可以处理图文混排、识图购物、导购以及各种Agent场景的复杂视觉任务。’, ‘省流:’, ‘感知→理解→执行,都在一个推理链里完成,无需外部工程化。’, ‘一手实测’, ‘我知道,这么说,你可能还是没懂。下面,我们来看点实际的。’, ‘打开’, ‘Z.ai’, ‘,选择模型“GLM-4.6V”,根据任务需要选择合适的工具,开启“深度思考”,进行体验。’, ‘这里,简单分享几点技巧:’, ‘①建议所有场景都开启深度思考’, ‘,除非是明确的简单行为,比如OCR识别。’, ‘②不需要把所有工具都勾选’, ‘,建议根据自己的任务情况来选择。比如coding任务,它不太需要图像处理、图像搜索和购物搜索,那就把4个工具都关掉。’, ‘③’, ‘如果不知道自己需要什么样的工具,可以’, ‘点下方的胶囊入口’, ‘。’, ‘这里内置了6个场景:’, ‘识图搜图、图文扫描、文档解读、视频

智谱放大招!实测glm-4.6v,它也太会“看图做事”了

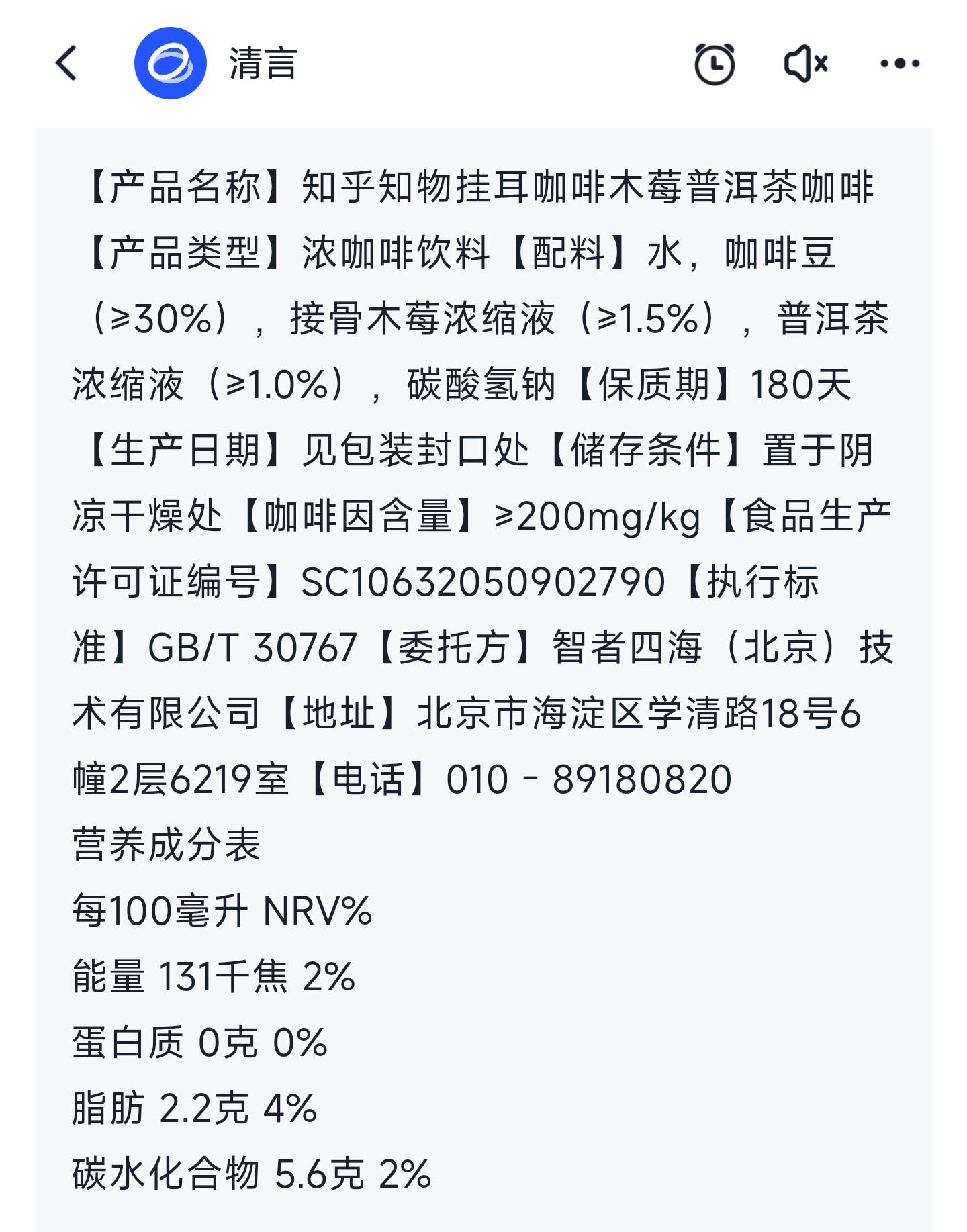

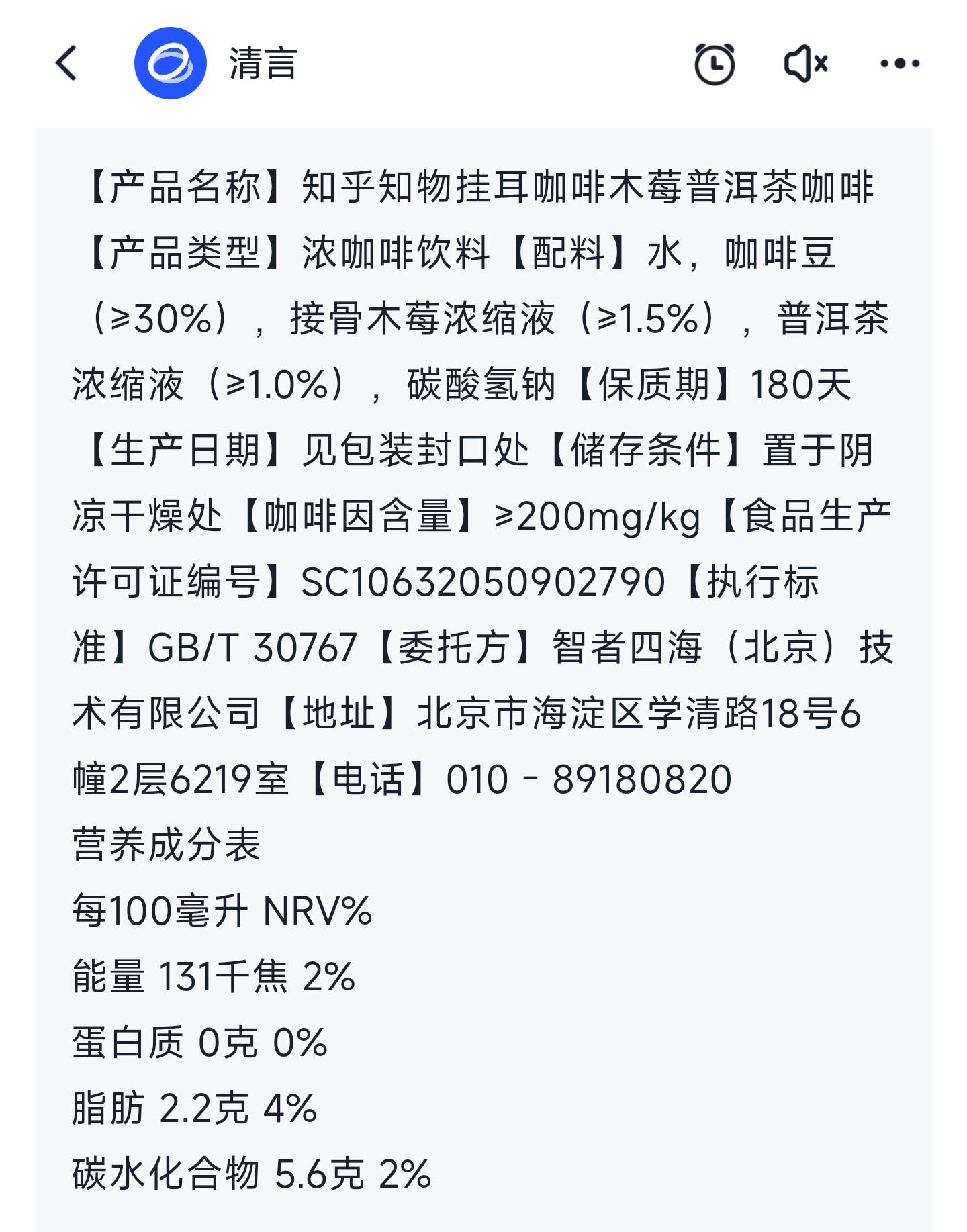

目前OCR,从图片中提取文字,千问和GLM-4.6V幻觉极少,几乎0幻觉。豆包开深度思考,还是胡说八道。

通过工具调用搜索识图,千问和GLM各有千秋,看各自的搜索源覆盖了,能搜到,大概率都能识别。GLM搜索会更积极一点,千问经常会摆烂。千问识图目前跟淘宝系有联动,可以识图后转购买链接。冷门内容,豆包调用工具后,识图翻车率依然很高。

在时间推理上,GLM翻车了,因为奇葩的理解方式,豆包估摸准了大概,千问依然稳如老狗。

综合来看,从图片识别和推理能力上看,千问还是一哥(甚至不用思考模式),GLM第二,豆包第三,元宝最差(不过,混元是有后手准备的)。

这个好,之前国内模型,我截了 bug 图片,都无法识别,基本不能用。

这次更新的glm4.6V,一个是视频理解功能,大部分模型现在还不支持这个功能,它可以告诉你视频里发生了啥。

上下文窗口128K, 这次的亮点是视觉理解的精度达到同级别 SOTA 水平+视觉原生工具调用能力,价格上比GLM-4.5V 还能便宜一半。

图像推理:我上传了一张电影演员合照,然后问了右上方一排的三个人演过啥电影, GLM 4.6正确,Gemini 发挥稳定,效果还行。

表格数据读取:弄了一张研报里的数据图, GLM-4.6 基本准确,Gemini发挥稳定。

又试了一个前端任务,直接找了 Runway 的页面发一张图让模型做一个一样的前端, GLM-4.6V 基本可以像素复刻。

不需要把图片转文字,它能直接用截图、文档、照片作为输入,对图表、搜索结果、渲染页面等视觉输出进行理解并加入推理过程。

初步测试下来,还是挺不错的。

当然肯定不能跟 Gemini 比。之前听说glm4.6 比肩 claude 我就试了一下拿他 agent。

当我看到它写成 using namespace 来解决包名错误的时候,我觉得编程这块可能还有较长的路要走。

当然也可能是每个人的体感不太一样。

我的脑子中基本对大模型 coding 的各种问题都相对清晰,哪怕提示词比较朴素,但基本都会落在一个比较明确的方向,不会让大模型去遍历所有的情况。

我自己的体验中,大部分的修改都是在一个相对可控的区间里面。

之前定了一个季度,用了一个多月了,我自己根本用不完。

但说实话 GLM4.6 还是不如 sonnet4.5,更不说 opus4.5 了。不过国内算是最强,性价比无敌。

发布者:Ai探索者,转载请注明出处:https://javaforall.net/270261.html原文链接:https://javaforall.net