我想本地搭建gpt主要用于小说推文辅助 当然是要开源模型 ,需要哪些模型 ,哪些流程

我还是个新手 还在学推文 本地搭建了sd 环境

网络上很多基于sd绘画的第三方软件都洗需要opai key 新手真的伤不起

你可能需要这个【RWKV—部署在本地的AI大模型,只需2G显存!人人都有拥有自己的AI!-哔哩哔哩】 https://b23.tv/Zqazfke

——奥,刚看到你要openai的api,那可能你需要国内的镜像,便宜实惠,3.5免费,4.0官方2折

你好,以下是基于大语言模型的知识库问答系统FastGPT的本地部署。希望能对你的问题有所帮助。(侵删)

FastGPT提供开箱即用的数据处理和模型调用功能,并支持通过Flow可视化界面进行工作流编排,实现复杂问答场景。FastGPT具备以下核心功能:

- 创建专属AI客服:通过导入文档训练,使模型能够以交互式对话方式回答问题。

- 直观的可视化界面:支持多种应用场景,操作简单,可轻松完成AI客服的创建和训练。

- 自动化数据处理:支持多种导入格式,自动完成文本向量化和QA分割,节省训练时间并提升效果。

- 工作流编排模块:可设计复杂问答流程,如数据库查询和库存管理。

- OpenAI接口兼容:可无缝集成现有GPT应用,也能轻松对接企业平台。

在本教程中,我们将部署一个使用本地模型、具备知识库和聊天功能的FastGPT系统。FastGPT支持多种部署方式,本次我们将使用Docker Compose进行部署。

部署前请确保: 1. 已安装并启用WSL功能 2. 已完成Docker、Docker Compose和WSL的安装配置

部署步骤如下: 1. 打开WSL终端 2. 执行命令创建Fast目录 3. 切换到Fast目录 4. 依次执行命令下载Docker Compose和配置文件

下载的文件将存储在此目录中,其中“username”需替换为您在安装Ubuntu时设置的用户名。若无法通过Curl命令下载文件,可从官网或Dock页面获取所需文件,并确保将其放置在此目录下。

接下来,请打开FastGPT目录中的Docker Compose文件,修改FastGPT配置项下的端口设置,将默认映射端口3000调整为3020。此端口修改的具体原因将在后续说明。

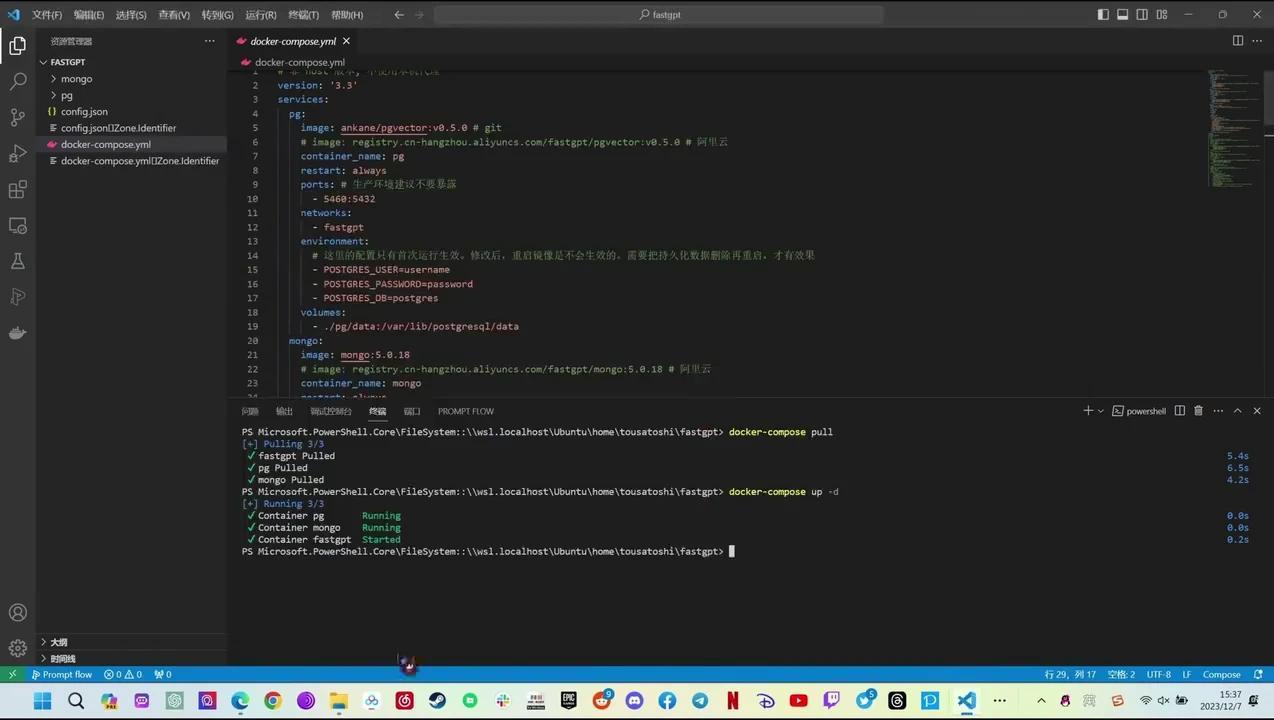

完成修改后,请启动PowerShell和Docker,执行以下命令以切换至已创建的FastGPT目录(请将”username”替换为您的实际用户名)。

输入该命令以拉取镜像。镜像拉取完成后,执行此命令在后台运行容器。容器启动后,在浏览器中输入指定链接即可访问FastGPT页面。

登录用户名为 Root,密码为 docker-compose 文件中的 DEFAULT_ROOT_PSW,默认密码为 1234。

若已拥有 OpenAI 的 API,可修改 docker-compose 文件中的 OPENAI_BASE_URL 和 CHAT_API_KEY。其中 OPENAI_BASE_URL 默认为 OpenAI 官方 URL,无需修改;只需在 CHAT_API_KEY 处填写您的 API 密钥即可。

修改文件后,请执行 docker-compose pull 和 docker-compose up 命令以更新配置。以上为使用 OpenAI API 运行 FastGPT 的方法。

接下来介绍本地模型的使用方式:

– 文件处理及聊天模型采用 ChatGLM-6B。

– 文本嵌入模型则使用 M3E-large 处理知识库。

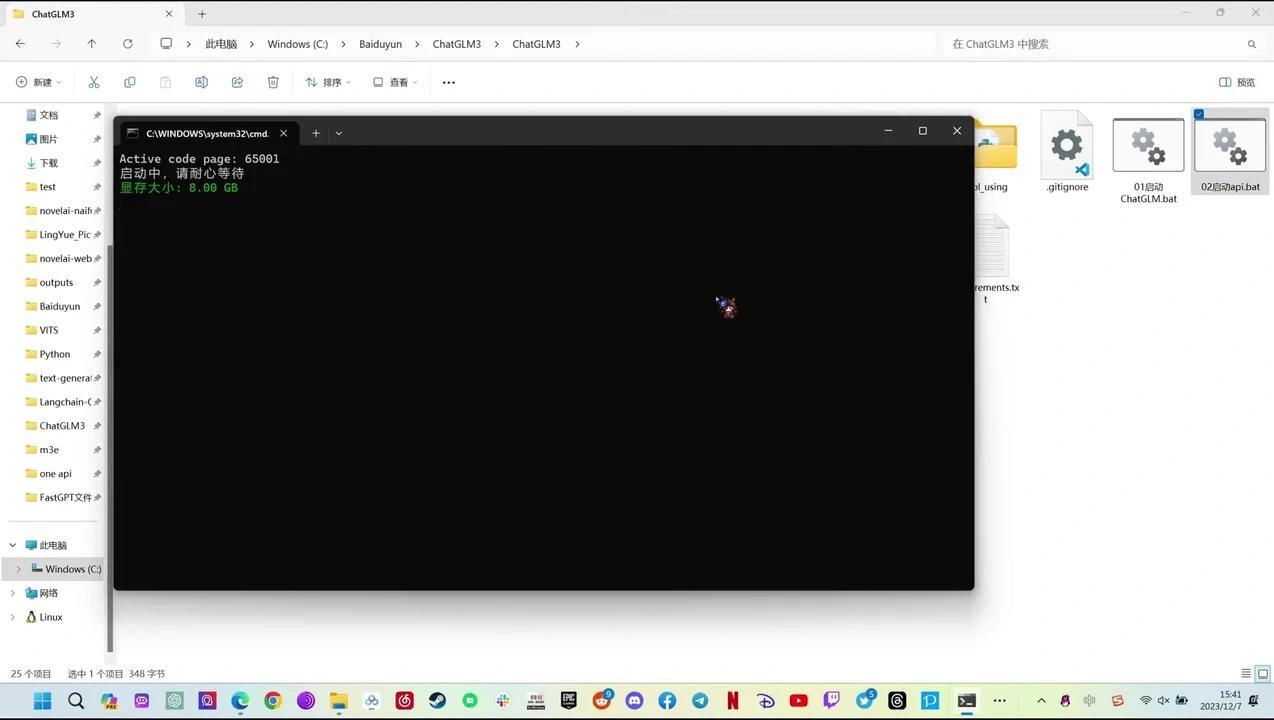

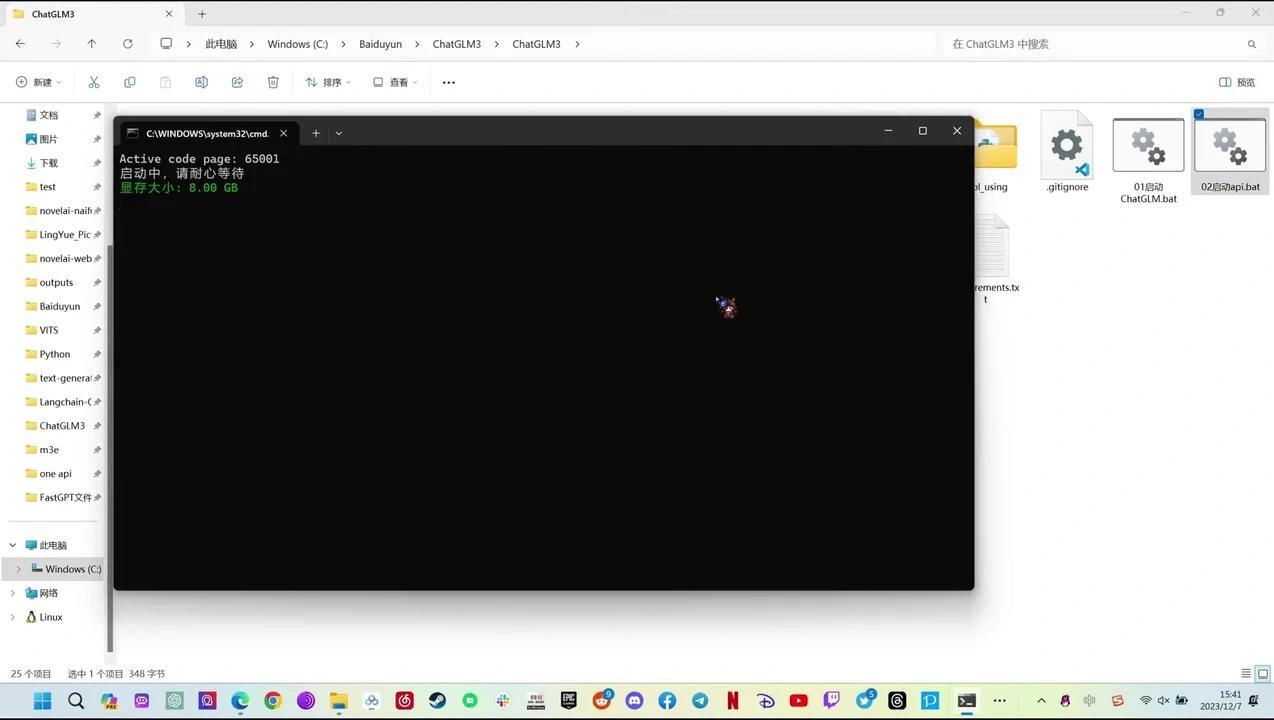

– ChatGLM-3 的部署可采用官方提供的一键脚本完成。

下载所有文件并解压至同一目录即可。

我们打开ChatGLM3文件夹内的02启动API.dat文件,即可通过API形式调用ChatGLM3。

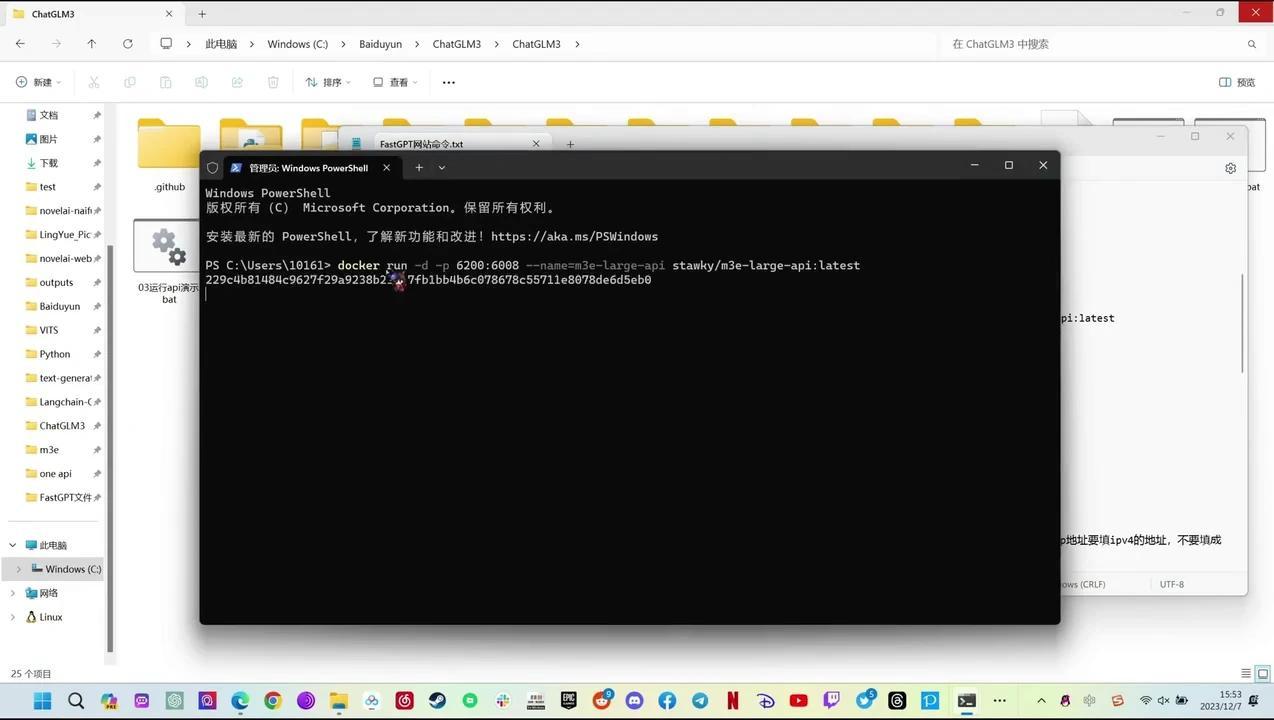

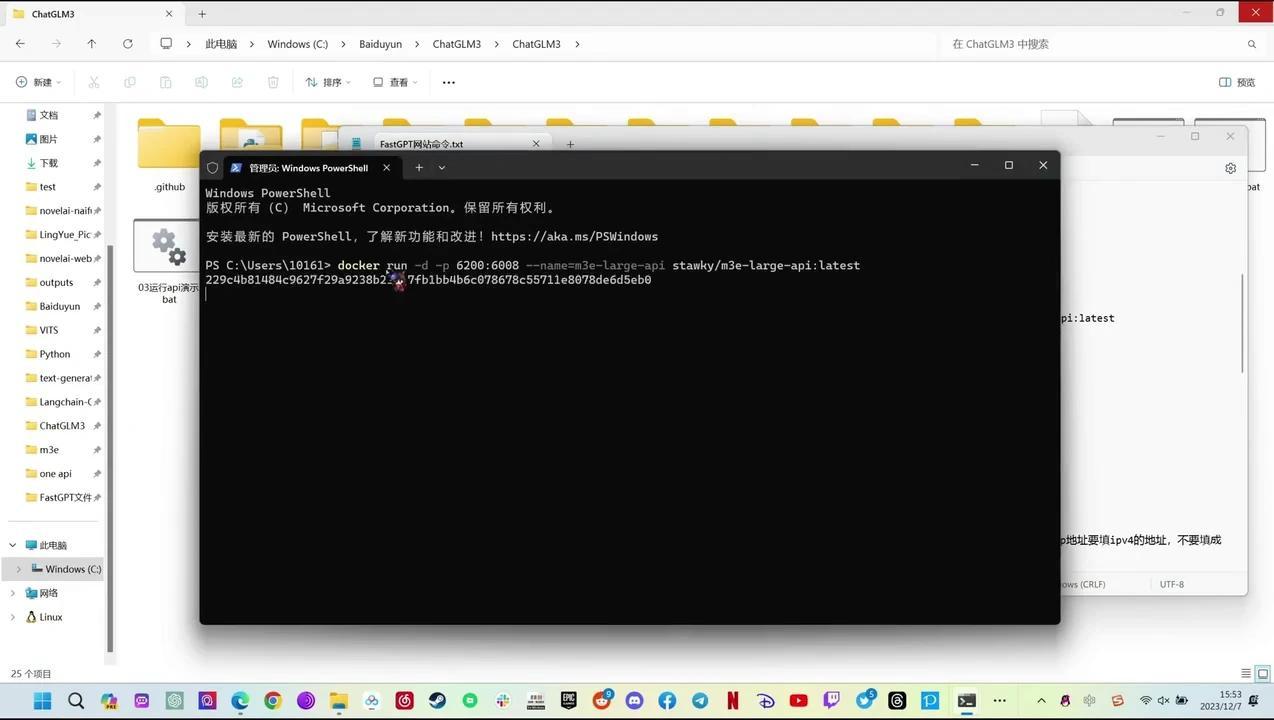

我们采用Docker部署M3E模型。

使用此命令可在后台启动新容器并下载镜像,默认采用CPU运行容器。

如需使用GPU运行,请执行以下命令。镜像默认采用国内源,但在拉取过程中发现两个镜像无法获取,因此切换至Docker Hub官方源。若遇国内镜像下载失败,建议尝试官方源。

需特别注意:若系统提示6008端口不可用,请检查端口配置。

这是由于启用 Hyper-V 后,系统启动时会随机保留部分端口,导致某些应用程序无法使用特定端口。

我们可以通过执行以下命令来检查被保留的端口范围。确认 608 端口 处于保留范围内后,将其修改为 6200 端口 即可解决问题。

运行完成后,m3e-large-api将在6200端口成功启动。

我们可以使用以下命令在 WSL 中测试 API。请注意,Local Host 需要替换为您的 IP 地址。IP 地址可在所连接网络的属性中查看,或在 CMD 中使用 IP Protocol Configuration 查看 WLAN 或 以太网 一栏。务必填写 IPv4 地址,而非 IPv6 地址。

目前 ChatGLM3 和 M3E 均已配置完成,我们可以将其 API 接入 OneAPI。OneAPI 通过标准 OpenAI API 接口管理语言,支持访问各类大模型。作为分发系统,它兼容多种大模型、第三方代理服务及自定义渠道。

接入 OneAPI 后,即可将其与 FastGPT 集成,由 FastGPT 调用 OneAPI,再由 OneAPI 调用本地的 ChatGLM3 和 M3E。此处我们使用 Dop 上预打包的 EXE 可执行文件,其中已包含 Docker 环境,无需额外部署,可直接运行。

OneAPI 程序将上传至网盘,下载链接会在评论区提供。下载完成后,启动程序并在浏览器中访问指定网站即可。

我们最初修改了FastGPT的端口,原因是OneAPI程序打包的Docker镜像默认占用了3000端口。为避免端口冲突导致FastGPT无法运行,因此需要调整端口设置。

当然,你也可以通过 Docker 部署 OneAPI 并自行修改端口。这里仅以最简单的方式运行 OneAPI。

打开 OneAPI 网页后,使用默认用户 Loot 和密码 登录,登录后请及时修改密码。

- 点击顶部菜单中的“渠道”,选择“添加新渠道”,将类型设置为“自定义渠道”。

- 在 BestURL 字段填入指定链接,并将 Localhost 替换为你的本地 IP 地址。

- 名称填写为 ChatGLM3,模型填入 ChatGLM3,然后点击提交。

- 提交 ChatGLM3 渠道后,点击测试按钮。若右上角显示“通道测试成功”,则表示运行正常。

- 请确保已启动 ChatGLM3 的 API 服务。

- 继续添加新渠道,类型同样选择“自定义渠道”。

- BestURL 填入指定链接,Localhost 替换为本地 IP 地址。

- 名称填写 M3E,模型填入 M3E,并在密钥字段填入相应内容。

- 提交后,点击顶部菜单中的“令牌”,选择“添加新令牌”。

- 名称可随意填写,勾选“永不过期”选项。

- 若仅供个人使用,可设置为无限额度,最后点击提交。

- 复制生成的令牌内容,选择第一个选项,然后打开文本编辑器,将复制的文本粘贴其中。

- 文本中的 URL 和 Key 将用于配置 FastGPT 的 docker-compose.yml 文件。

- 打开 docker-compose.yml 文件,找到 OpenAI_Base_URL 和 Chat_API_Key 字段。

- 在 OpenAI_Base_URL 中填入指定链接,并将 Localhost 替换为本地 IP 地址。

- 在 Chat_API_Key 字段填入之前复制的文本中的 Key 值。

- 完成修改后保存文件。

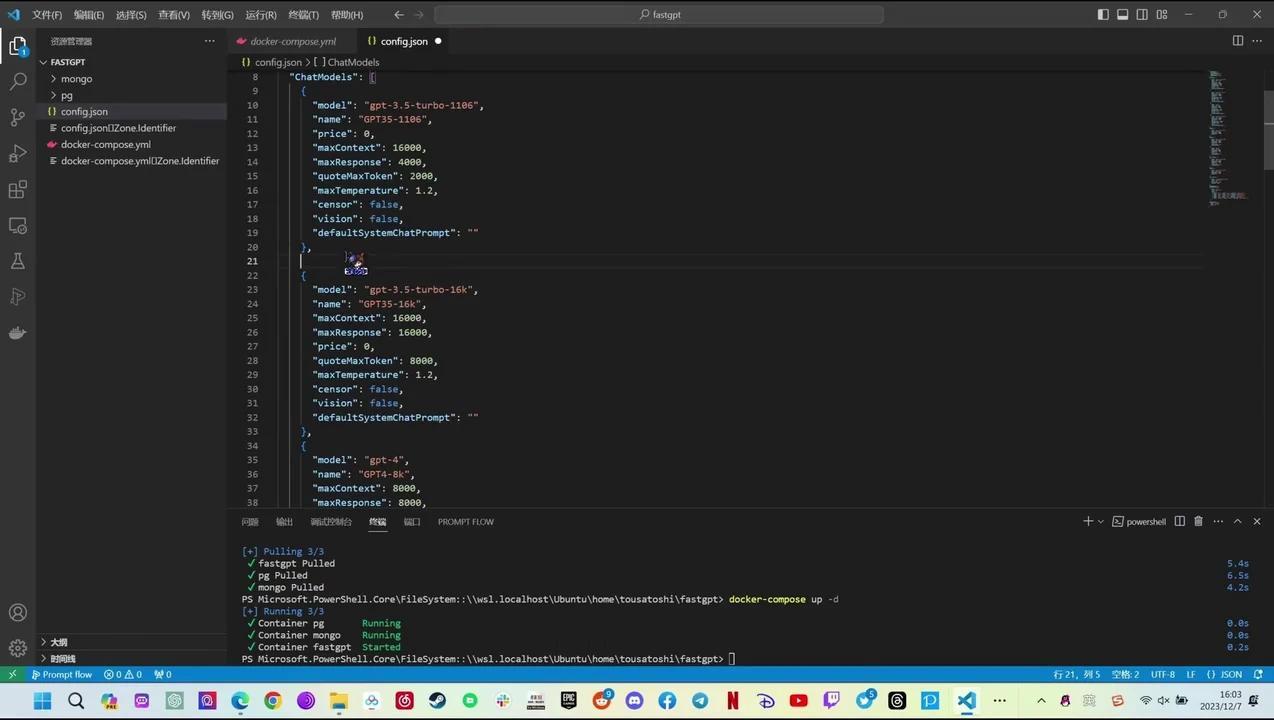

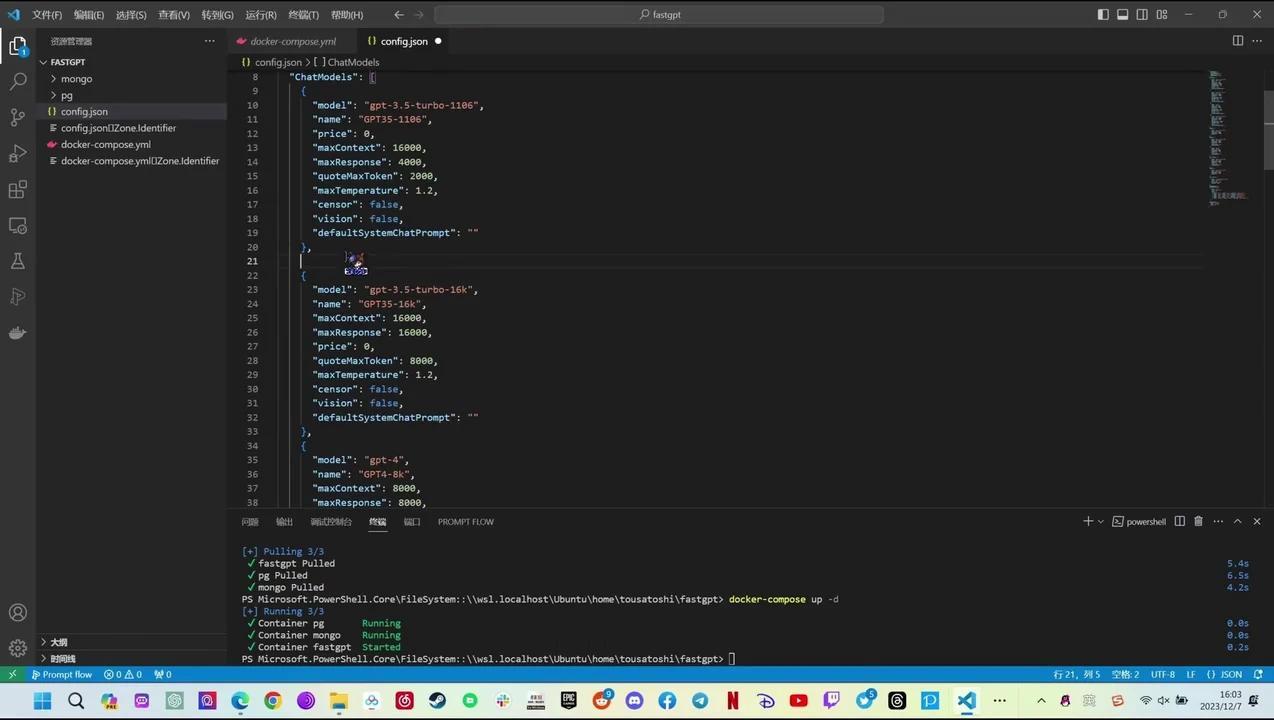

- 接下来修改 config.json 配置文件,在 ChatModels 字段下新增相应配置内容。

CheckGLM36B支持的上下文长度为8K,你可以将maxContext和maxResponse参数修改为8000。

可在defaultSystemChatPrompt中设置系统默认提示词,并在config.json文件中找到QAModels部分进行新增内容配置。

这里是为了将 ChatGLM3 设置为文件处理模型,在使用知识库时会调用该功能。

接着我们滑动到下方,找到 VectorModels 一栏,在下方新增内容。此处需设置 M3E 作为向量模型,用于处理知识库数据。

在 QAModels 和 VectorModels 都添加完成后,请注意在括号前添加英文逗号,否则 config.json 文件将无法生效。

现在,我们已经完成了 Config文件 的修改,可以开始使用 FastGPT 了。

在使用前,需要打开 PowerShell 并依次输入命令以更新配置文件。请将 UserName 替换为你的 Ubuntu 用户名。

随后,输入指定链接即可进入 FastGPT 网页。

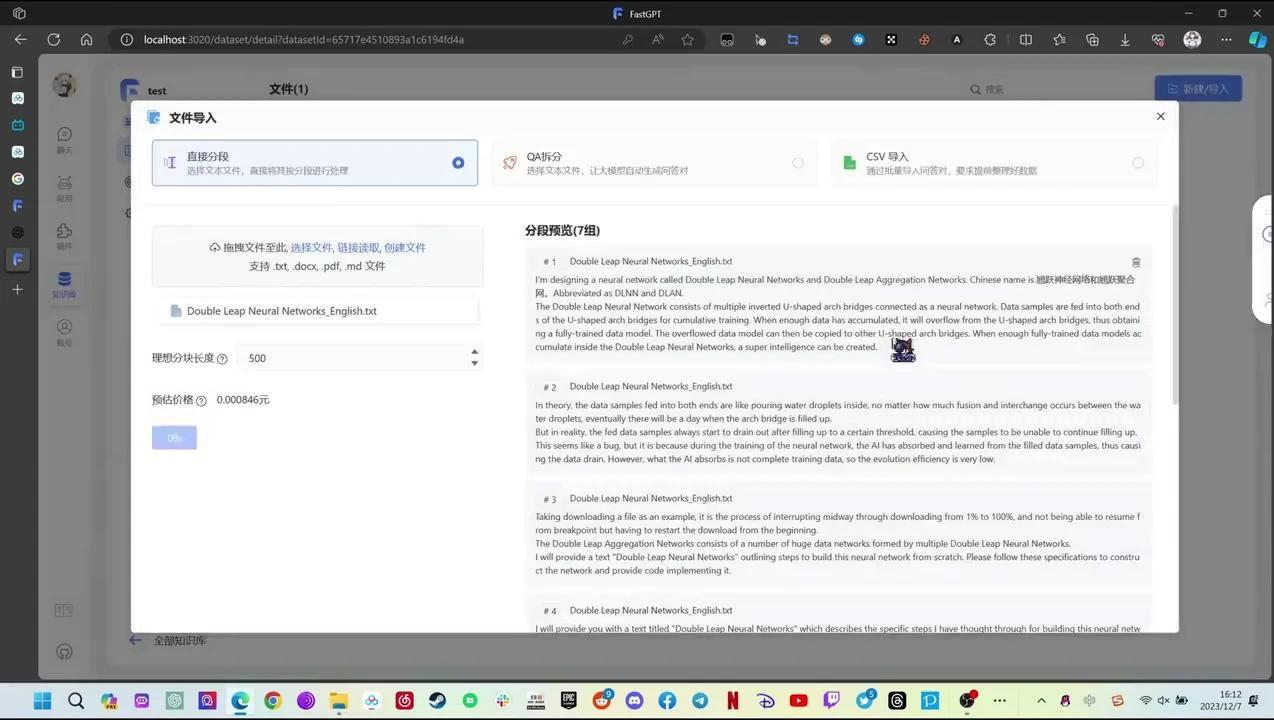

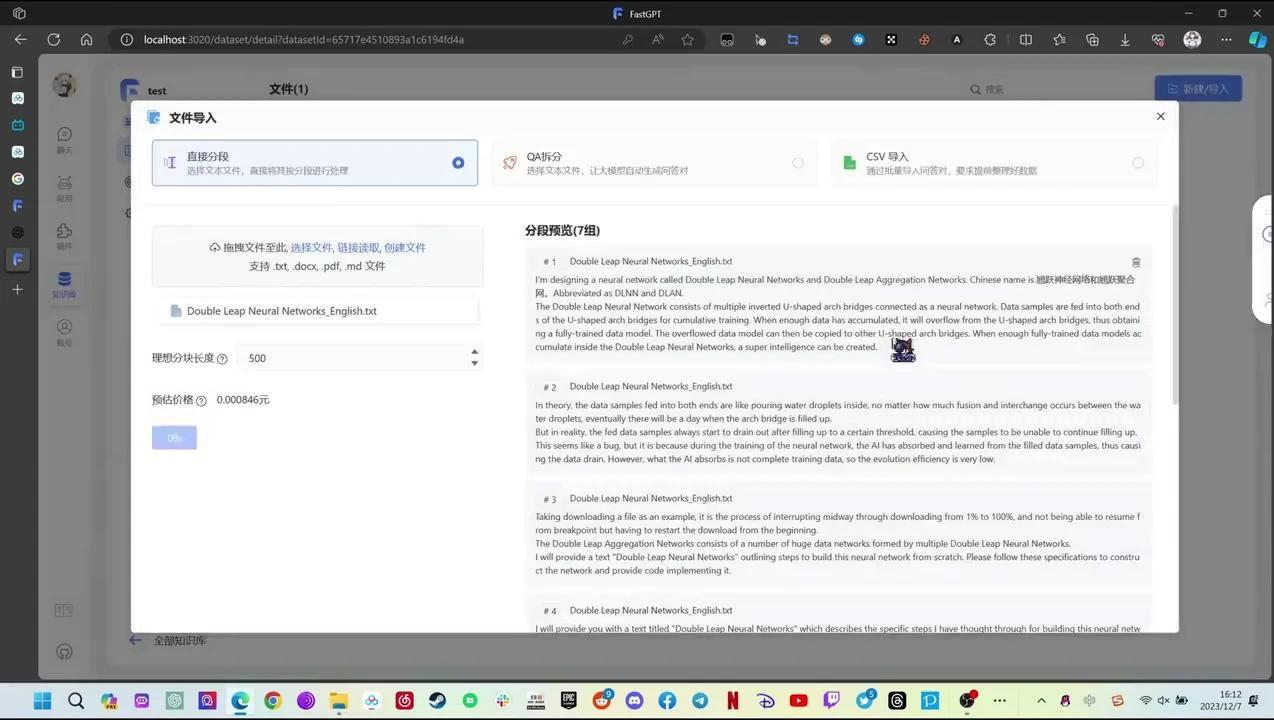

在左侧菜单栏点击“知识库”,随后选择右上角的“新建知识库”选项。

在模型选择中,指定M3E作为文件处理模型,并选择“拆更三”。

完gpt 教程成设置后,点击右上角的“文件导入”功能,任意选取一个文件,最后确认导入操作。

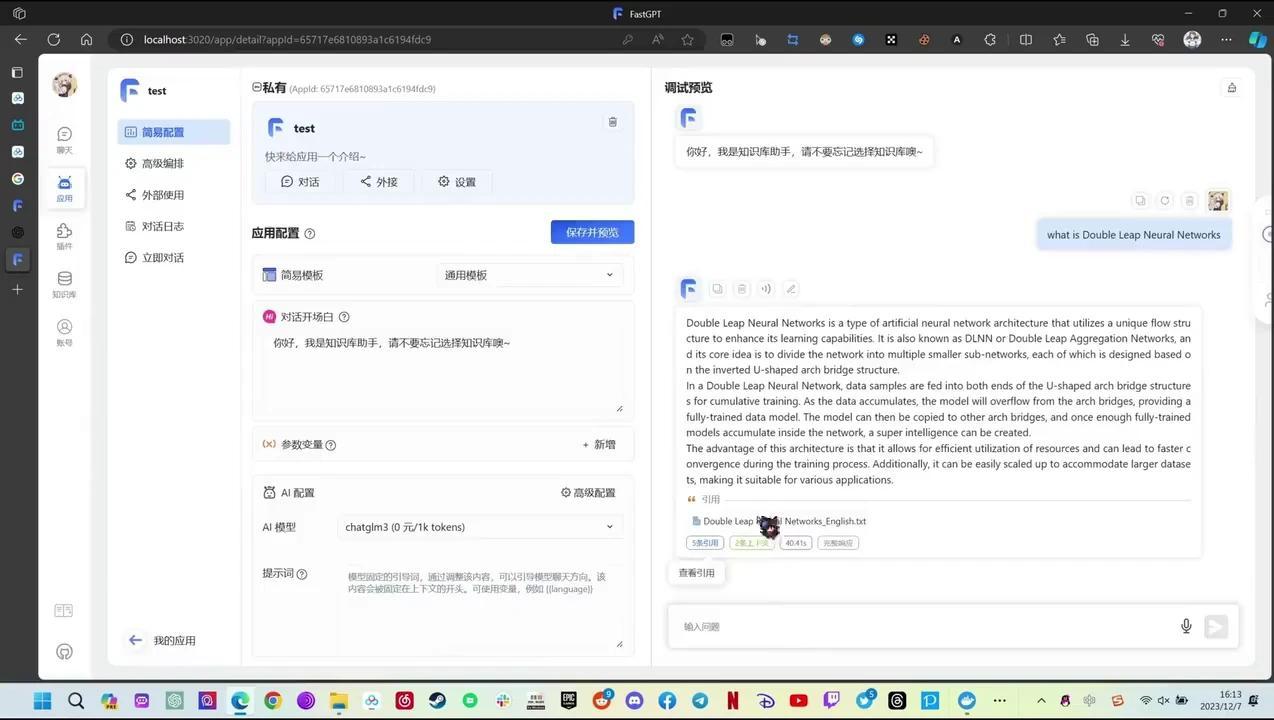

确认索引文件已完成。随后,点击左侧菜单栏的“应用”,在右上角选择“新建”,并勾选“知识库+对话引导”选项,最后点击“应用”完成操作。

在PA模型中,选择拆更三,然后关联知识库,最后点击保存按钮。接着进行聊天测试,若收到回复则说明API调用正常。

发布者:全栈程序员-站长,转载请注明出处:https://javaforall.net/274605.html原文链接:https://javaforall.net