比如定义,原理,实现流程,特点,目前应用情况等等

其实没那么复杂,不妨尝试从以下几个方面来理解 Agent:

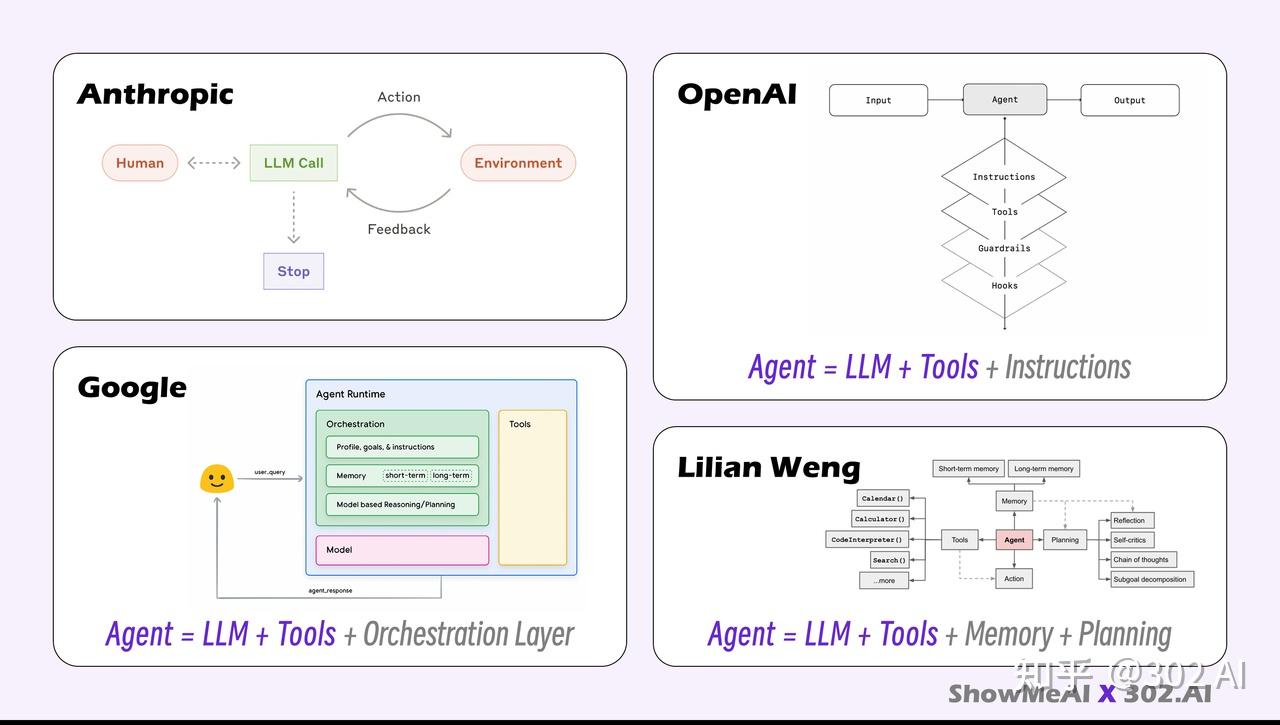

我们可以抓取一个最精简、也是最核心的公式来帮助理解 Agent:

Agent = LLM + Tools

其核心分工模式如下:

- LLM 负责思考和调用(决策规划和问题推理)

- Tools 负责执行和与返回结果 (如搜索、计算、API 调用)

理解 Agent 之前需要先理解 LLM(大语言模型)。

LLM 是无法代替 Agent 的,因为 LLM 本身是无记忆的,专业术语叫 stateless(无状态的)。你可以把模型 LLM 想象成网吧里的电脑,每次用完电脑后重启。一次对话请求处理完成后,LLM 内部恢复初始状态,如此循环。

正是因为 LLM 无状态、擅长处理单次输入输出的特性,非常适合做一问一答,所以其最初的应用形态便是对话机器人(Chatbot)。

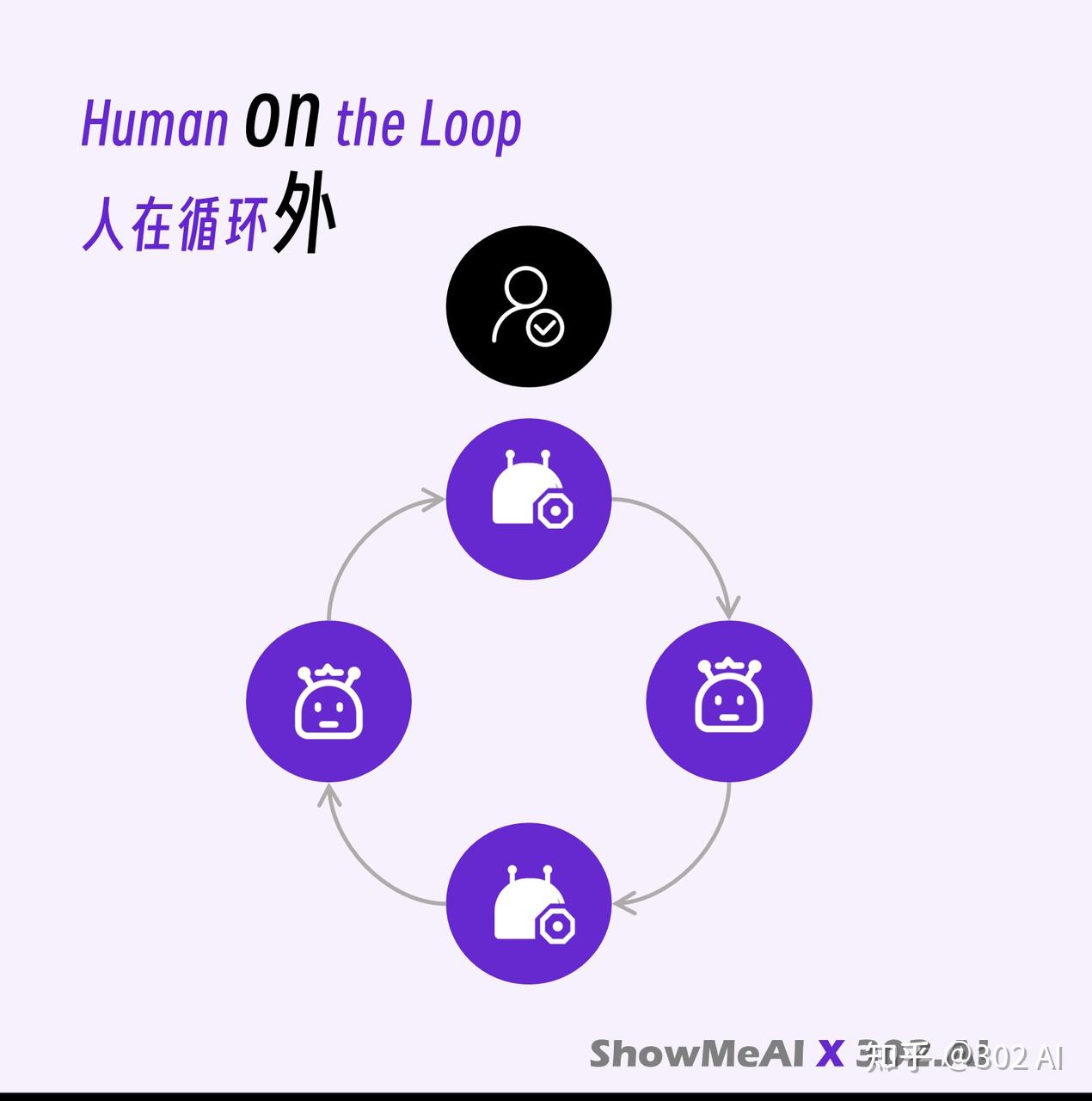

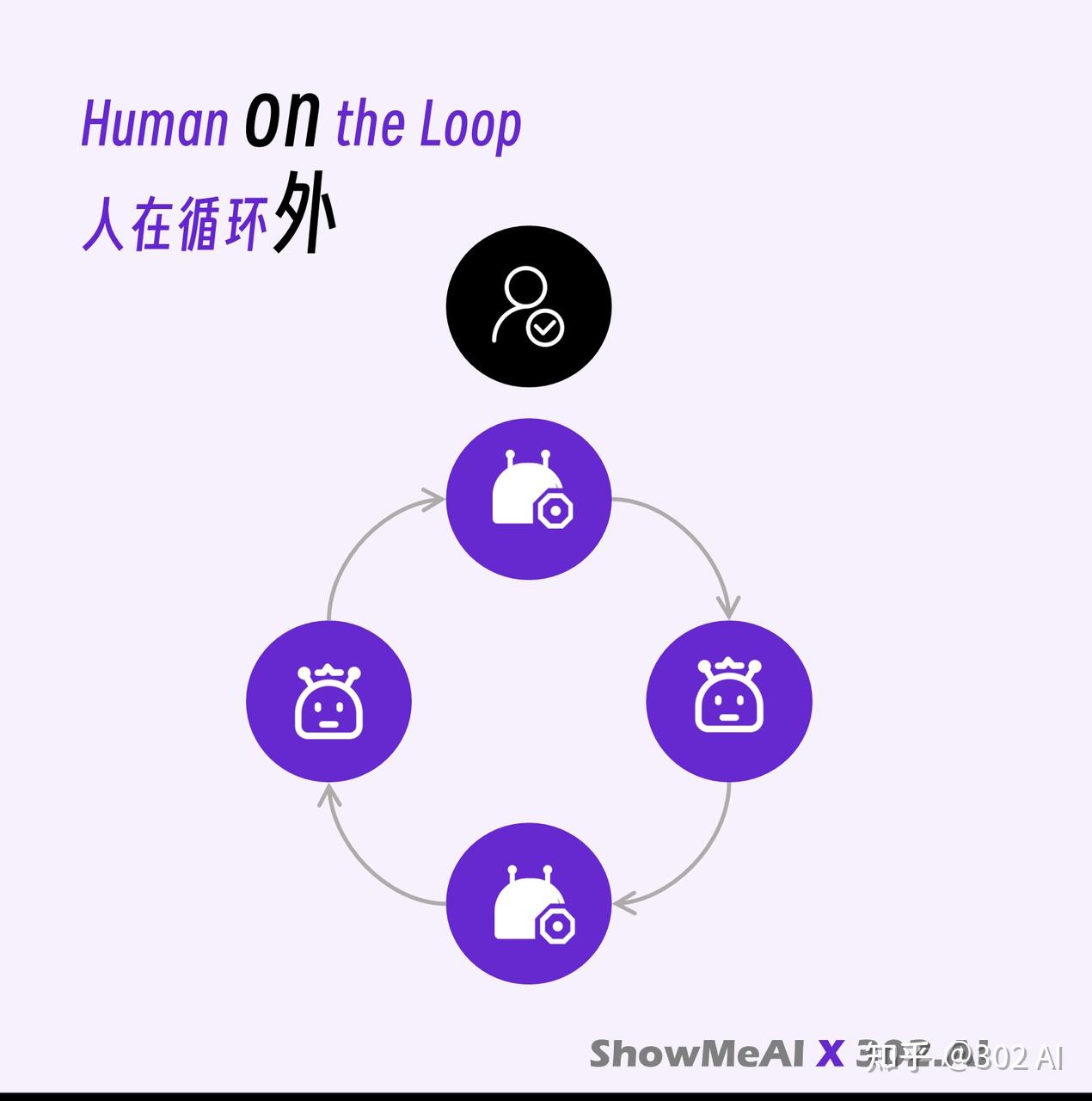

Chatbot 交互模式基本就是「人 – AI – 人 – AI – ….」的交替循环。在这个过程中,人类不断通过提问、追问、澄清来引导 AI,使其输出逐渐符合预期。这个阶段被称为 Human in the Loop(人在循环中)。

随着 LLM 能力的提升,AI 的回答越来越靠谱了,很多环节已不再需要人类的干预。于是,一个革命性的想法诞生了:让 AI 自己与自己「对话」。换言之,让 AI 在执行任务的过程中自我驱动。

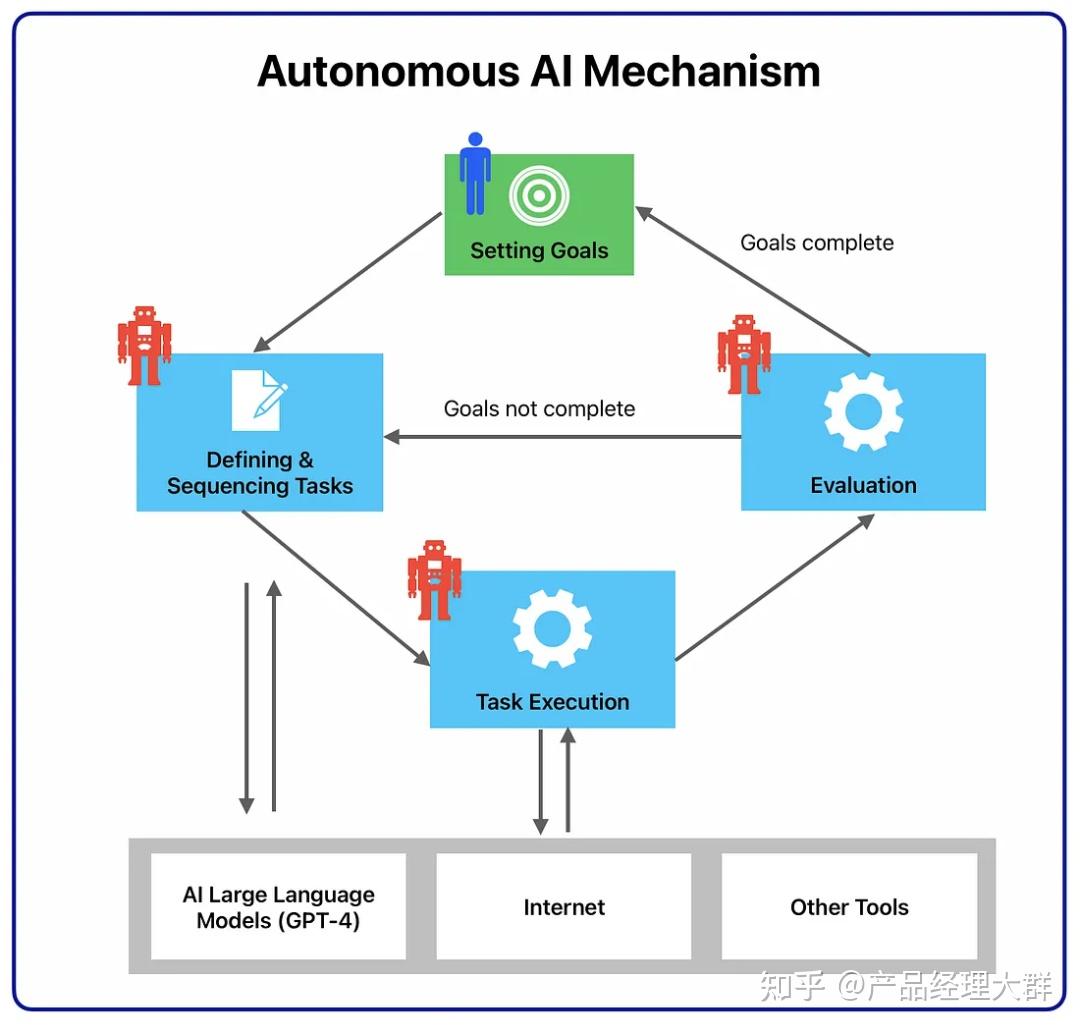

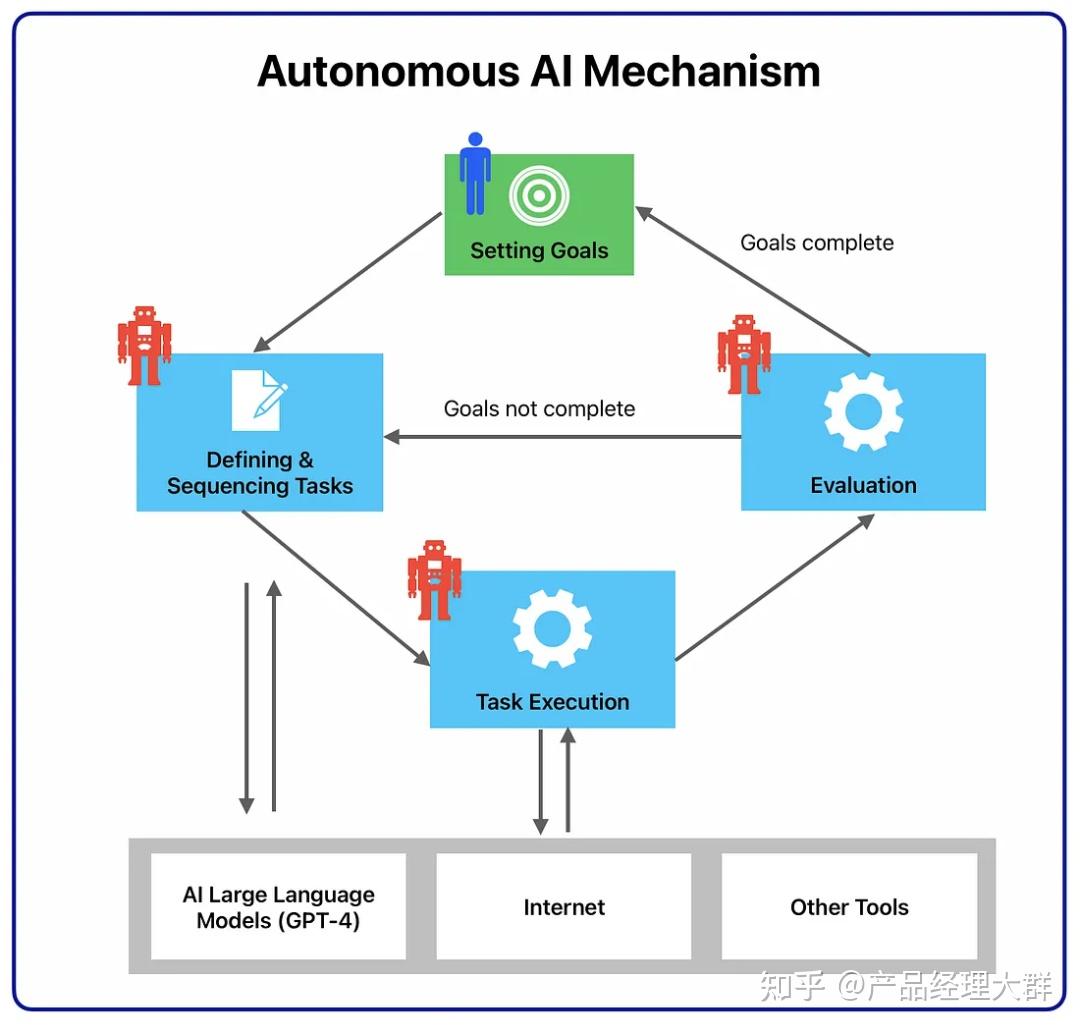

由此诞生这种「人 – AI – AI – AI – ….」的新逻辑,称之为 Human on the loop(人在循环外)。人类只需设定一个初始目标,后续的所有步骤都由 AI 自主循环完成。

这正是 Agent 的关键特征之一:自主循环。

这实现了 “人设定目标 → Agent 自我迭代 → 返回结果” 的闭环。

这里要提到一个常见的误区:大部分应用客户端把上述过程呈现在了同一个对话界面里,让用户误以为只有一次 AI 问答。但实际上,每调用一次工具,AI 需要回答两次。

LLM 本身无记忆(stateless),这就需要依赖人类构建的外部代码,用来维护任务状态与历史上下文。这类代码就叫 Agent 框架,本质是控制 AI 自我循环和维护记忆。

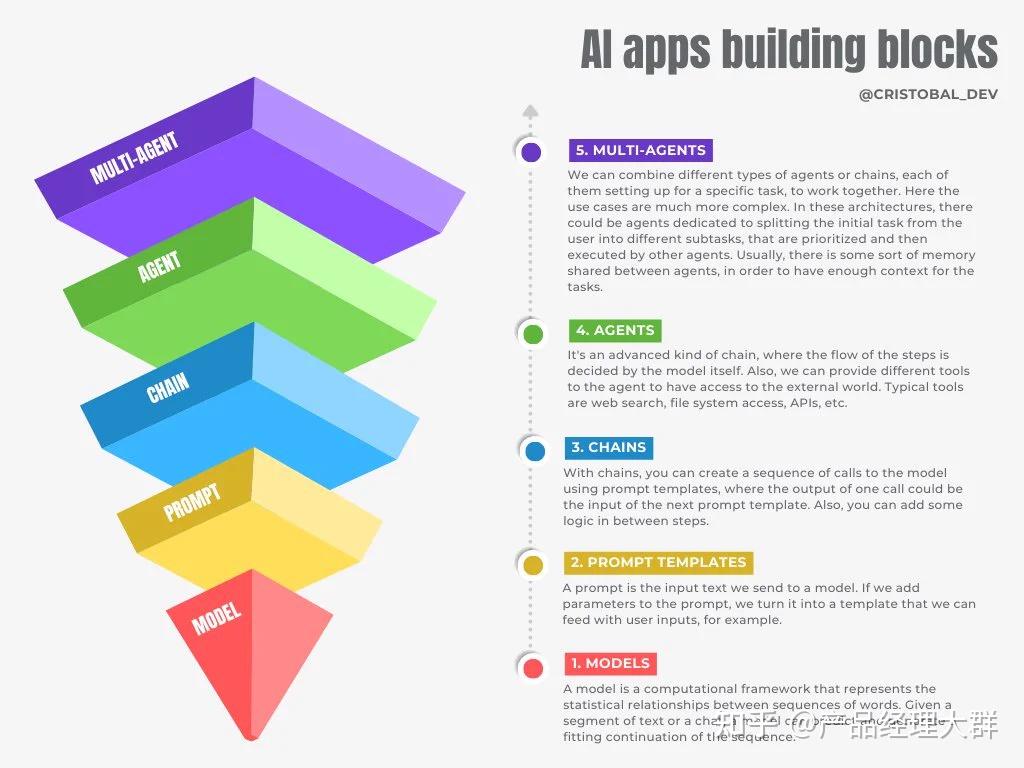

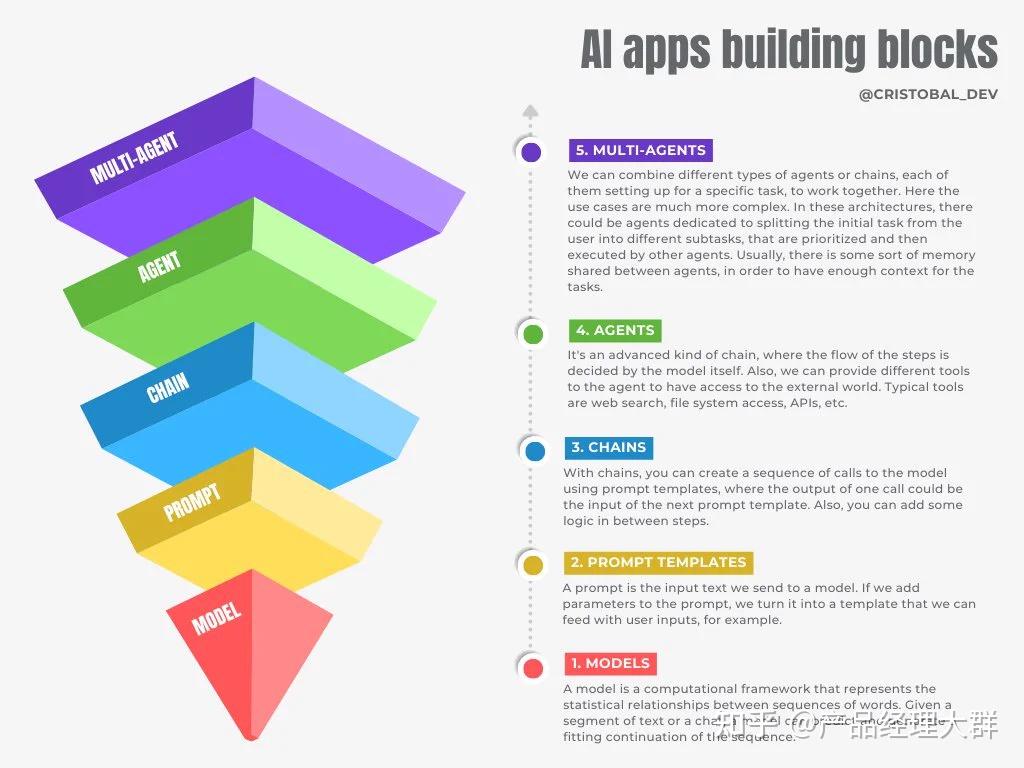

我们把当前的 Agent 框架分为三大类:

(1)手动 Agent 框架

开发者预先设定好任务执行的每一步计划,明确规定哪个步骤使用哪个工具,LLM主要负责在预设节点上填充内容或做简单决策。

我们称之为工作流(Workflow),它是一个白盒系统。

Dify 和 Coze 就是典型的代表,能够提供可视化流程编排工具。此时 Tools 的执行步骤,在很多时候是被人强制执行的,以此换取更多的确定性。

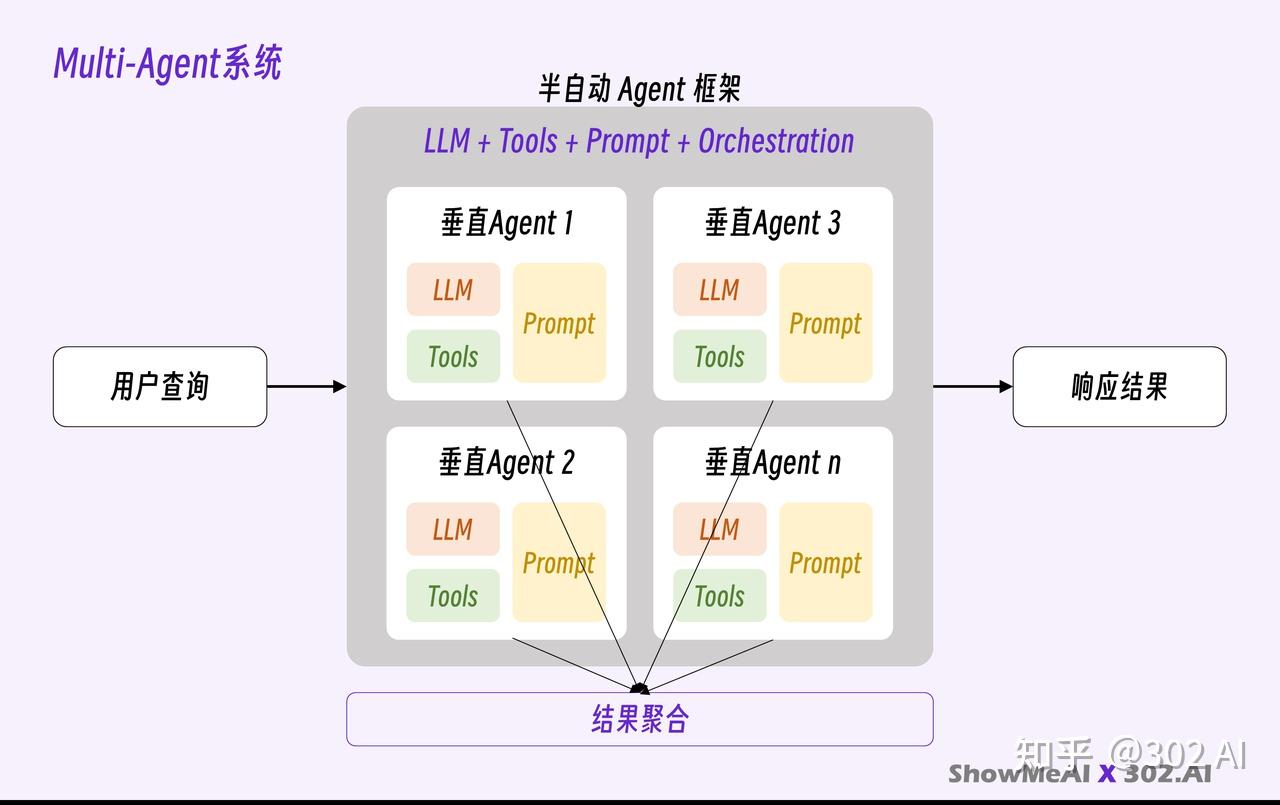

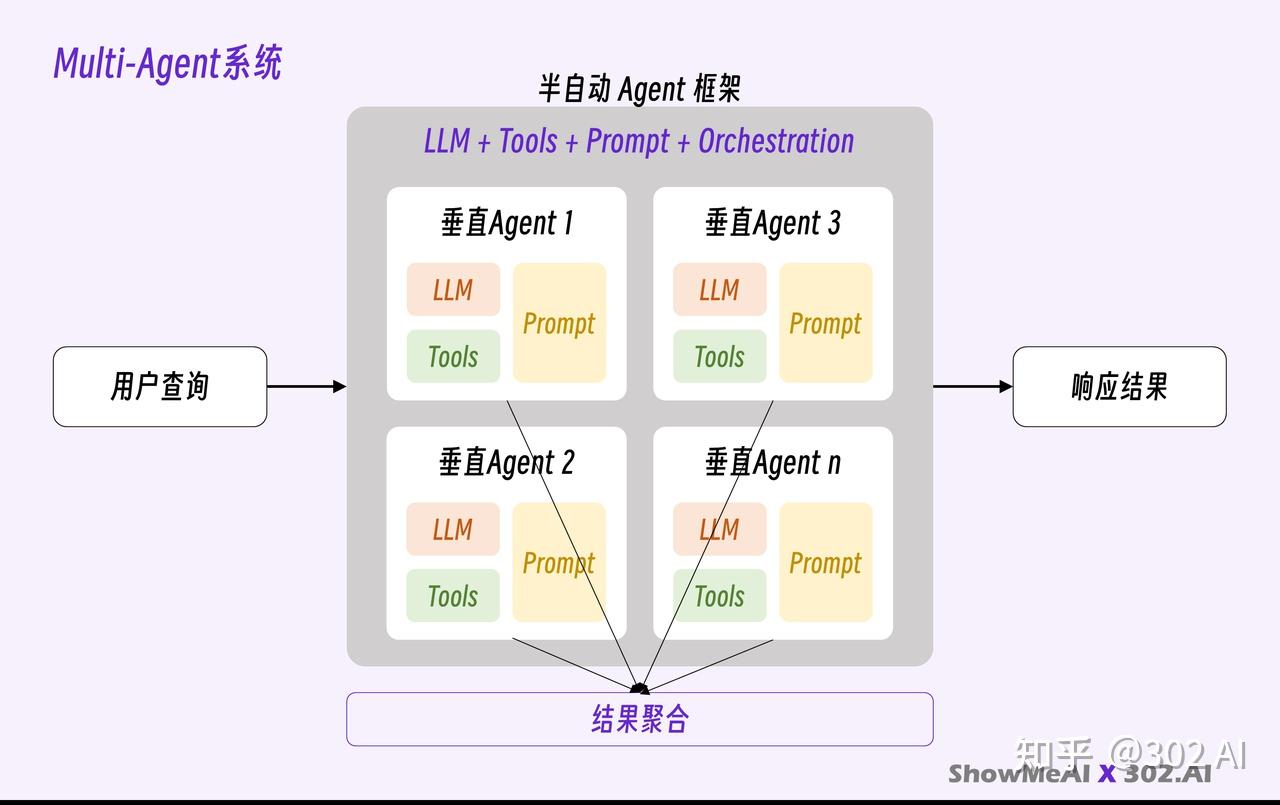

(2)半自动 Agent 框架

将 AI 预设为不同身份的垂直 Agent(系统提示词 + 特定工具),每个垂直 Agent 完成不同的子任务,最后通过框架将每个子任务的执行过程和结果组合起来,完成最终目标。

我们称之为 Multi-Agent System(多 Agent 系统),它是一个灰盒系统。

Manus 和扣子空间的规划模式就是典型的多 Agent 框架。规划和记忆管理都属于编排的一部分。

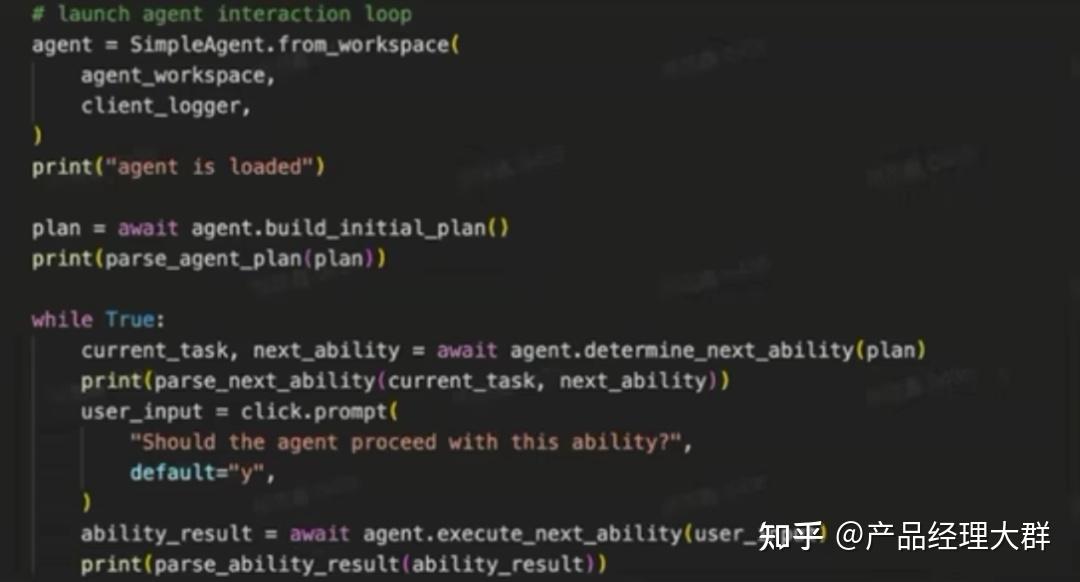

(3)全自动 Agent 框架

只给模型设定一个最终目标,模型接收到目标就开始自我循环,直到完成目标或遇到无法解决的障碍。

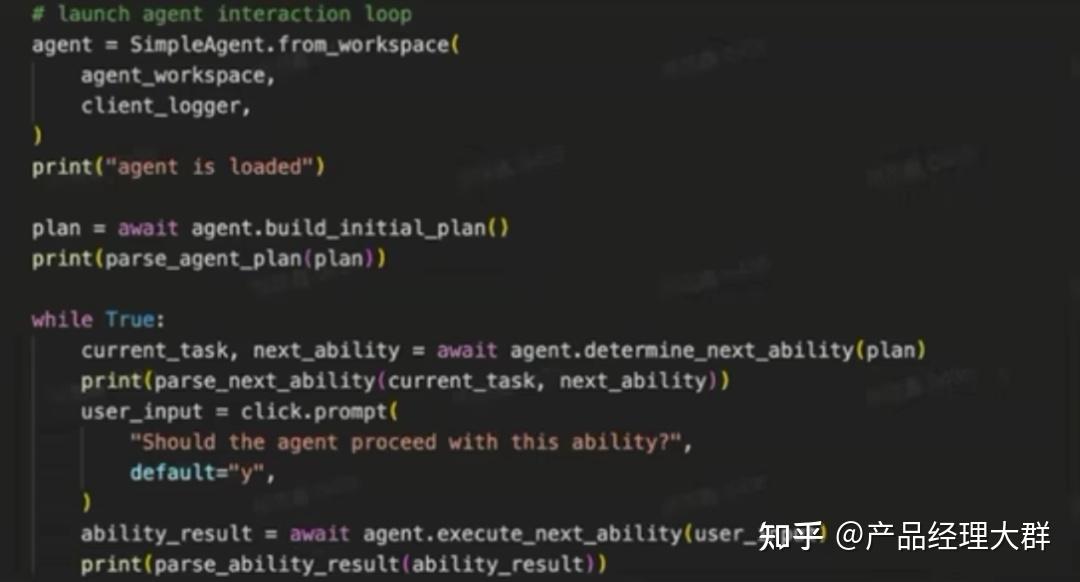

全自动 Agent 框架是最简洁的,调用工具的那几行代码,就是其全部的核心了,复杂过程全部交由模型去解决。

我们称之为 Single-Agent System(单 Agent 系统),也就是所谓的通用 Agent,它是一个黑盒系统。

模型自主完成工具调用这个操作,就是全自动 Agent 框架了,如果模型没有 Tool Use 功能,也可以通过代码来实现。

这 3 种框架并不是对立关系,而是常常组合使用。比如,Multi-Agent 系统可以与 Workflow 相结合,Single-Agent 系统也是 Workflow 和 Multi-Agent 系统的重要组成部分。

让我们再次回到本文的核心:Agent = LLM + Tools

- AI 通过调用工具获得了与现实世界交互的能力,再通过交互反馈实现自我循环并完成任务。这就是 Agent 最核心的本质。

- 控制 AI 自我循环的代码,就是 Agent 框架。

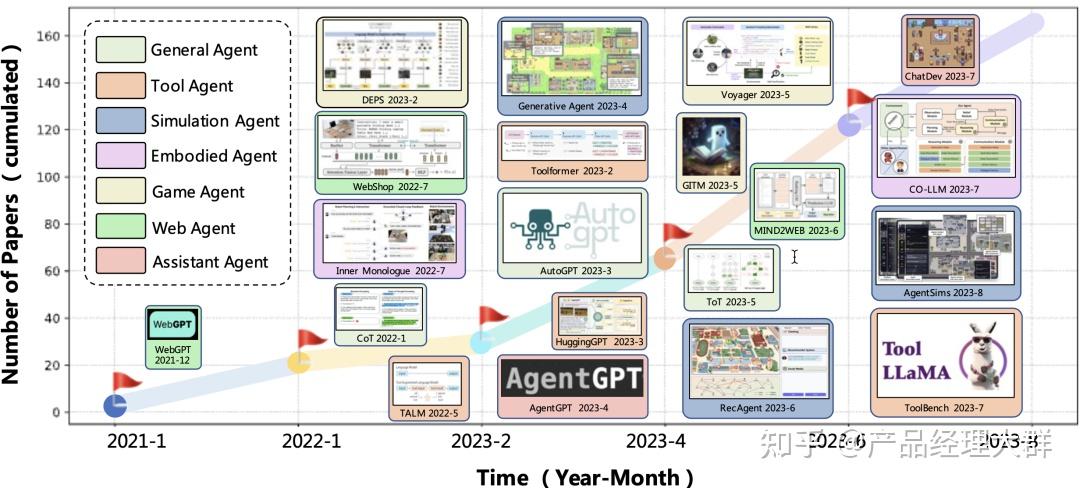

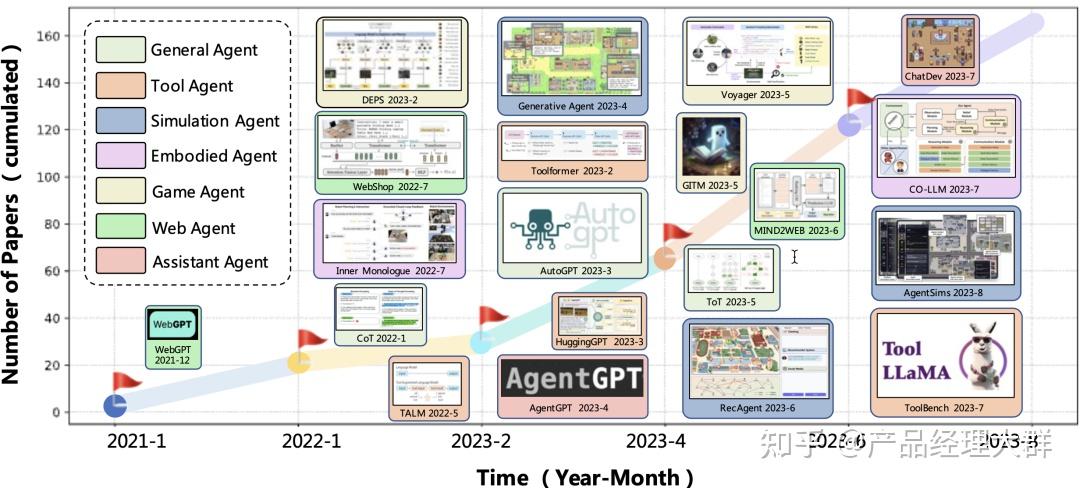

大模型的下半场,Agent的大爆发,类似寒武纪生命大爆发,BabyGPT、AutoGPT、Generative Agents等实验性产品相继出新。【号称革SaaS软件的命】。

利用大模型作为大脑来构建智能体是公认的方式。

Agent是人工智能领域中的一个概念,指的是具有自主性、反应性、主动性和社交能力等特性的计算实体。这种ai能够使用传感器感知周围环境,做出决策,然后使用执行器采取行动。大模型在AI Agent相关研究中得到了快速发展,它被视为通往AGI的主要探索路线。

此外,LLM的应用范围远远超出了编写文本、故事、论文和程序代码, 它可以作为智能体思维的大脑,辅以其他关键组件,构成一个功能全面的智能系统。

从演进的角度来看,生命体的发展主要通过单元增强和组织增强两种方式实现。这两种增强方式相辅相成,使生命具备了更多样复杂的表达形式。如同Agent——我们希望它是在任何系统中能够独立思考并与环境交互的智能体。

现在智能体已经有了一颗足够智商的“大脑”,也就是大模型,那如何让Agent像人一样思考和执行呢?——只要给定任何一个目标,它就能自动解决各种问题。是进一步提高智商,增强智能体的“自身”;还是借助外部模块,强化“组织”能力?

虽然今天的Agent尚无法完成所有通用任务,也难以如多细胞之间的社会化分工,形成动态稳定体。但在个体Agent的局部模块上,如HuggingGPT,已展示了其使用工具的能力,包括Plug-in成为实际落地的重要里程碑,在大模型的下半场,将是Agent寒武纪落地爆发的时刻。

此刻Agent的落地瓶颈在哪里?它能否从专用抵达通用?多模态会为Agent带来什么?未来格局怎样演进?

就像地球上诞生的第一个细胞一样,即使目前的Agent尚无法替代我们在实际工作中的角色,但一切的一切都源于这第一个细胞(也就是原型),它是智能体进化的起点。即使对Agent的落地再迷茫,也要继续“涌现”。因为Agent的成败将是决定这一场ai革命是否是新一代工业革命的关键。

AI小镇开源,含25个Agent,构建”西部世界”AI Town,模拟文明演进。OpenAI创始人Karpathy称AI Agent将颠覆未来。Agent源自拉丁语,意为“行动”,在LLM中指自主执行复杂任务的程序。

Agent并非ChatGPT升级版,它不仅告诉你“如何做”,更会帮你去做。如果CoPilot是副驾驶,那么Agent就是主驾驶。

一个精简的Agent决策流程,用函数表达式:

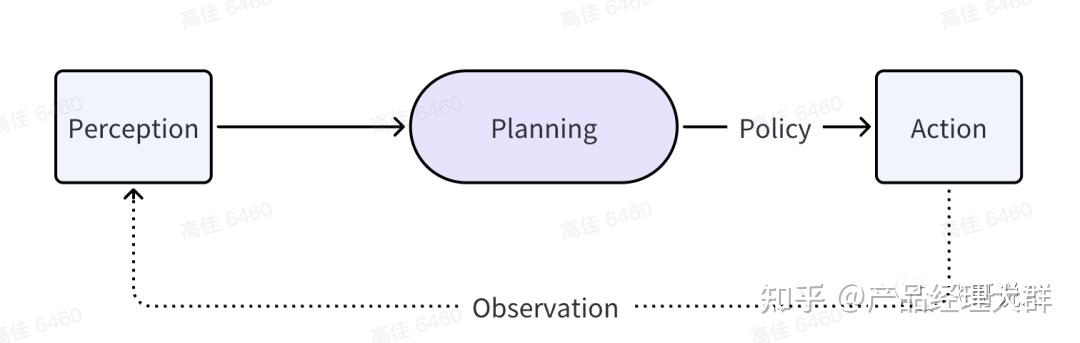

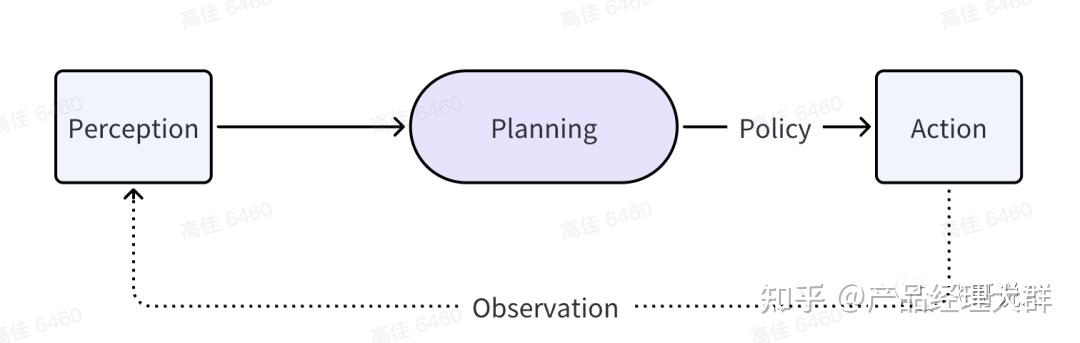

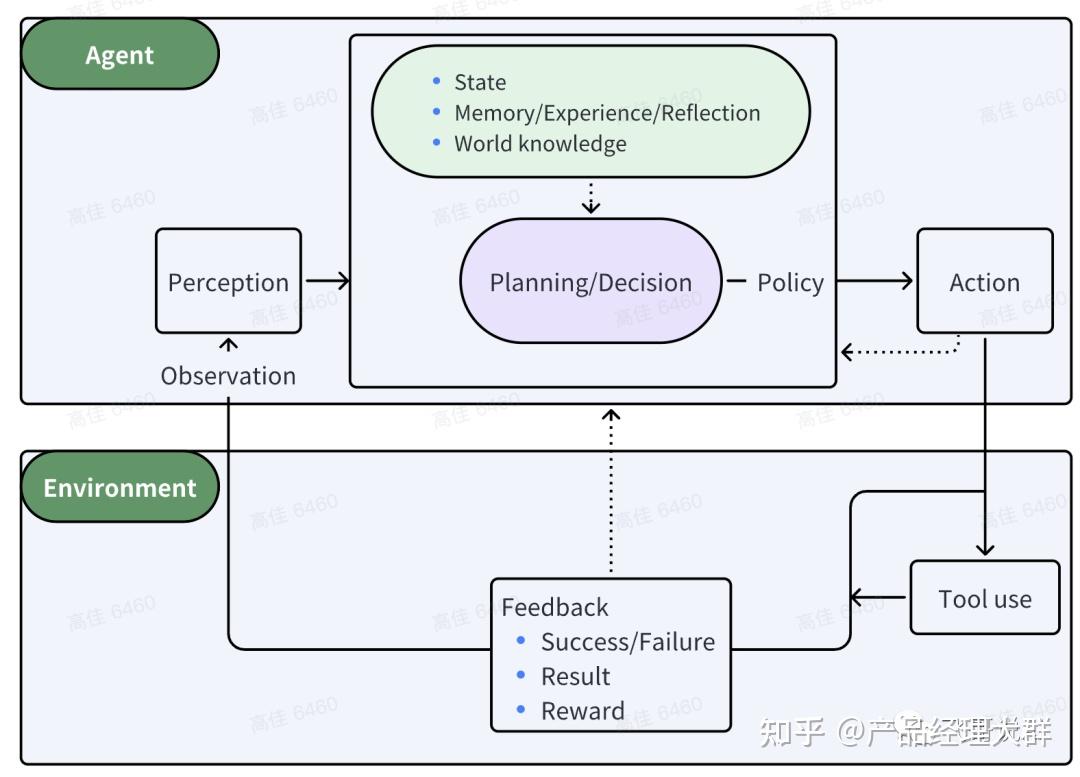

Agent:P(感知)—> P(规划)—>A(行动)类似人类「做事情」的过程,Agent的核心功能,可以归纳为三个步骤的循环:感知(Perception)、规划(Planning)和行动(Action)。

感知(Perception)是指Agent从环境中收集信息并从中提取相关知识的能力,规划(Planning)是指Agent为了某一目标而作出的决策过程,行动(Action)是指基于环境和规划做出的动作。其中,Policy是Agent做出Action的核心决策,而行动又通过观察(Observation)成为进一步Perception的前提和基础,形成自主地闭环学习过程。这一过程就像马克思主义的「实践论」:“认识从实践开始,经过实践得到了理论的认识,再回到实践中去。”Agent也在知行合一中进化。

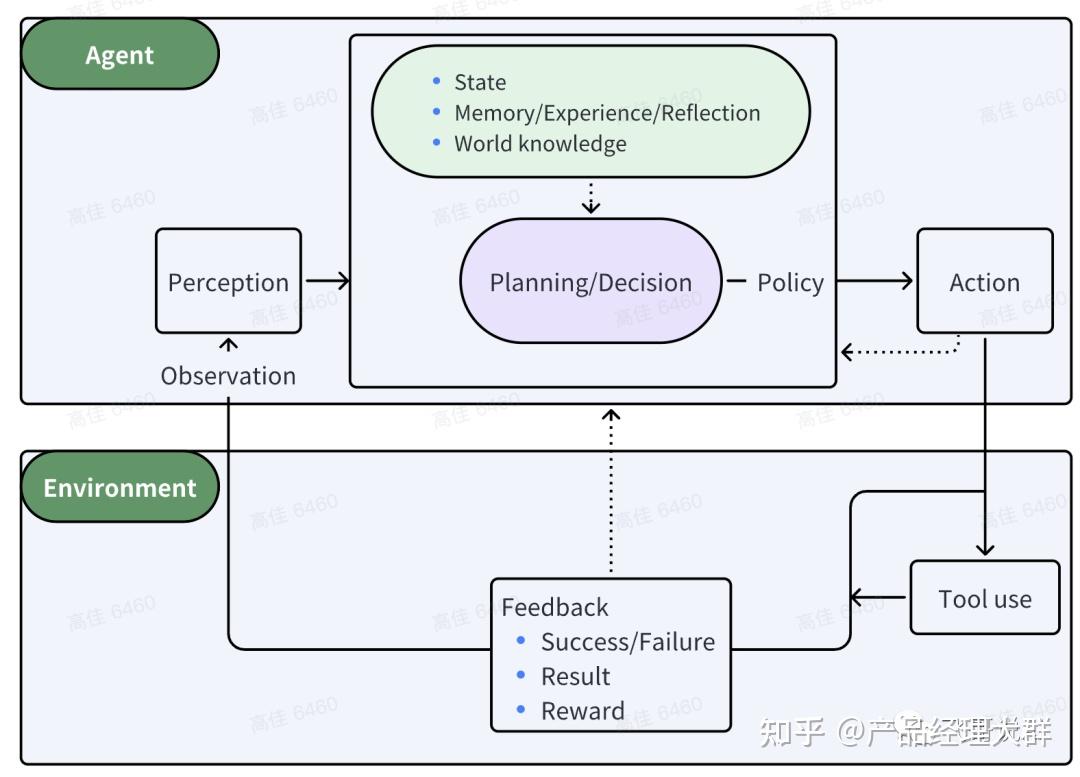

一个更完整的Agent,一定是与环境充分交互的,它包括两部分——一是Agent的部分,二是环境的部分。此刻的Agent就如同物理世界中的「人类」,物理世界就是人类的「外部环境」。

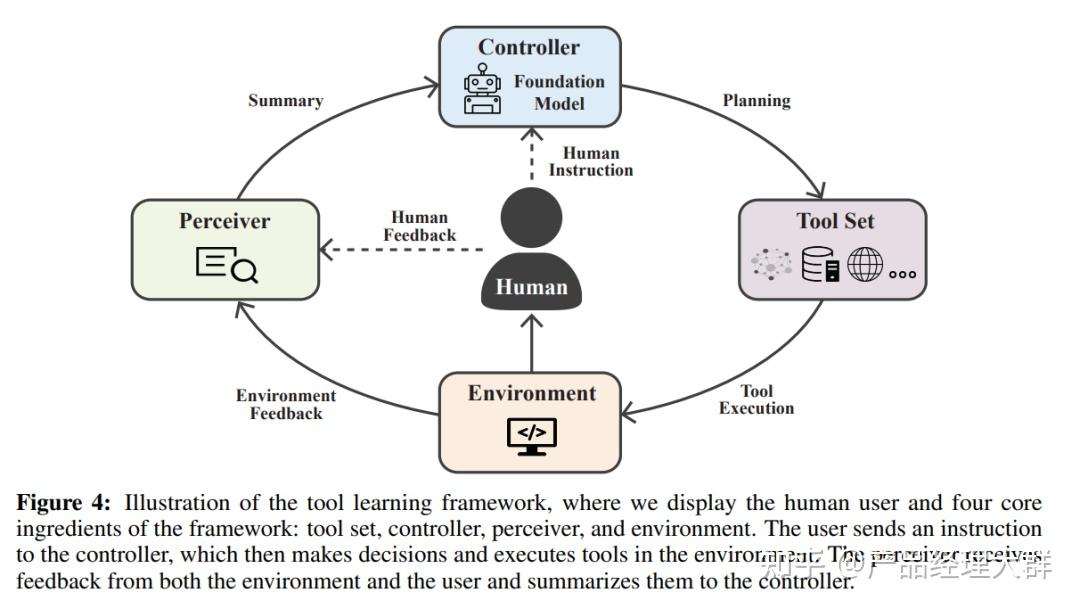

目前无论是中国还是美国,新的共识正在逐渐形成:第一是Agent需要调用外部工具,第二是调用工具的方式就是输出代码——由LLM大脑输出一种可执行的代码,像是一个语义分析器,由它理解每句话的含义,然后将其转换成一种机器指令,再去调用外部的工具来执行或生成答案。

可以想象,人类与外部环境交互的过程:我们基于对这个世界的全部感知,推导出其隐藏的状态,并结合自己的记忆和对世界的知识理解,进而做出Planning、决策和行动;而行动又会反作用于环境,给我们新的反馈,人类结合对反馈的观察,继而再做决策,以此循环往复。

最直观的公式:Agent = LLM+Planning+Feedback+Tool use

其中,在做 Planning 的过程中,除了基于现在的状态,还有要记忆、经验,一些对过往的反思和总结,同时还有世界知识。对比今天的ChatGPT,它其实并非Agent,而是一个通用的世界知识,即用来做 Planning 的知识源,它没有基于具体的环境状态,也没有Memory,Experience和Reflection。当然,ChatGPT基于自身的知识可以做逻辑推理和一定的规划,也可以加向量数据库解决推理问题,加 Reflection 让过程更丰富,如此看来,可将ChatGPT这个端到端的黑盒子变得显性化一点儿——其实符号就是一个非常显性的系统,基于此可以定向纠错,定向提升。对于Feedback,Agent基于Action得到正向的或试错的反馈、阶段性结果或奖励。Feedback有多种形式,如果将与我们聊天的ChatGPT视为一个Agent,我们在文本框中敲入的回复就是一种Feedback,只不过是一种文本形式的Feedback,此时我们对于ChatGPT来说,就是一种环境。RLHF也是一种环境,一种极度简单的环境。“人类之所以是人类,因为他会使用工具。 ”

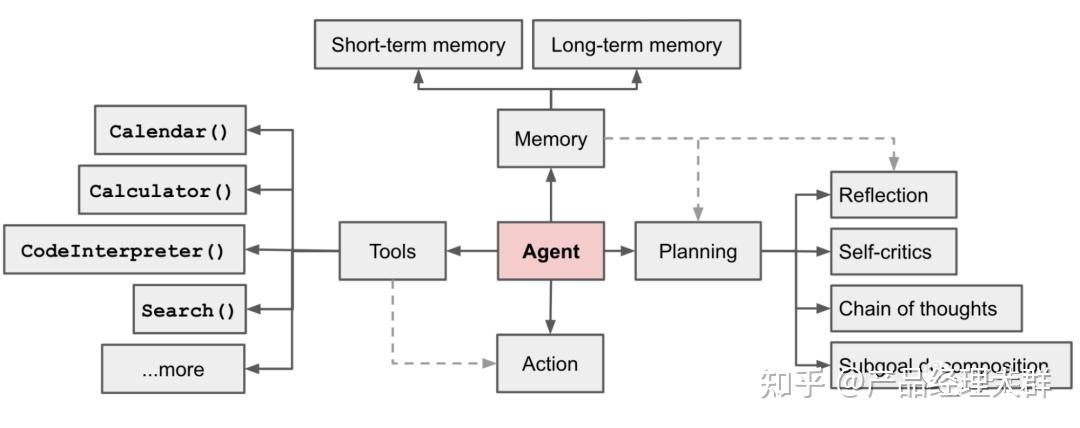

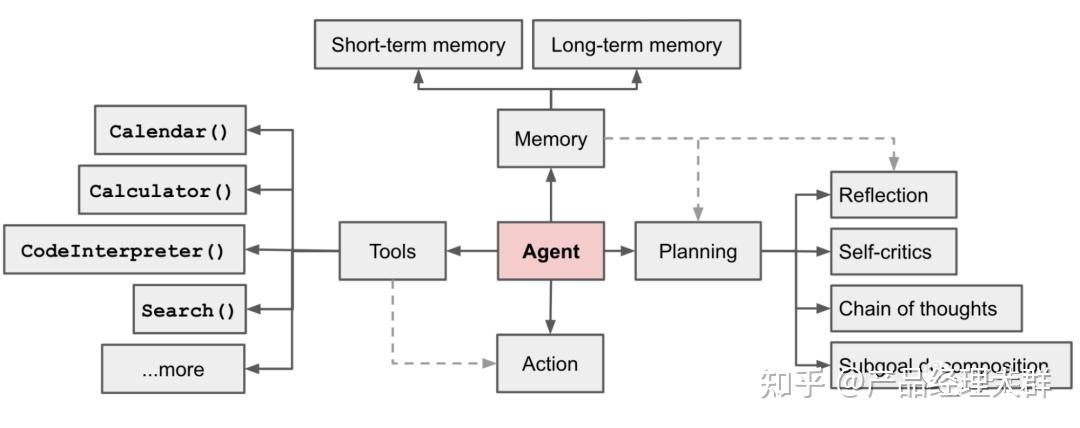

在一个基于LLM的Agent自治智能体系统中,LLM发挥大脑的功能,同时还需要以下几个关键组件的配合:

规划

子目标分解:智能体将复杂的大任务分解成多个较小、可管理的子目标,以便有效处理复杂任务。

反思与优化:智能体可以对过去的行动进行自我批评和反思,从错误中学习,并在未来的步骤中进行改进,以此不断提高最终结果的质量。

记忆

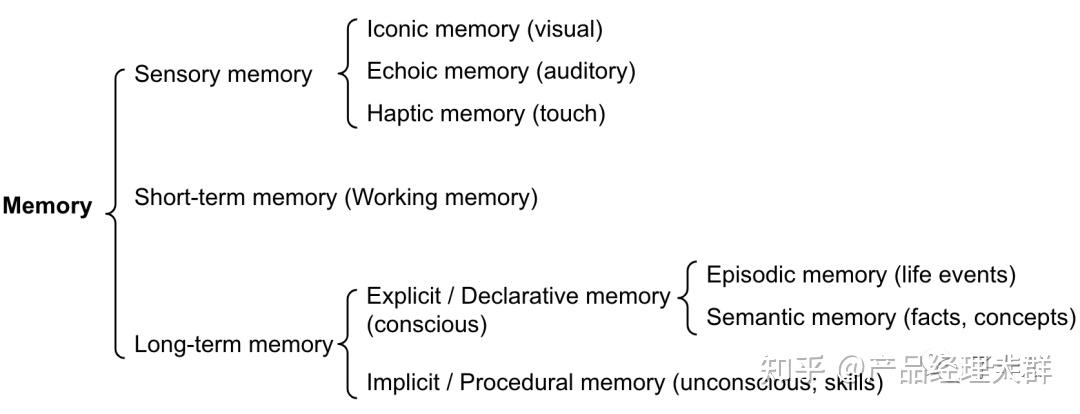

短期记忆:可以考虑模型的上下文学习(Prompt Engineering)就是利用了短期记忆来学习。

长期记忆:提供一个外部向量存储,智能体可以在查询时进行访问,实现快速检索,以获取大量信息。

工具使用

智能体可以调用外部API获得模型权重中所没有的额外信息,包括实时信息、代码执行能力、对专属信息源的访问等。

02 组件一:规划

一个复杂的任务通常包含多步操作。智能体需要知道这些步骤以及提前计划。

任务分解

思维链(CoT)已经成为提升模型在复杂任务表现的标准化提示技术。提示模型“一步一步思考”可以利用更多在线计算来将难题分解成较小、简单的步骤。CoT把大任务转变成多个可管理的小任务,也可以洞察模型的思维过程。

思维树(ToT)扩展了CoT,在每个步骤探索多个可能的推理路径。它首先将问题分解成多个思维步骤,并为每个步骤生成多个思路,创建一个树结构。搜索过程可以是BFS(广度优先)或DFS(深度优先),每个状态由一个提示符评估或多数投票评估。

任务分解可以通过(1)简单地提示LLM“XYZ的步骤。\n1.”、“实现XYZ的子目标是什么?”等,(2)使用特定任务的指示,例如“写一个故事梗概”用于写小说,(3)人工输入来完成。

另一个完全不同的方法是 LLM+P ,它依赖一个外部的经典规划器来进行长期规划。该方法使用规划域定义语言(PDDL)作为中间接口,来描述规划问题。在这个过程中,LLM (1) 将问题转换为“问题PDDL”,然后(2) 请求经典规划器根据一个现有的“领域PDDL”来生成PDDL计划,最后(3) 将PDDL计划转换回自然语言。本质上,规划步骤被外包给了一个外部工具,这需要特定领域的PDDL和合适的规划器,在某些机器人设置中很常见,但在许多其它领域并不常用。

自我反思

自我反思是一种重要的机制,可以让自治体通过对过去行动决策进行优化和错误修正来逐步改进。它在需要反复试验和错误的实际任务中发挥着至关重要的作用。

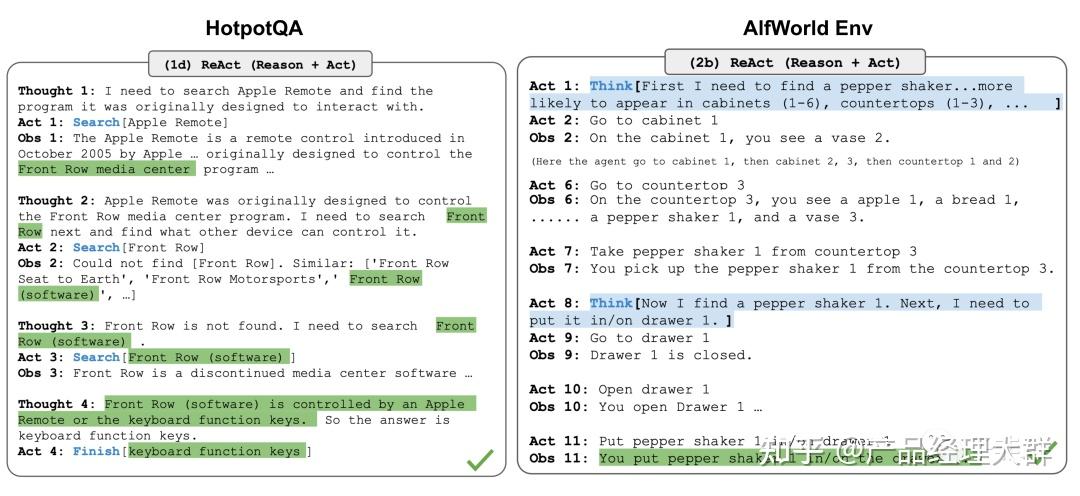

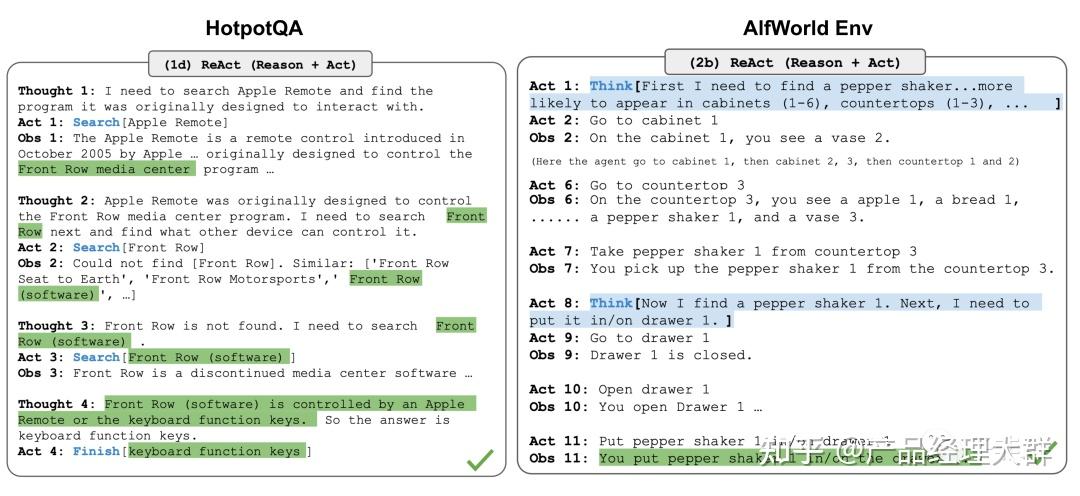

ReAct整合了推理与行动于LLM之中,通过将行动范围扩展至针对任务的离散动作和语言表达的综合。这允许LLM与环境互动(如使用Wikipedia搜索API),并通过自然语言生成推理过程。ReAct的提示模板融合了清晰的思考、行动和观察循环:

思考:……

行动:……

观察:……

(循环进行,重复多次)

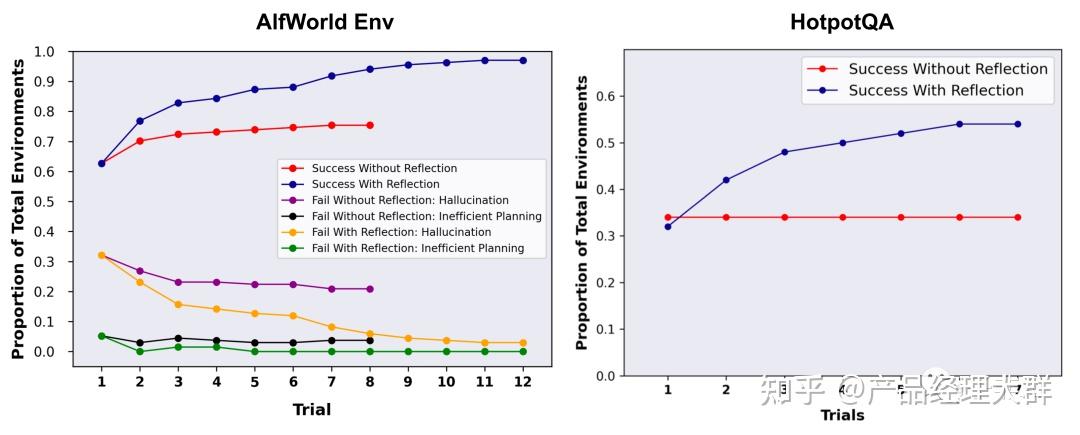

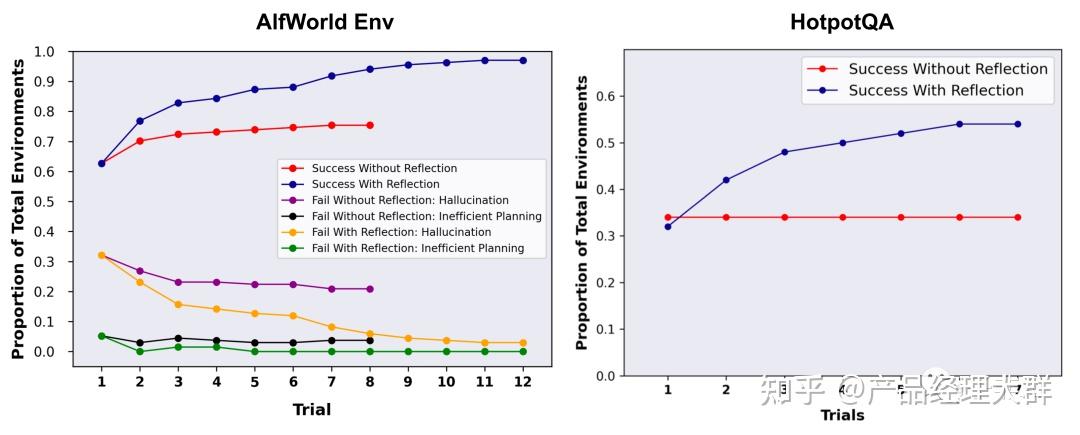

在知识密集型任务(例如HotpotQA、FEVER)和决策制定任务(例如AlfWorld、WebShop)的实验中,与只包含行动的基准相比,ReAct的表现更好。这表明自我反思对提高决策质量很重要。

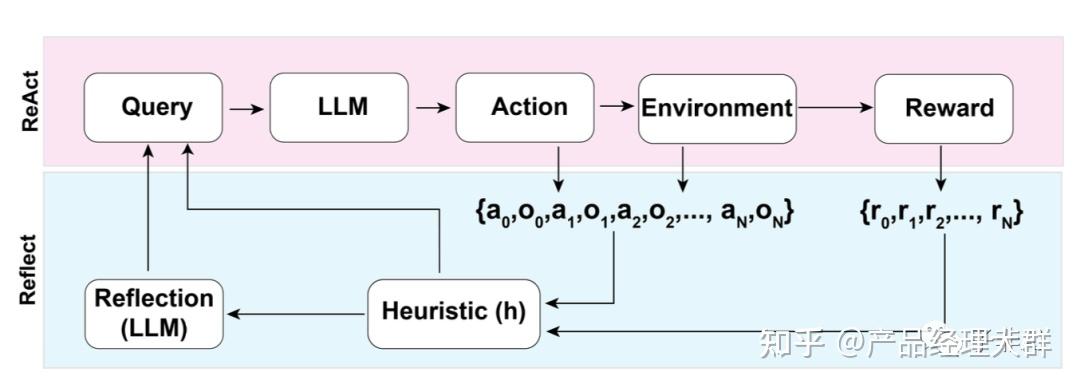

Reflexion是一个框架,通过动态记忆和自我反思能力来提升智能体的推理技能。Reflexion具有标准的RL设置,其中奖励模型提供简单的二进制奖励,动作空间遵循ReAct中的设置,将特定任务的动作空间与语言相结合,以实现复杂的推理步骤。在每个动作后,智能体计算一个启发式函数,并可选地根据自我反思结果决定是否重置环境以开始新的试验。

启发式函数确定当轨迹效率低下或包含幻觉时是否应停止轨迹。效率低下的规划指的是花费太长时间却没有成功的轨迹。幻觉被定义为出现连续相同的动作序列,在环境中导致相同的观察结果。

自我反思是通过向LLM展示两份示例来创建的,每个示例都是一对“失败的轨迹”和“用来指导未来计划变更的理想反思”。然后,反思被添加到智能体的工作记忆中,最多三个,作为查询LLM的上下文。

在AlfWorld环境和HotpotQA的实验中,幻觉是AlfWorld中更常见的失败形式。这表明自我反思机制可以检测并纠正LLM的瑕疵。

人类大脑的记忆可以分为感觉记忆、短期记忆和长期记忆。感觉记忆保留刺激结束后感觉信息的印象,持续时间只有几秒。短期记忆维持着我们目前意识到并需要用于复杂认知任务的信息,大约可以存储7个项目,持续20-30秒。长期记忆的存储量近乎无限,可以保存几天到几十年的信息。

我们可以考虑,感觉记忆相当于学习不同模态输入的嵌入表示,短期记忆相当于上下文学习,由Transformer的有限上下文窗口长度所限制。长期记忆相当于外部向量存储,可以在查询时通过快速检索访问,克服了注意力范围的限制。

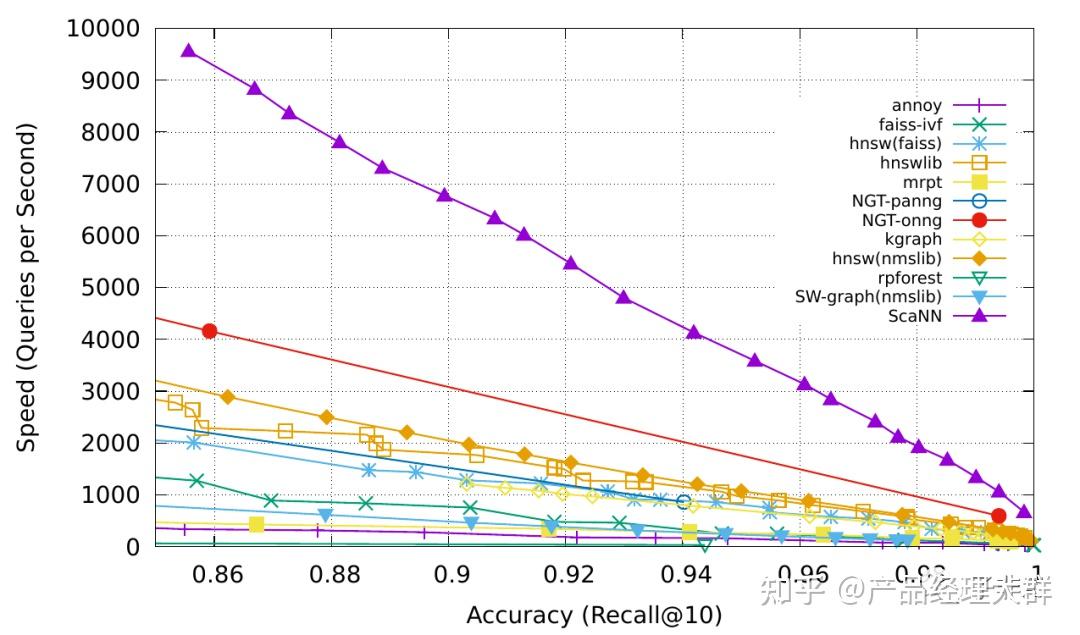

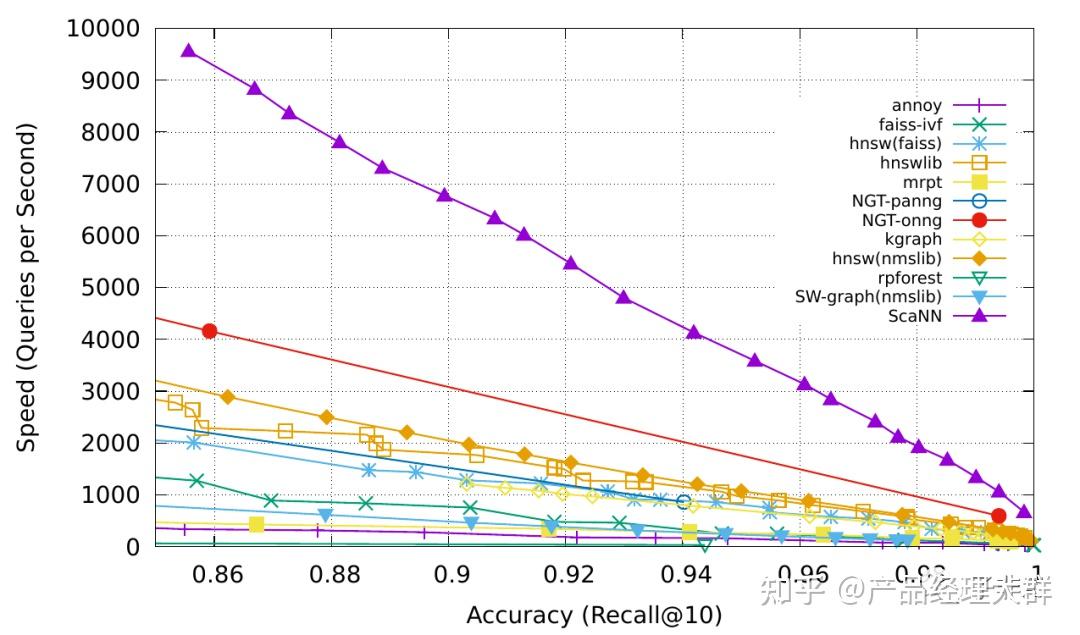

最大内积搜索(MIPS)

外部记忆可以减轻有限注意力范围的约束。一种标准做法是将信息的嵌入表示保存在向量数据库中,支持快速的最大内积搜索。为了优化检索速度,常用的近似最近邻(ANN)算法返回最相近的前k个近邻,以准确性损失为代价换取速度的巨大提升。

几种常用的ANN算法:

LSH:将相似输入映射到同一个存储桶来实现“相似输入hash到相同桶”。

ANNOY:核心数据结构是随机投影树,非叶节点表示划分输入空间的超平面。

HNSW:受小世界网络启发,在层次结构中创建数据点间的快捷方式。

FAISS:基于高维空间内节点间距离近似遵循高斯分布的假设进行向量量化。

ScaNN:其创新之处在于采用各向异性向量量化,使内积尽可能接近原始距离。

工具使用是人类非常显著和与众不同的一个特征。我们创造、修改并利用外部对象做一些超越我们身体和认知极限的事情。为大语言模型配备外部工具可以显著拓展模型的能力。

MRKL(模块化推理、知识和语言)是一个为自治代理设计的神经符号体系结构。MRKL系统被设想为包含一组“专家”模块,通用的大语言模型充当路由器的角色,将查询路由到最适合的专家模块。这些模块可以是神经的(例如深度学习模型)或符号的(例如数学计算器、货币转换器、天气 API)。

他们做了一个使用计算器的微调实验,将算术作为一个测试用例。他们的实验表明,与明确表达的数学问题相比,用自然语言表达的数学问题更难解决,因为大语言模型(7B Jurassic1-large模型)在可靠地提取基本算术运算的参数方面存在困难。结果强调了当外部符号工具可以可靠工作时,知道何时以及如何使用这些工具至关重要,这取决于大语言模型的能力。

TALM(工具增强语言模型)和 Toolformer 都通过微调语言模型来学习使用外部工具 API。如果一个新添加的 API 调用注释可以提高模型输出的质量,那么数据集就会相应扩充。更多细节请参阅“外部 API”部分的提示工程。

ChatGPT 插件和 OpenAI API 函数调用就是在实践中增强大语言模型的工具使用能力的很好例子。工具 API 的收集可以由其他开发人员提供(如插件),也可以是自行定义的(如函数调用)。

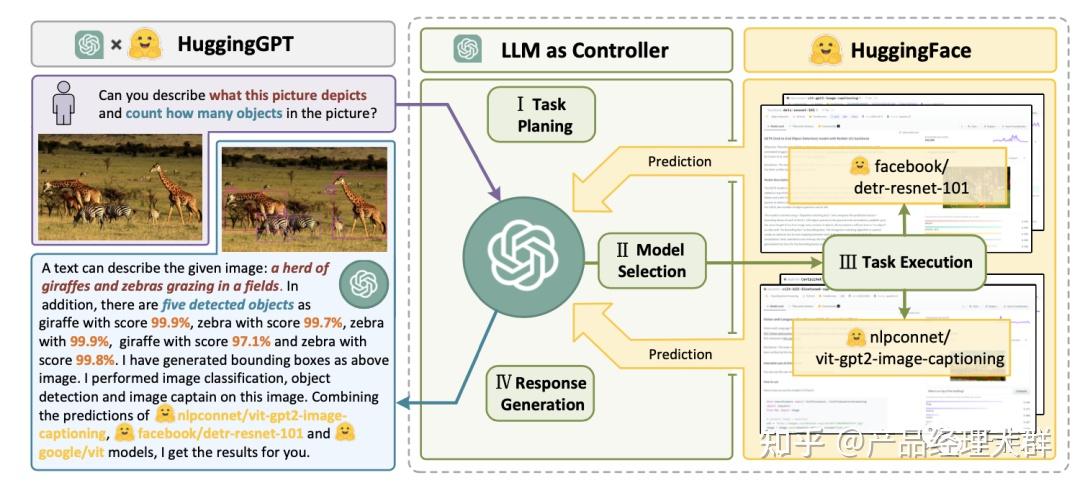

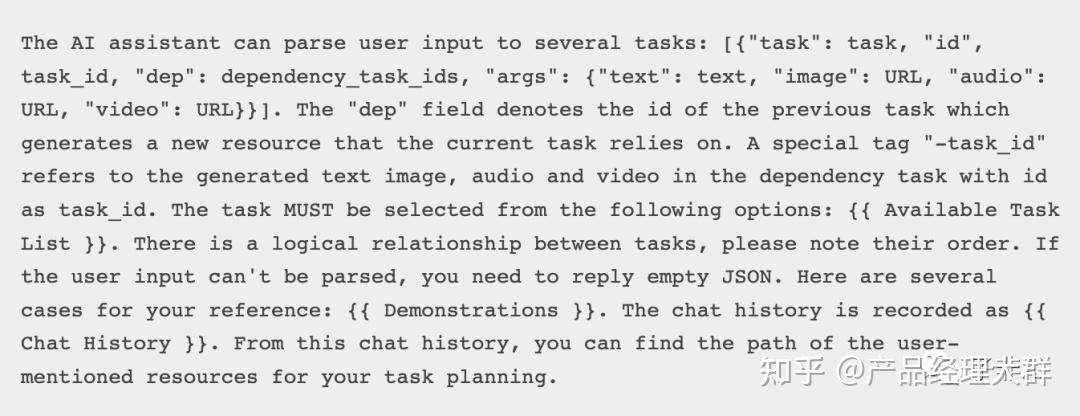

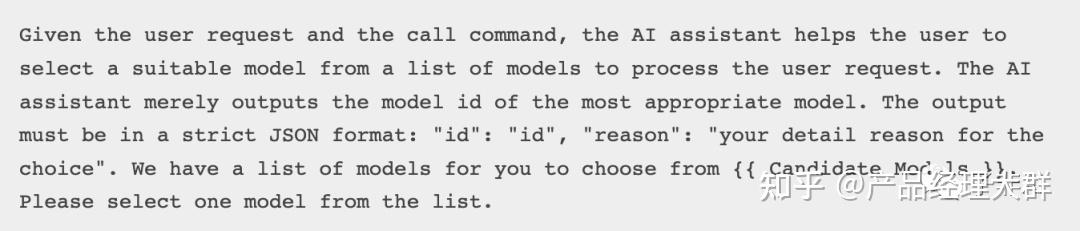

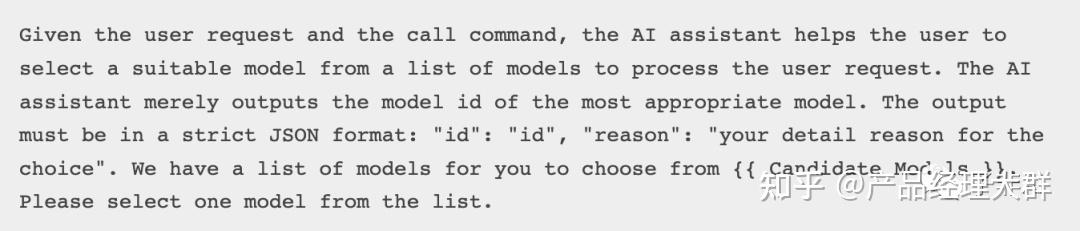

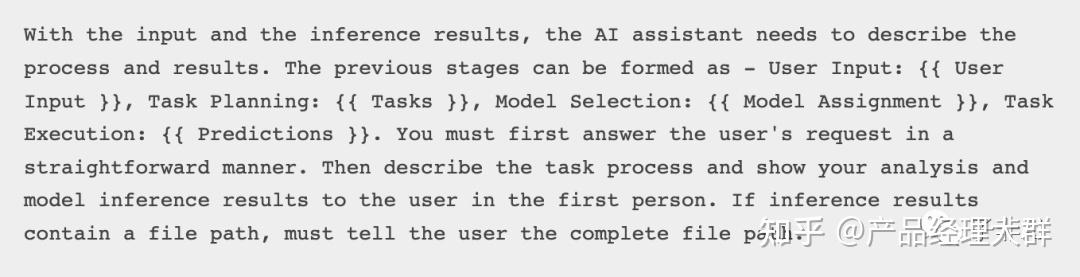

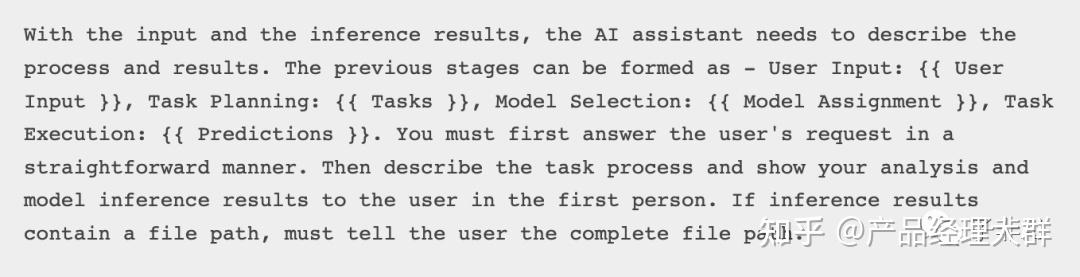

HuggingGPT 是一个框架,使用 ChatGPT 作为任务规划器,根据 HuggingFace 平台上可用模型的描述选择模型,并根据执行结果总结响应。

该系统包含 4 个阶段:

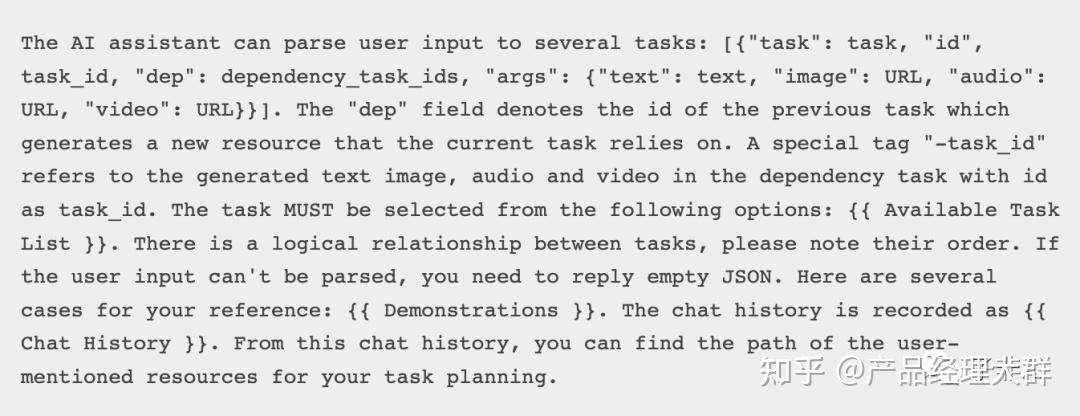

任务规划:大语言模型充当思维大脑,将用户请求解析为多个任务。每个任务都关联有四个属性:任务类型、ID、依赖关系和参数。他们使用了几个示例来指导大语言模型进行任务解析和规划。

模型选择:大语言模型将任务分配给专家模型,其中请求以多项选择题的形式提出。大语言模型需要从一个模型列表中进行选择。由于上下文长度有限,需要按任务类型进行过滤。

任务执行:专家模型针对特定任务执行并记录结果。

响应生成:大语言模型接收执行结果,并向用户提供汇总后的结果。

将 HuggingGPT 付诸实际使用还有一些挑战需要解决:1) 需要提高效率,因为大语言模型推理环节和与其他模型的交互都会拖慢流程;2) 它依赖于长上下文窗口来传达复杂的任务内容;3) 需要提高大语言模型输出和外部模型服务的稳定性。

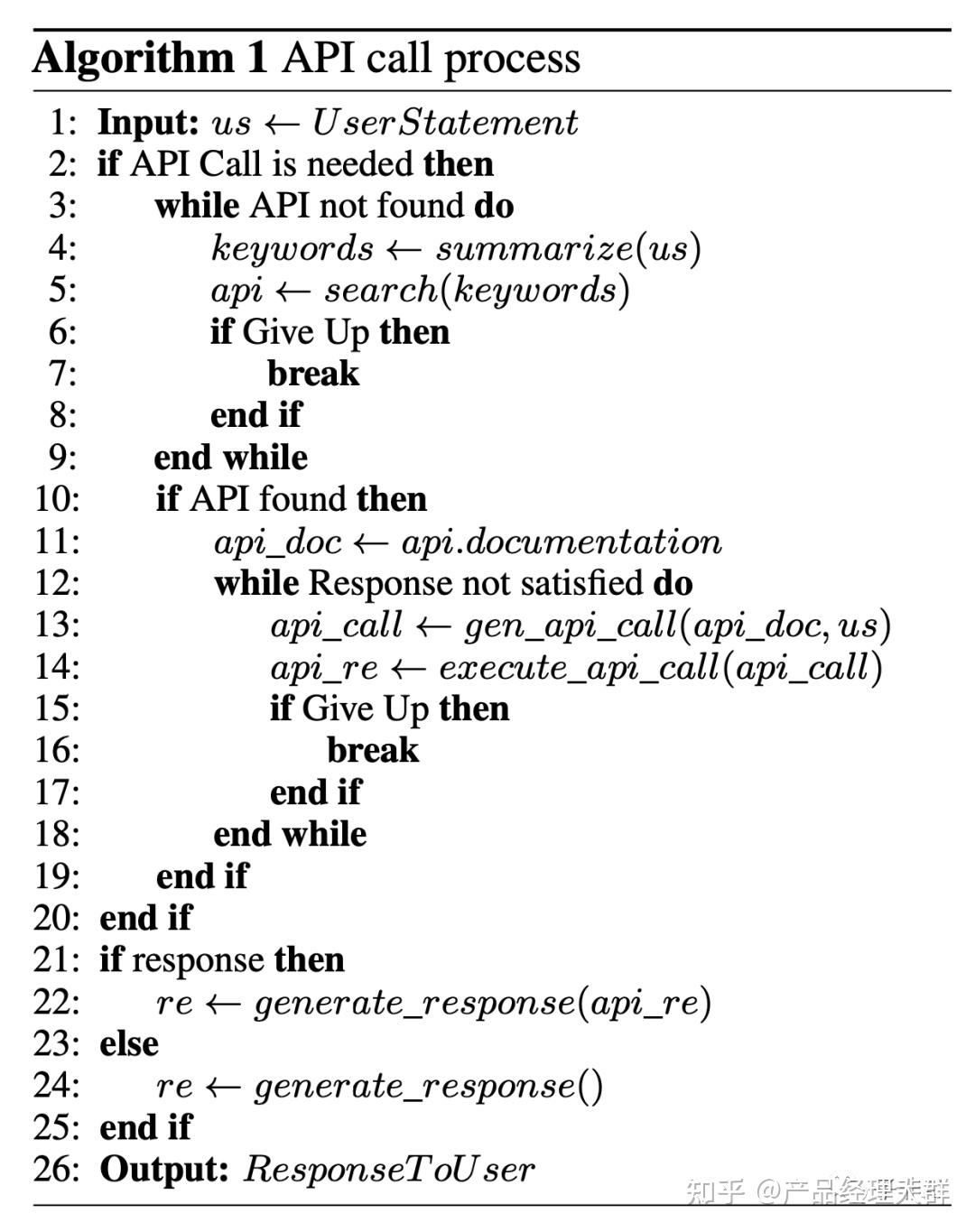

API-Bank是一个用于评估工具增强大语言模型性能的基准。它包含53个常用API工具、一个完整的工具增强大语言模型工作流程和264个标注对话,涉及568个API调用。API的选择非常多样化,包括搜索引擎、计算器、日历查询、智能家居控制、日程管理、健康数据管理、账户认证工作流等。由于API数量众多,大语言模型首先可以访问API搜索引擎找到正确的API进行调用,然后使用相应的文档进行调用。

在API-Bank的工作流程中,大语言模型需要在每个步骤做出决策,我们可以评估每个决策的准确性。决策包括:是否需要API调用、识别正确的API进行调用、根据API结果作出响应等。

该基准在三个层面评估代理的工具使用能力:

第一层面评估调用API的能力。给定一个API的描述,模型需要确定是否调用给定的API,正确调用它,并对API返回作出适当响应。

第二层面检查检索API的能力。模型需要搜索可以解决用户需求的可能API并通过阅读文档学习如何使用它们。

第三层面评估API检索和调用之外的规划能力。给定不明确的用户请求(例如安排小组会议、为旅行订机票/酒店/餐厅),模型可能需要进行多个API调用来解决它。

“通用性”与“先天知识”的结合似乎在今年 3 月 OpenAI 发布 GPT-4 后迎来转机,大规模语言模型(LLMs)的强大能力使得其可以轻松处理多个来自完全截然不同的领域的任务,同时其前身“预训练”的范式又似乎带有一定的“先天知识”而不必后天盲目的试错。

因此使用 LLMs 作为 AI Agent 中的 Agent 成为一条极其有希望成功实现“自主智能体”的技术路径,从而延申出这半年来形形色色的基于 LLMs 的 AI Agent。

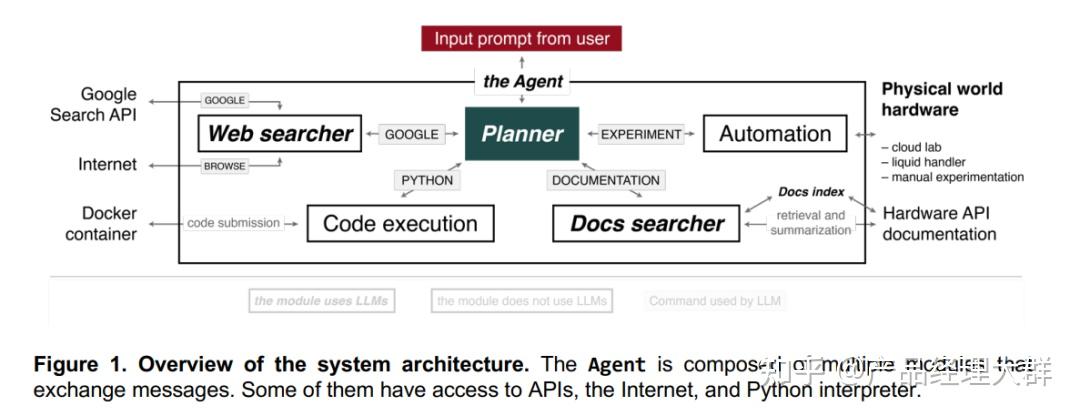

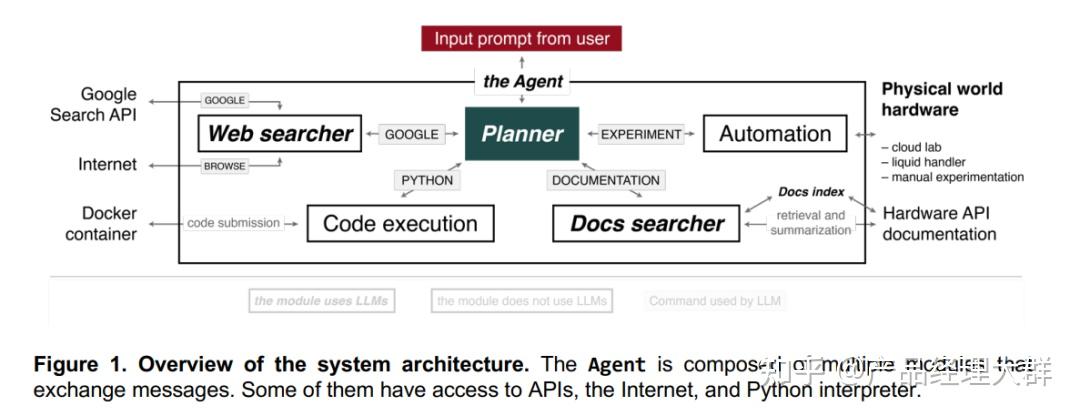

事实上,当大家开始思考“大模型除了 Chat 以外还有什么应用”时,便已经有了基于大模型的 Agent 的想法。四月份我们报道过 CMU 发布的一篇使用大模型作为“自主科研智能体”,在其中大模型充当一个“核心协调器”的作用,向上对接人类的以 Prompt 为形式的输入,向下则以网络搜索,Python 脚本等为媒介沟通互联网或自动化实验仪器等工具,从而可以自主完成从实验设计、实验规划到执行复杂的科学实验等的一整套流程。

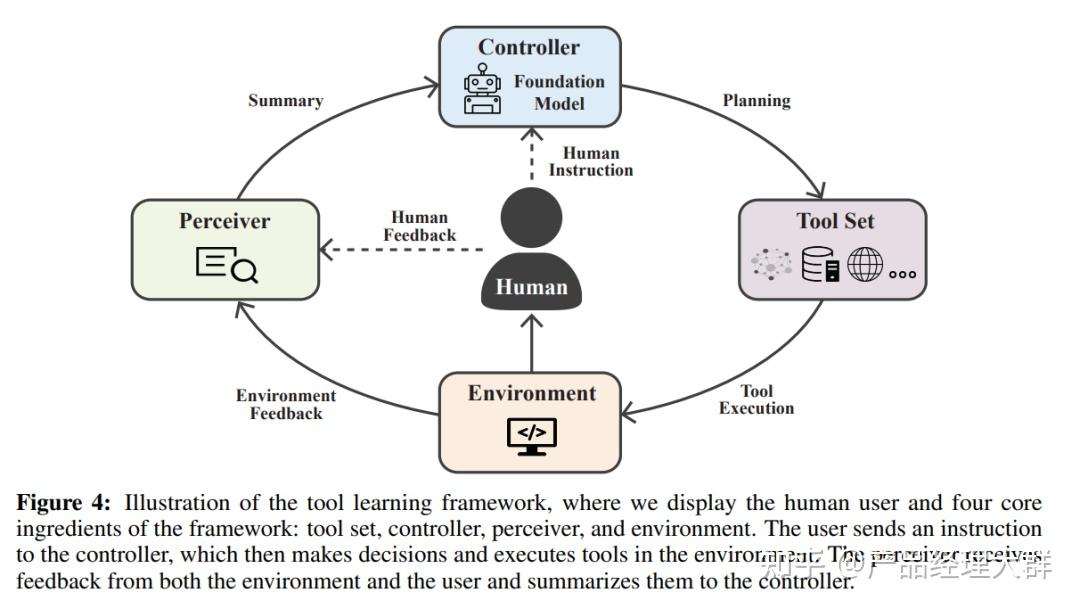

基于类似这样自主科研智能体的形形色色的大模型垂直领域的 AI Agent 论文或工作,也是在四月份,清华大学瞄准“大模型使用工具”,发布了一篇“工具学习综述”:《清华发布工具学习框架,让ChatGPT操控地图、股票查询,贾维斯已来?》,在这篇综述中,清华大学提出了一个叫“Tool Learning”的概念,将之前的各种垂直领域的智能体放置于一个统一的框架之下,其中大模型仍然作为“控制器”,用于完成针对人类的“意图识别”,针对可选工具的“组织规划”,并且引入了“感知器”向大模型报告“执行结果”,当出现错误时指导大模型完成“自主纠错”。

而如果把眼界再打开,不局限于“工具使用”,而是将 AI Agent 建模为一个人脑智能与人工智能协同的过程,面对一个“任务”,由人类站在高点描述一个“任务目标”,并将完成这一任务的工作交予 Agent,而 AI 接受目标并自主的进行“感知环境”,“形成记忆”,“完成规划”,“决策行动”,“观察纠错”等一系列以任务目标为导向的行动,那么就形成了诸如 “AutoGPT”,“BabyGPT” 等基于 LLMs 的 AI Agent 模式。

与其说基于大模型的 AI Agent 是一种“新技术”,不如说基于大模型的 AI Agent 是一套面向 LLMs 的“新的管理方法”,类似“思维链”等技术,大模型 Agent 通过一整套流程化,机制化的方式促使大模型模拟人类智能的决策过程,以代替人类完成一些具体的任务。

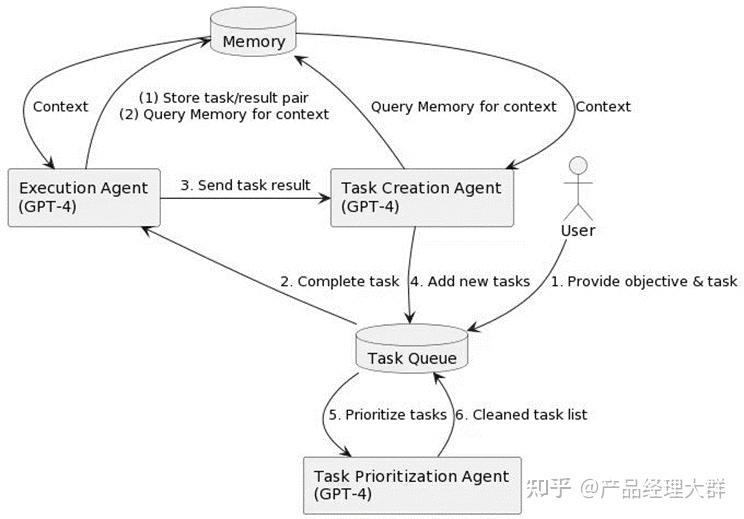

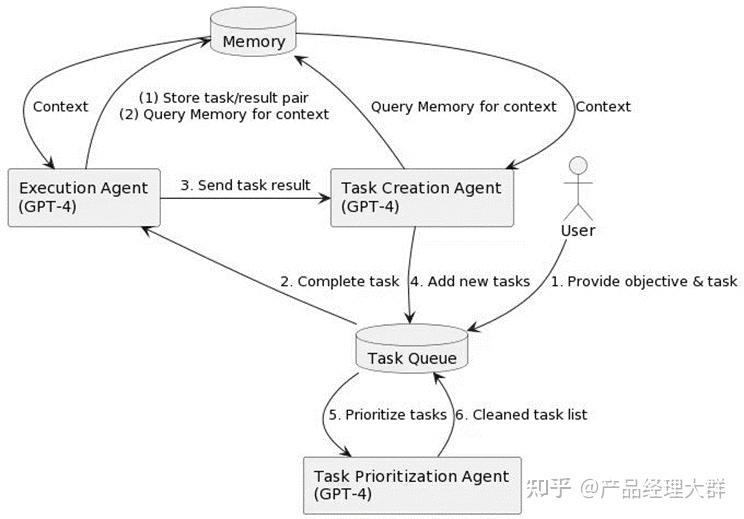

以 BabyAGI 的流程图为例,如下图所示,作为 User 的人类首先向 Agent 以“自然语言”的形式提供任务与目标的描述,放置于任务队列之中(1.),任务优先级 Agent 用于对任务队列任务列表、执行顺序等进行管理(5.)(6.),执行 Agent 不断从任务队列在提取任务(2.),向上联系具体的任务目标,向下联系具体可操作的如“实验设备”,“功能API”,“常用工具”等工具库,用于完成对任务的操作。

在执行过程中,执行 Agent 维护一个记忆库 Memory,储存当下此轮的任务信息,查询历史完成的任务信息。在操作完成后,执行 Agent 向任务创建 Agent 发送任务完成结果(3.),根据任务完成结果,任务创建 Agent 向任务队列增添为完成前项任务所必须先完成的“前置任务”,直到此项任务结束。

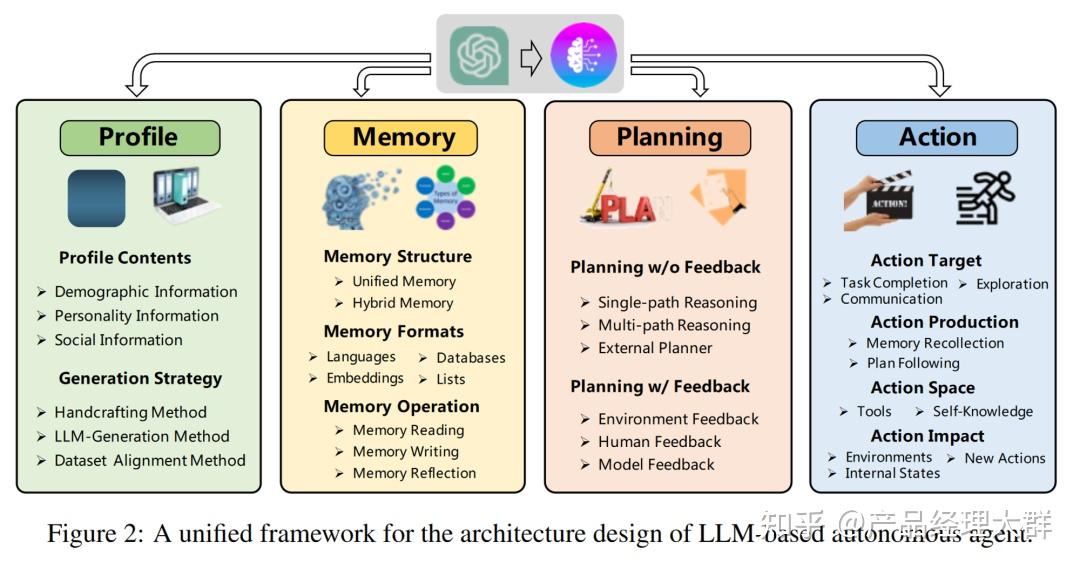

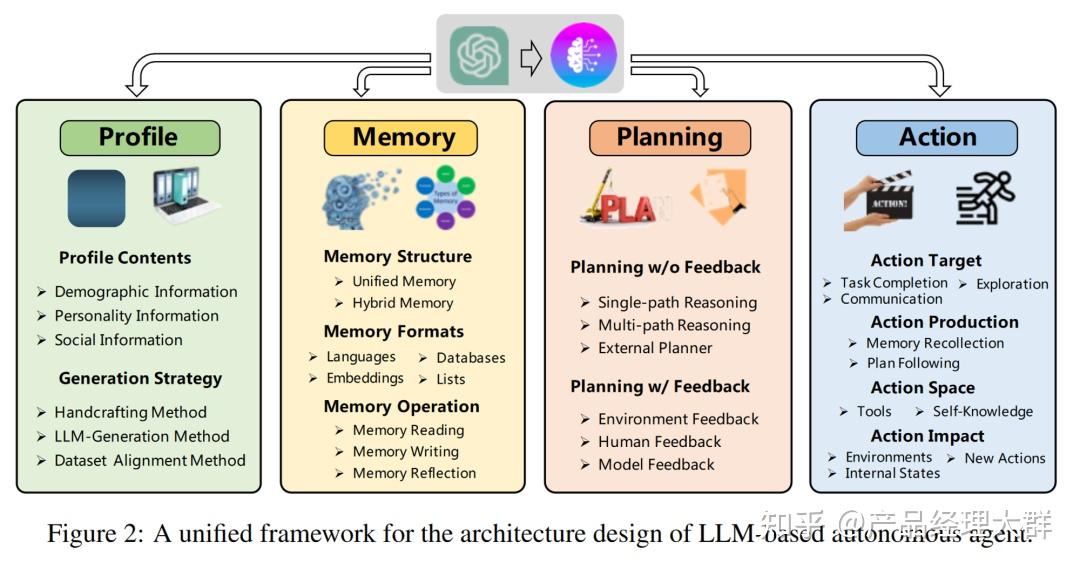

如果对上述框架做一个抽象与总结,参考人大发布的 AI Agent 综述,一个 AI Agent 可以被认为由以下四部分组成:

- Profile:表示 Agent 属性

- Memory:存储历史信息

- Planning:生成计划决策

- Action:执行计划决策

各种不同的 AI Agent 的差异与区别也几乎都从上述四部分展开,譬如在 Profiling 模块,不同的 AI Agent 可以选择不同的角色定义方式,如手动定义“假设你是一个学生”,或者采用大模型对 Agent 角色进行生成。在 Memory 模块,是否区分长期记忆与短期记忆,记忆存储方式(自然语言?数据库?嵌入?)等也构成了不同的 AI Agent 的特征。在 Planning 模块,有无反馈?采用思维链 CoT?思维树 ToT?思维图 GoT?在 Action 模块,单轮互动还是多轮互动,如何定义 Agent 的动作空间,是否使用外部工具,如果定义外部工具集等等也都是 AI Agent 前沿的研究方向。

基于 Prompt 的与大模型互动的方式更像是静态的“输入-输出”,而 AI Agent 为大模型提供了一个进行“动态决策”的框架,使得大模型开始有能力处理任务更加复杂化Agent 智能体,情境更加多样化的决策,为大模型从“语言”迈向“真实世界”提供了一个坚实的基础。

相应的,如果类比于传统软件工程管理与面向 AI 的软件工程管理(MLops),Agent 的出现进一步模糊了软件作为一个输入输出系统“软件内”与“软件外”的边界。由于 Agent 可以不断与与外部环境发生互动,不断的学习修正自己的任务规划,因此当 AI Agent 出现以后,尽管牺牲了一些可靠性,但是这类应用的“灵活性”又迈上了一个新的台阶。

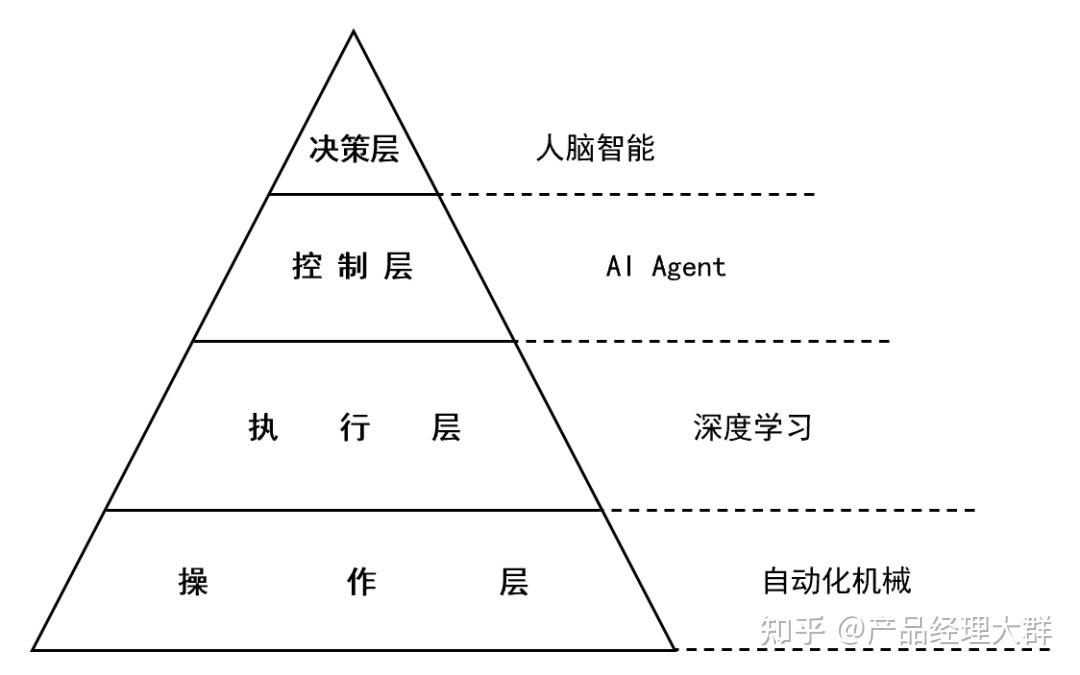

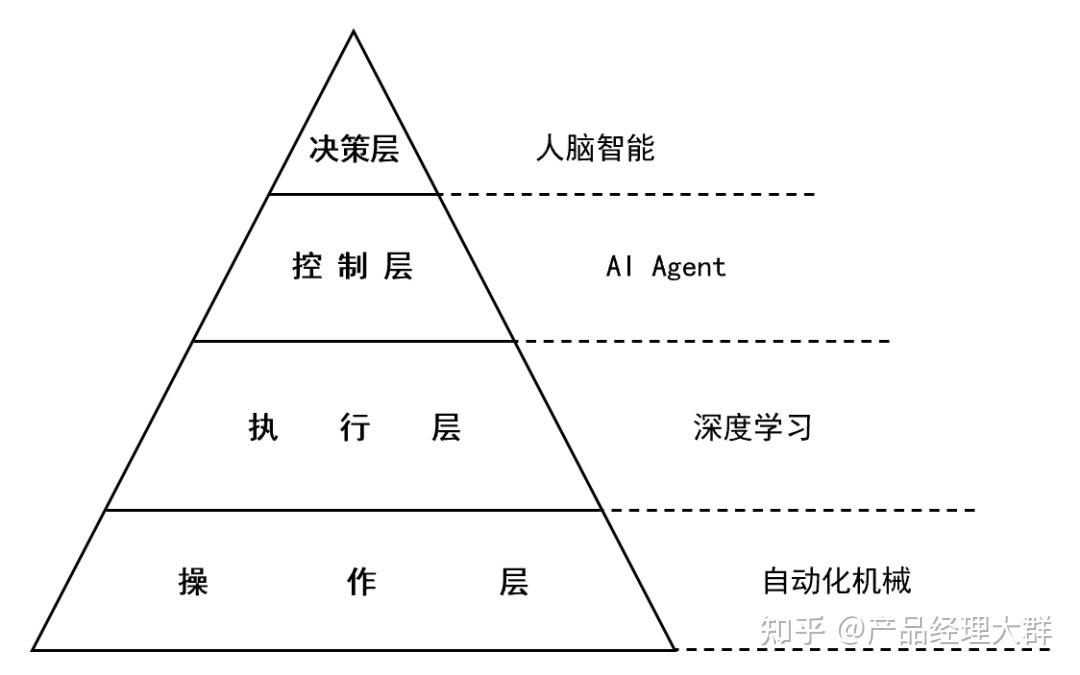

这种跃升将直接导致管理层级(自上而下决策层——>控制层——>执行层——>操作层)中越来越多的任务可以被 AI “自动化”了,如果说传统的自动化机械停留在让决策者在基层操作层执行时“自动化”,而以深度学习为代表的人工智能方法则可以再上一层完成任务执行方案生成时的方案选择“自动化”,那么以大模型 Agent 为代表的新一代人工智能方法则真正实现了控制层一整套决策流程的“自动化”。而这种层面的“自动化”恰恰带来了 Software 2.0 的曙光,软件开发将变成完全的“自动化工厂”,软件层面的“大规模定制”有可能到来。

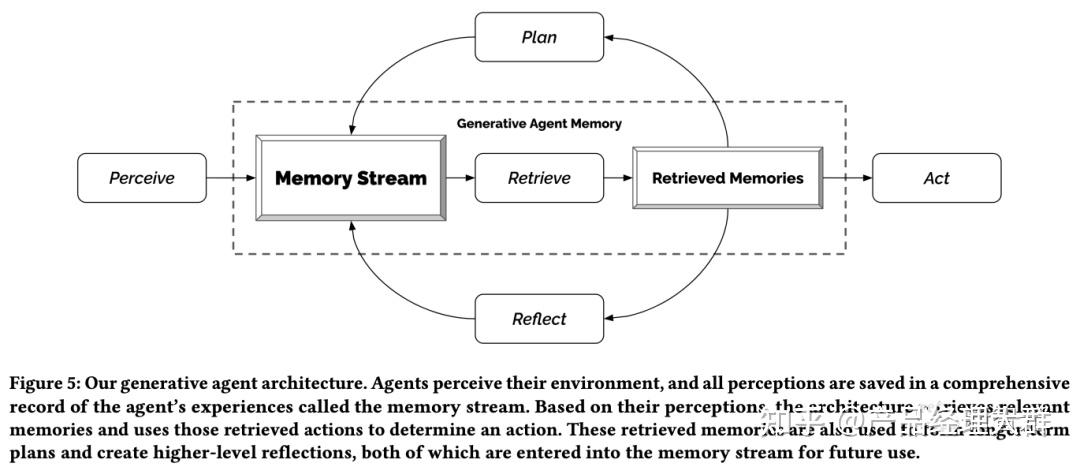

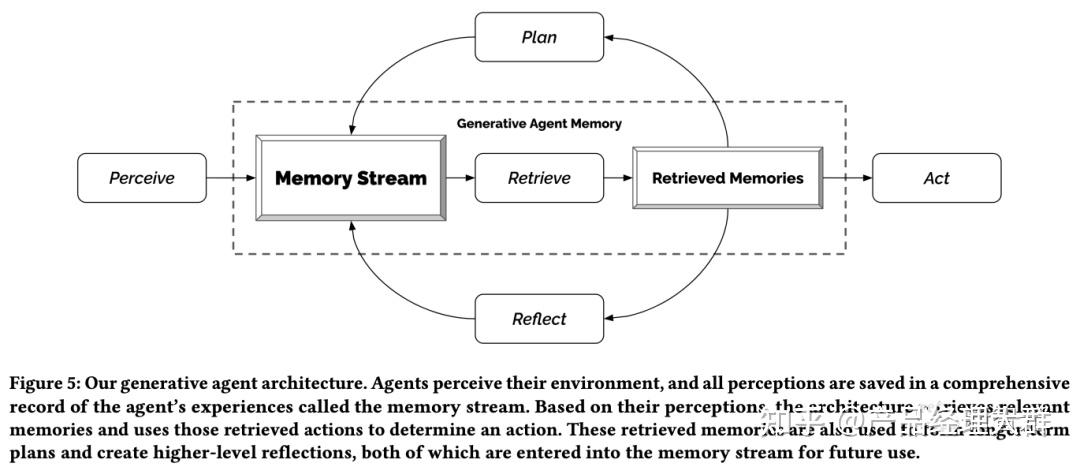

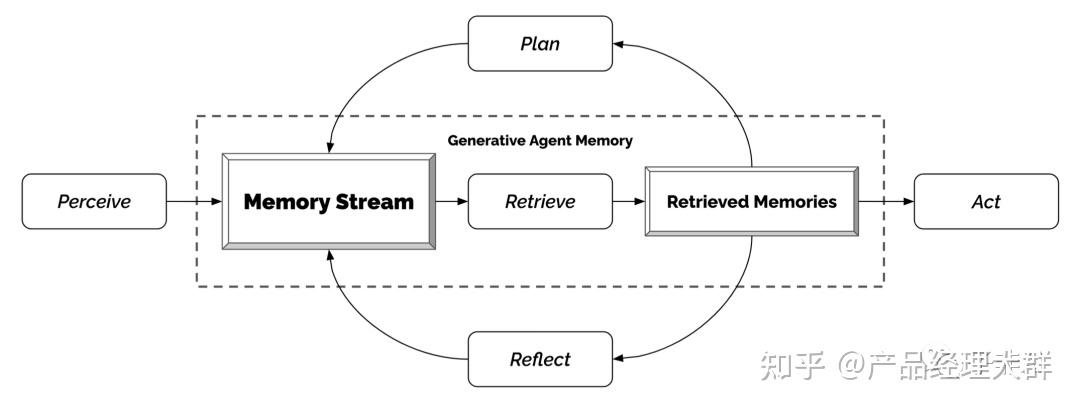

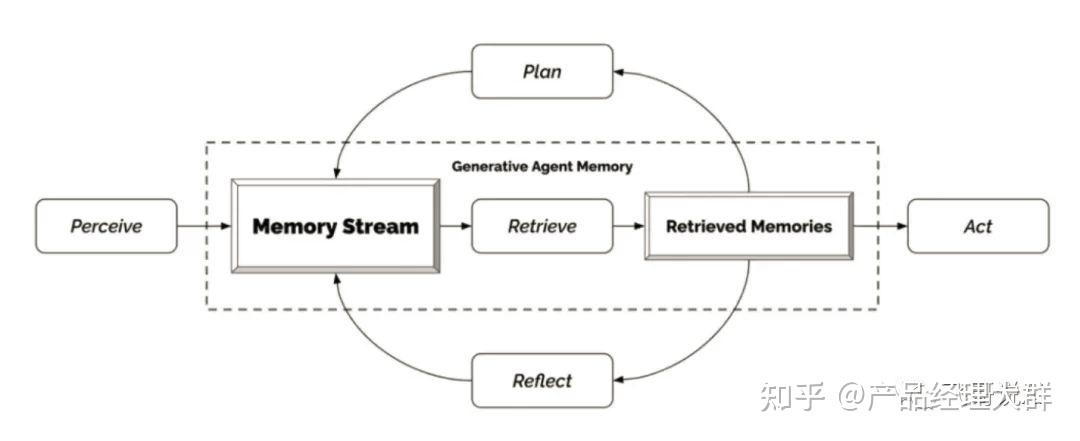

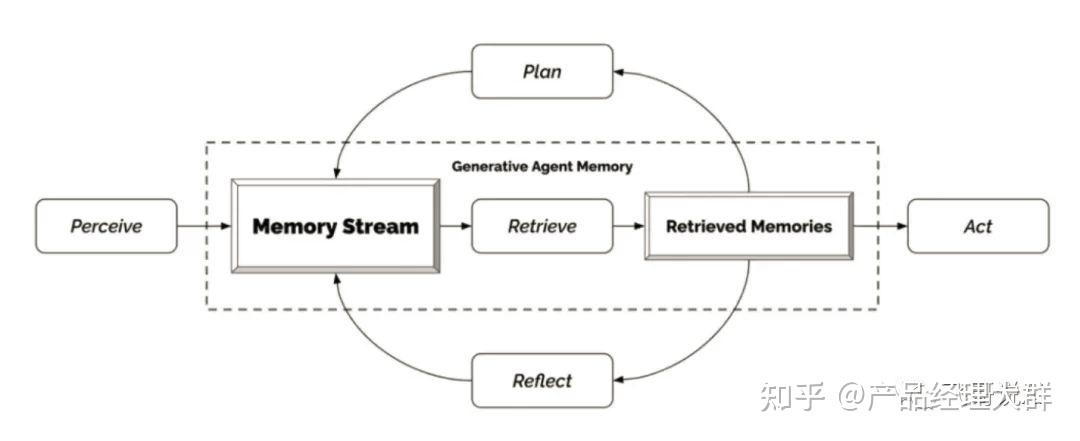

Seednapse AI 的创始人曾给了 AI 应用的五层基石,如果说之前的类似 AutoGPT 的智能体属于自主智能体(Autonomous Agent),其核心思想是“像人类智能一样去解决问题”,那么以斯坦福小镇为代表的生成智能体(Generative Agent)可能带来 Multi-Agent 的曙光,区别于“像人类智能一样去解决问题”,生成智能体的核心在于“像社会智能一样去解决问题”。在斯坦福 25 人小镇的论文中构建了生成智能体的架构如下图所示:

通过使用一种“记忆—计划—反思”驱动的智能体形态,以“社会事件”为动力源使得 Agent 间相互互动,直至模拟整个社会的分工体系。在这种生成智能体的思想下,一群导演与计算机工程师踏出了生成智能体应用的第一步,尝试制作了一部完全由大模型自导自演、定制化的电视剧集 Westland Chronicles

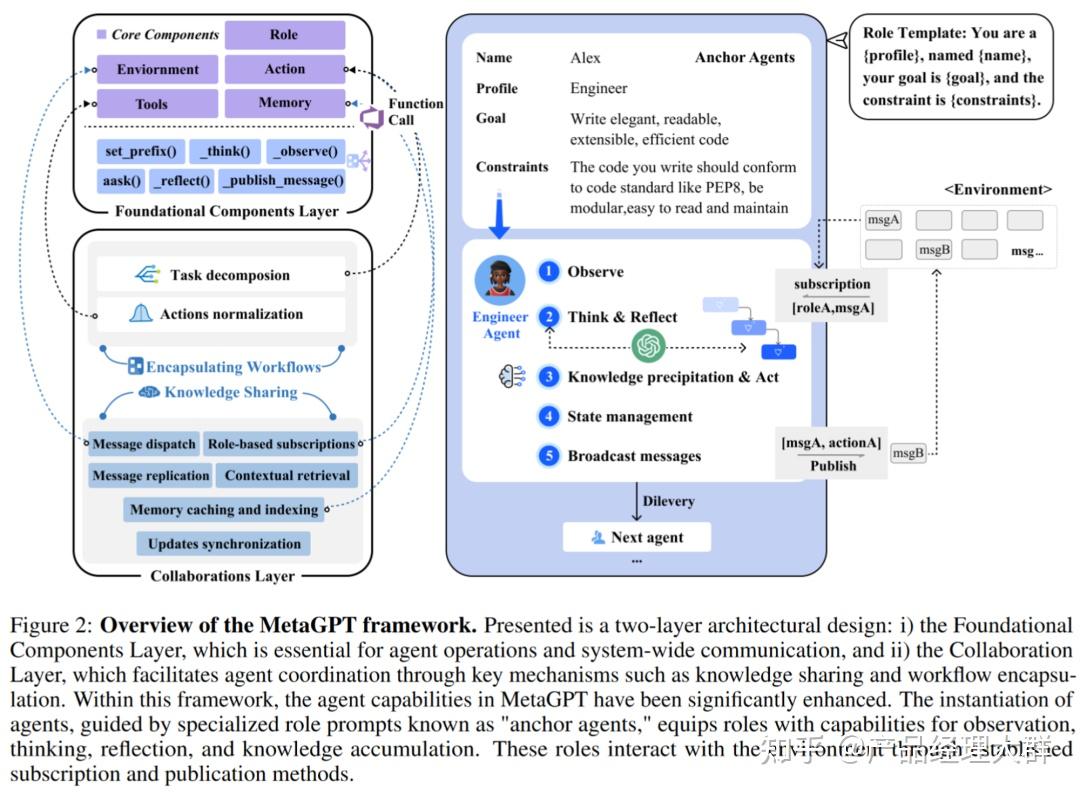

而从实验性质的模拟向下,类似 MetaGPT 等的多智能体 AI 框架逐渐诞生,通过模拟不同角色之间的“合作”,最终实现“生成一个包含分析和设计的示例大约需要0.2美元(GPT-4 API的费用),而一个完整的项目大约需要2.0美元。”

科学发现代理

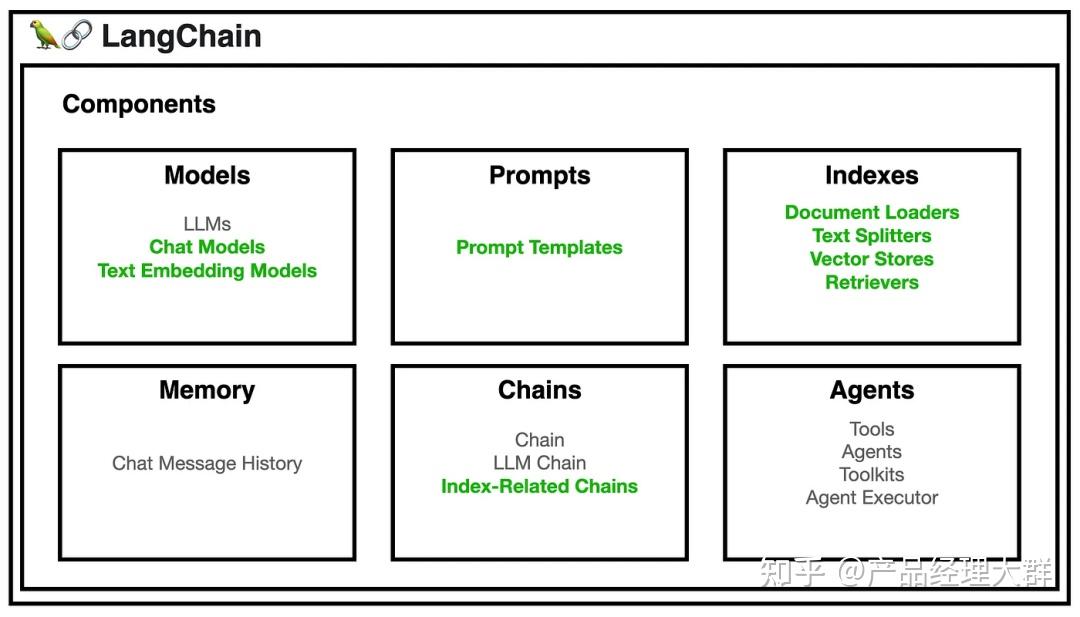

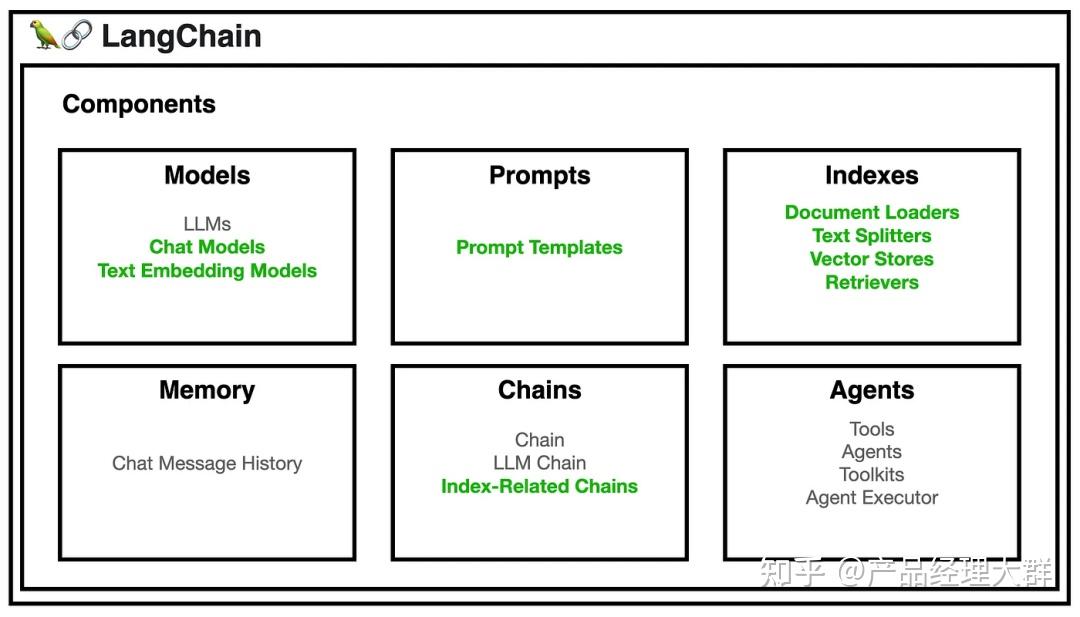

ChemCrow是一个特定领域的例子,其中大语言模型被增强了13个专家设计的工具,以完成有机合成、药物发现和材料设计等任务。该工作流程在LangChain中实现,它结合了CoT推理和与任务相关的工具:

– 向大语言模型提供一份工具名称、描述和预期输入/输出细节的列表。

– 然后指示它使用需要时的工具来回答用户给定的提示。该指令建议模型遵循ReAct格式 — 思考,行动,行动输入,观察。

一个有趣的观察是,而基于大语言模型的评估得出GPT-4和ChemCrow的表现近乎相当,但人工评估重点关注解决方案的完整性和化学正确性表明,ChemCrow明显优于GPT-4。这表明使用大语言模型评估其在需要深厚专业知识的领域自己的表现可能存在问题。缺乏专业知识可能导致大语言模型不了解自己的缺陷,因此不能很好地判断任务结果的正确性。

生成代理模拟

Generative Agents是一个非常有趣的实验,25个由大语言模型驱动的代理虚拟角色生活和互动在一个沙盒环境中,灵感来自The Sims。生成代理制造了可信的人类行为仿真,用于交互式应用程序。

生成代理的设计将大语言模型与记忆、规划和反思机制相结合,使代理能够基于过去的经验进行行为,并与其他代理互动。

– 记忆流:是一个长期记忆模块(外部数据库),以自然语言记录代理丰富的经验。每个元素是一个观察或事件,由代理直接提供。- 代理之间的交流可以触发新的自然语言语句。

– 检索模型:根据相关性、近期性和重要性显示上下文,以影响代理的行为。

– 近期性:近期事件得分更高

– 重要性:区分平凡和核心记忆。直接询问大语言模型。

– 相关性:基于它与当前情况/查询的相关程度。

– 反思机制:随时间合成记忆为更高层次的对过去事件的推断,并指导代理的未来行为。它们是过去事件的更高层次总结(<- 注意这与上述自我反思略有不同)。

– 用近100个最新观察结果提示大语言模型,并在一组观察/语句的基础上生成3个最重要的高层问题。然后要求大语言模型回答这些问题。

– 规划和反应:将反思和环境信息转换为行动

– 规划本质上是为了优化当前的真实感与时间上的真实感。

– 提示模板:{代理X的介绍}。以下是今天X的计划要点:1)

– 代理之间的关系和一个代理对另一个的观察都会考虑进规划和反应中。

– 环境信息以树结构呈现。

这个有趣的模拟产生了新兴的社会行为,例如信息传播、关系记忆(例如两个代理继续谈话主题)和社交活动的协调(例如主持派对并邀请许多其他人)。

经过对构建以大语言模型为中心的代理的关键思想和演示的了解,我开始看到一些常见的局限:

有限的上下文长度:受限的上下文容量限制了历史信息、详细指示、API调用上下文和响应的包容性。系统设计必须以这种有限的通信带宽工作,而自我反思等机制从过去的错误中学习会大大受益于长或无限的上下文窗口。尽管向量存储和检索可以提供访问更大的知识库的途径,但它们的表达能力不如完整的注意力。

长期规划和任务分解的挑战:在长度更长的历史 Background 上进行规划和有效地探索解决方案空间仍具有挑战性。当面对意外错误时,大语言模型难以调整计划,这使它们比通过试错学习的人类少了鲁棒性。

自然语言接口的可靠性:当前的代理系统依赖自然语言作为大语言模型与外部组件(如记忆和工具)之间的接口。然而,模型输出的可靠性值得质疑,因为大语言模型可能会产生格式错误,偶尔也会表现出反抗行为(例如拒绝遵循指示)。因此,许多代理演示代码侧重于解析模型输出。

还有许多有待研究的问题,但基于大语言模型的代理是非常令人兴奋的研究方向,在过去一年中取得了长足的进步。将神经和符号技术的优点结合在一起,可能会为更 capable 和 reliable 的自主代理铺平道路。

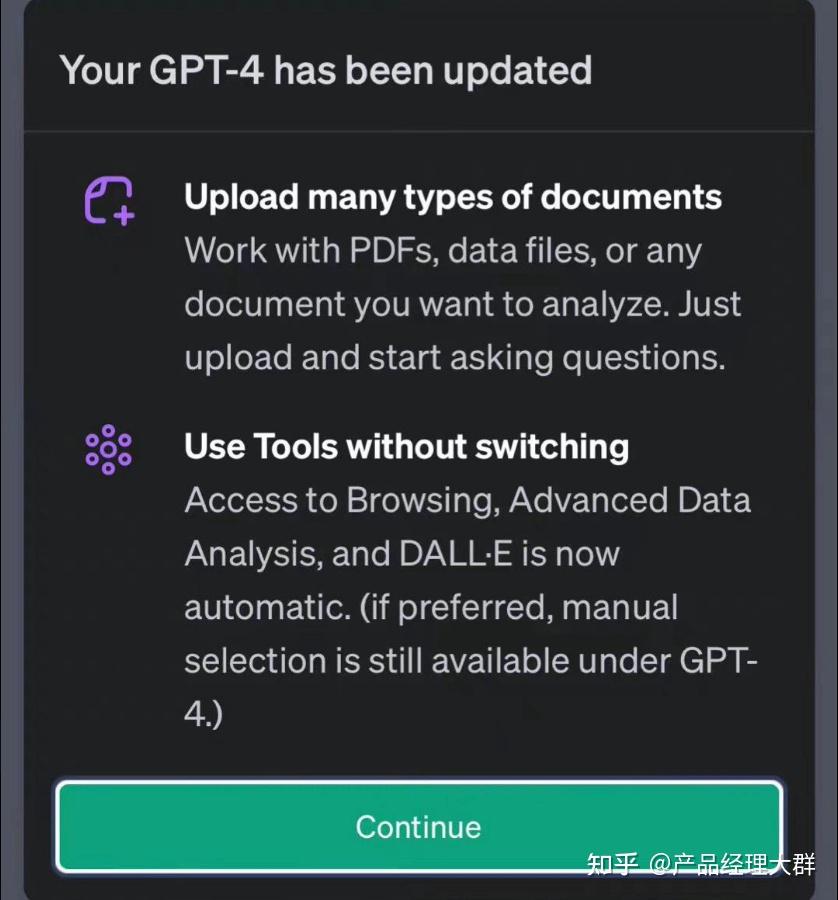

回到最开始,AI Agent 作为 “OpenAI 发力的下一个方向”,背后蕴含了一个天文数字量级的市场。前两天爆出 OpenAI 已经在进行灰度测试,未来很快将放出一个可以使用所有工具的 GPT-4(All Tools)版本,真正成为一个“理解一切,处理一切,生成一切”的超级统一智能体(重磅!GPT-4又进化了!画图、插件、代码等能力被整合,超级智能体来了)

当这样一种 AI Agent 出现,它对生活的改变很有可能不止于 ChatGPT 简单的 Chat,而是渗透入各行各业,在只要能用到大模型的地方就可以建立起相应的 Agent,各种科幻电影中的人机协作有可能真的会走进现实。

当然,目前这样一种 AI Agent 的技术落地尚处于“婴儿时期”,如同 BabyGPT 的名字那样,目前的 AI Agent 的技术还远远无法匹配我们宏大的想象。试错与学习能力不足、复杂推理能力不强、精确决策能力不够、响应时间过长、计算资源要求过高等等由限制着大模型 AI Agent 成为真正的“贾维斯”,但是,未来已来,引用迪迦奥特曼的主题曲《奇迹再现》的歌词:“新的风暴已经出现,怎么能够停滞不前……”

现在的 Agent 还是山顶洞人,但多AI Agents互动会改变一切。而哪些行业会最先被Agent颠覆,哪些行业不会那么快?

在灵感来自模拟人生游戏的Generative Agents实验中,其每个角色都分别由一个 AI Agent 控制,它们在沙盒环境中生活和互动,充分体现了将反馈和环境信息转化为行动的过程,实现 AI Agents 的「社交」。其中在规划和反应的环节,AI Agents 会充分考虑彼此之间的关系,以及一个 Agent 对另一个 Agent 的观察和反馈,来采取下一步动作。这个有趣的模拟随之引发了一些戏剧化的社会现象,比如「谣言」的扩散、关系记忆等,在实验中经常出现两个 AI Agents 在聊天中延续他们之前的话题、办Party、呼朋唤友等社交活动。

显然,Agent 的真正落地,一定是建立在对环境的感知、动态学习,以及不断更新之上的。

由于Agent并非能实现通用,Agent并非一家独大,而是将形成一个非常长尾的供应商格局。市场上将会有很多Agent,每一个 Agent 都由不同的公司运营。

如同上一代NLP,很多AI公司都提供智能客服或自动外呼服务,但每一家公司只能服务少数的客户,无法形成规模效应。基于今天对Agent的技术判断,与上一代并无太大区别。虽然LLM的语义理解是通用的,但是我们之前讨论过的Agent的环境、领域结合并不通用,这会导致市场非常分散,没有强者越强的公司出现。当然,Agent也分为深度(专业)和浅度(通用)两种类型。

参考资料:

细说复旦大学,斯坦福大学智能代理AI-Agent(二更)

读懂AI Agent:基于大模型的人工智能代理

Agent:使用大语言模型驱动的自治智能体

LLM Powered Autonomous Agents

现在我们每天都在用AI聊天、画图、生成文章,写周报等等,感觉它已经成为了不可或缺的“工具人”,AI确实也已经从一个“你问一句、它答一句”的聊天机器人模式,正在逐渐变成一个能独立思考、自己动手的个人助理,这个做更多工作的助理背后就是AI Agent在发挥作用。

简单打个比方:

普通AI:像一个知识渊博的“顾问”。你问他“巴黎有什么好玩的?”,他会给你一份详尽的清单。但他不会帮你买机票、订酒店 。

AI Agent:更像一个能干的“行政助理”。你跟他说“帮我搞定下周去巴黎的五日游”,他会自己去查航班、比价、授权账号就能实现酒店和机票的预定。

核心区别就两个字:自主 。Agent不是被动地等你下达一步步的指令,而是能主动地为了一个总目标去干活 。

那Agent 是怎么“思考”和“行动”的?

所有Agent,不管多复杂,目前的范式都遵循一个简单的循环:“感知 → 思考 → 行动,持续迭代” 。

感知:就是外界的输入,通过提示词,数据接口、文档等外部资源来了解外部世界的情况 。

思考:这是它的“大脑”,分析收集来的信息,制定一个行动计划 。

行动:通过调用代码、访问网站等“手脚”去执行计划 。

这个循环一旦跑起来,AI就不再是个只会响应的chatbot,而是个真正的“办事员”了。

但其实Agent 不止一种,但现在我们聊的主要是大模型驱动的agent(这个后面会解释)。

其实AI Agent这个概念存在已久。比如,DeepMind的AlphaGo就是一个典型的强化学习(RL)Agent 。它就像一个特定领域的专家,通过在特定规则下(比如围棋)进行海量的自我对弈和试错,从经验中学习,最终达到了击败世界冠军的围棋博弈水平 。

但是,今天引爆科技圈、让每个人都感到兴奋的,是构建在大语言模型(LLM)之上的Agent。它们是“通才”,利用LLM强大的知识和推理能力,能处理五花八门的开放式任务 。所以,现在大家通常说的AI Agent,基本可以默认是指 LLM Agent。

LLM agent和LLM的区别是什么呢?一个强大的LLM Agent,真是基于LLM的能力基础上扩展它的行动能力。它是一个高度协同的系统,我们可以把它想象成一个拥有大脑、思维、记忆和双手的“数字人”。

大脑 (LLM核心):这就是Agent的认知引擎,比如目前公认最强的GPT-5或Claude opus 4.1,国内最强的是最近两天刚发布的deepseek v3.1 terminus和qwen3-max。它是agent的核心,所有负责理解意图、进行常识推理和制定规划,进行反思的设计到逻辑推理的任务都由它来完成。

记忆 (短期与长期):为了不犯“聊完就忘”的毛病,Agent必须有记忆,一般分为短期记忆和长期记忆。短期记忆通常就是LLM的上下文窗口,用来记住当前任务的对话和进度 ,在agent执行复杂任务的过程中,还需要记录每一轮完成了什么,让llm来判断下一轮该干什么。

长期记忆:通过外挂向量数据库等技术,Agent可以“记住”跨越多次对话的长期信息,比如你的个人偏好、公司的常用数据格式等,让服务更具个性化和连续性 。比如chatgpt就实现了长期记忆功能,你和它聊天的过程中它能记得你之前聊过的的项目,但有时会太刻意的带入,这也说明记忆机制要用好难度挺大的。

双手 (工具使用):这是Agent能真正“做事”的核心 ,agent的“大脑”会判断在哪个步骤需要用哪个工具,然后通过一种叫函数调用 (Function Calling) 的技术,生成一个标准化的“指令单”(比如一个JSON对象),精确地告诉系统该调用哪个API、输入什么参数 。这些工具比较常见的包括:

网络搜索引擎:获取最新信息,克服LLM知识截止的限制。

代码解释器:进行精确的数学计算或数据处理。

数据库接口:查询公司内部的私有数据。

各种应用API:发邮件、订日程、管理订单等等。

现在agent的工具调用已经有了一套公认的技术规范,就是anthropic公司推出的MCP协议,实现了工具(数据)和模型之间的通信规范,可以更规范高效的实现工具调用和维护。

那AI Agent 已经能做什么了?比较成功的一个落地领域就是编程领域,也就是经常听到的vibe coding,可以实现一句话就完成一个简单项目开发,网页小游戏,办公小工具已不再话下,但是相对复杂的项目还没发实现完全自动化,仍然需要人在环路(human in loop),就是需要人一直参与到整个过程的开发,但是人大部分时候只需要评估实现是否合理,提出修改需求,绝大部分代码都是由coding agent完成了。

另外其他落地的现实场景,相对还是一些单场景人物,比如ppt制作,数据分析,市场调研之类的办公助手,或者有明确流程,但人工判断/操作比较繁琐的业务场景,比如智能客服,合同审查。复杂场景还很难落地的原因主要是模型长程规划能力还比较欠缺,规划稳定性,工具执行准确率不足,记忆机制与上下文窗口限制平衡,业务场景权限控制等多方问题。

另外还有一个比较有意思方向是多Agent协作(multi-agent),就是同时构建多个agent,通过agent协作来完成任务。比如我们可以组建一个“Agent团队”,在一个虚拟软件公司里,有负责沟通需求的“产品经理Agent”,有负责设计的“架构师Agent”,还有负责写代码的“工程师Agent”,它们各司其职,协同完成一个复杂的项目 ,matagpt和chatdev就是这样的思路,感兴趣可以查看原论文。

总结下,AI Agent就是给AI(大模型)加上自主行动能力,像人类解决问题一样不断的思考行动,直到完成目标,这也标志着AI从一个“被动的工具”向一个“主动的助手”的根本性转变,这也是AI推动社会现实场景任务产生深远变革的一个起点。

发布者:全栈程序员-站长,转载请注明出处:https://javaforall.net/277070.html原文链接:https://javaforall.net