最近好火啊,体验了技术同事的小龙虾🦞,真是厉害,但是我是市场部门不会代码🥲有没有啥一键本地部署的方法啊?求大佬们指点

有,而且就是为你这种情况准备的。

先说结论:getaclaw.ai,下载安装包,双击,跟着中文引导走,15分钟装好,不需要懂任何代码。

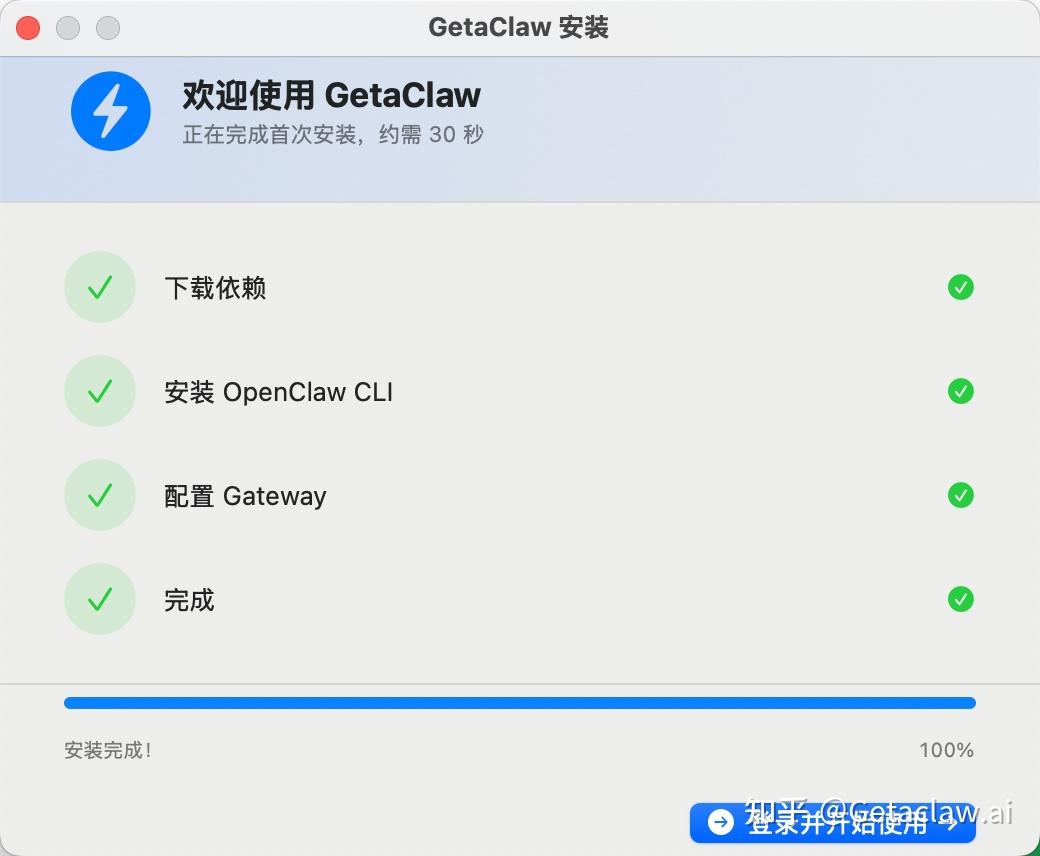

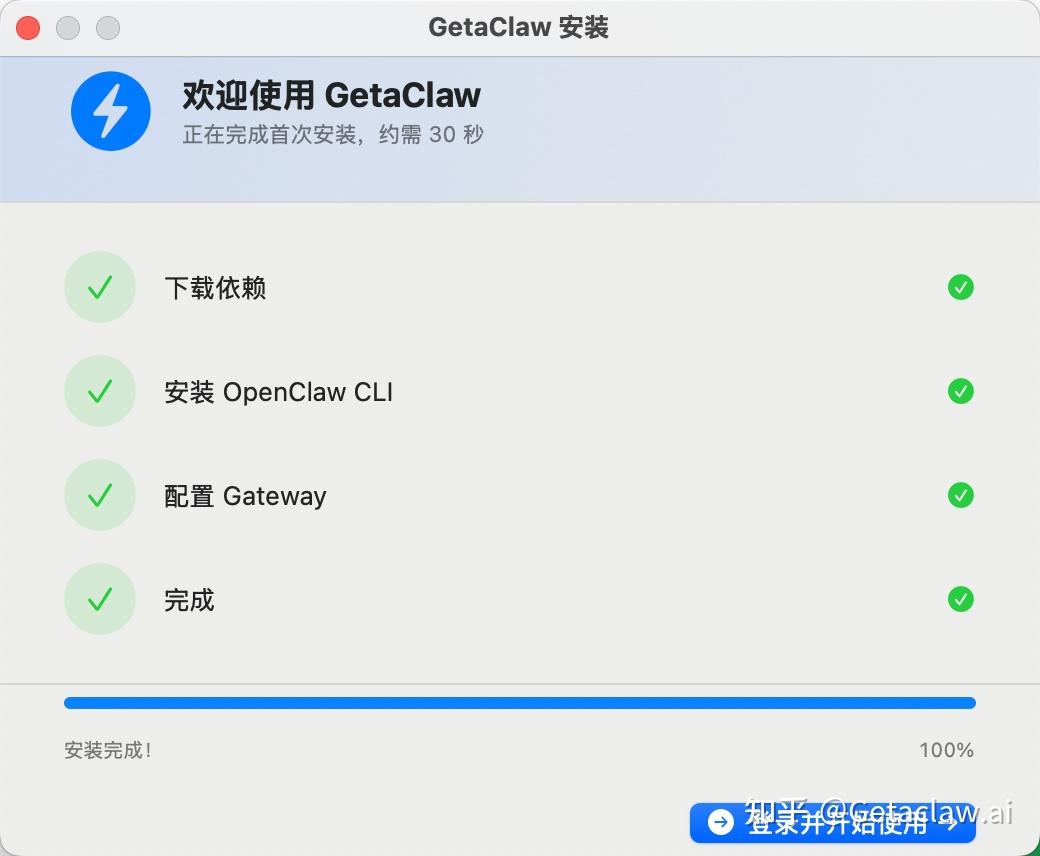

以下是简单的安装过程∶

openclaw 部署

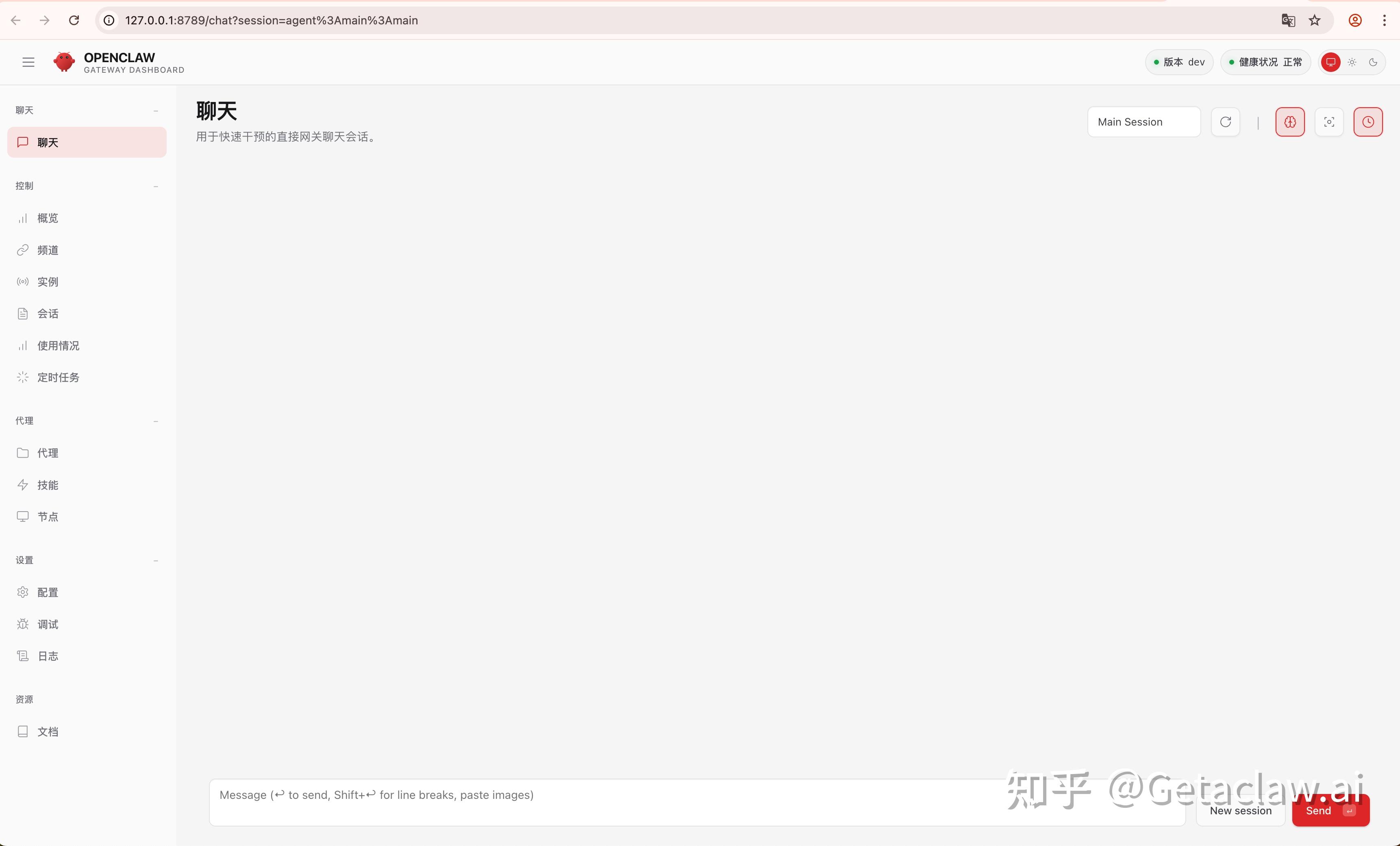

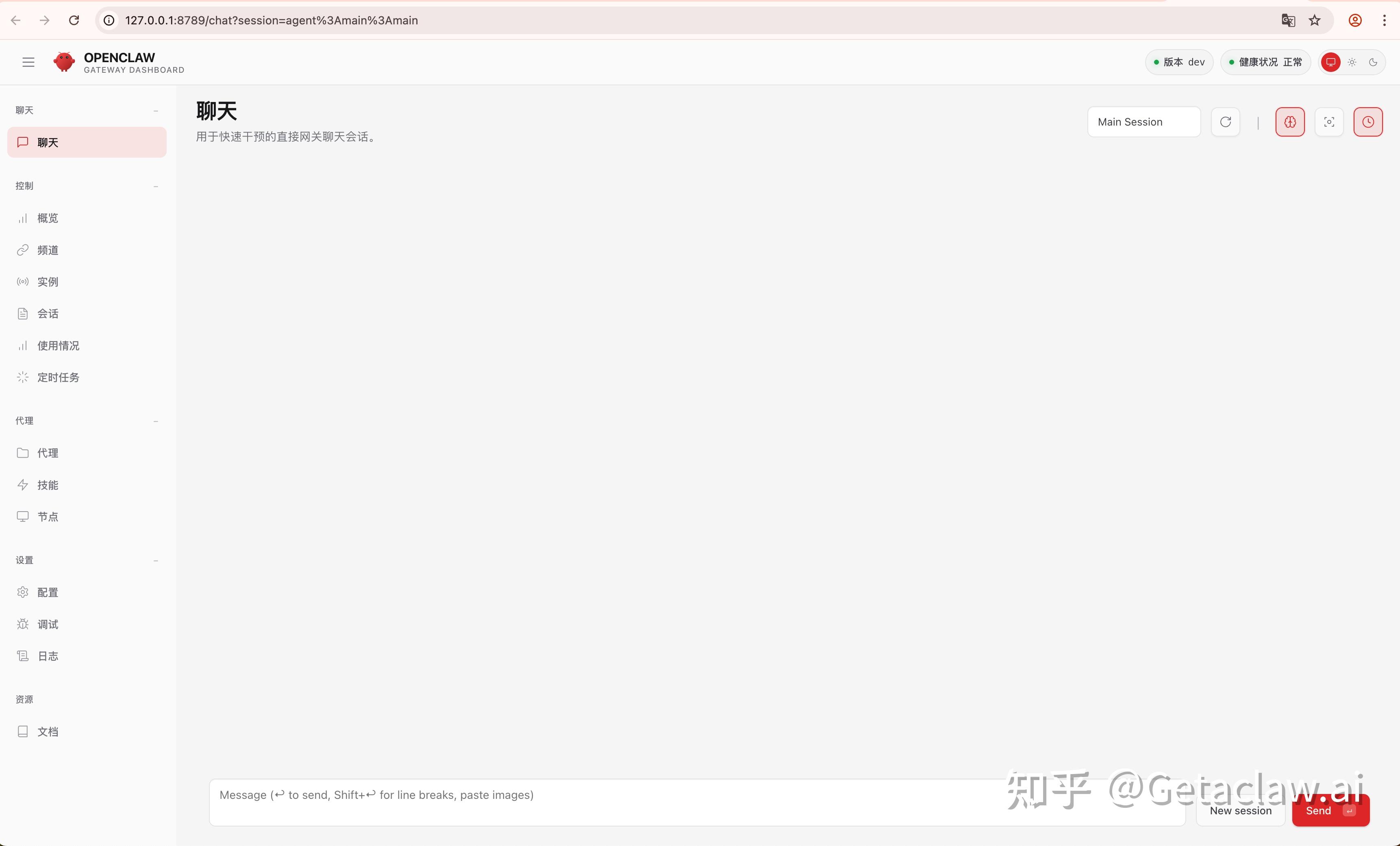

openclaw 部署注册成功后就可以进入登录界面,开始使用∶

为什么大多数教程对你没用

搜”OpenClaw部署教程”,大概率看到的是:先安装 Node.js,然后 npm install -g openclaw,配置 Gateway,修改 JSON 文件……

对技术同事来说这是家常便饭,但对市场、运营、HR来说,第一步就可能卡住。我见过不少人折腾了大半天,最后放弃。这不是你的问题,是工具门槛的问题。

一键方案怎么操作

- 打开 getaclaw.ai

- 下载对应系统的安装包(Windows / macOS 都有)

- 双击安装,全程中文提示

- 装好之后,可以直接接飞书、钉钉、企业微信——引导式配置,不用找文档

整个过程不需要打开终端,不需要输入任何命令,跟安装普通软件一样。

装好之后能做什么

你说体验了技术同事的龙虾,感觉厉害——但可能还没感受到它最厉害的地方:主动干活。

它不只是回答你问题的聊天窗口,它可以:

- 每天早上自动帮你整理信息摘要,发到飞书

- 盯着你的邮件,重要的立刻提醒

- 接入飞书之后,可以直接帮你回消息、整理内容

- 设好规则,它在后台帮你处理重复性的信息工作

市场部门用好了,竞品追踪、行业资讯整理、日报周报这些事可以省掉大量时间。

注册还有福利

getaclaw.ai 注册之后会送百万免费 Token,够你把各种功能都摸一遍,不需要先掏钱就能正式体验完整能力。

试试吧,真的是给市场/运营/非技术同学专门准备的入口。装上之后有什么问题欢迎在评论区问。🦞

还有各位看官们提个小醒:我们这个送token的福利不定啥时候结束,早点注册可以早点享受福利哦

提到在 Mac 上跑本地大模型,很多人第一反应是 Ollama。但如果你追求极致的推理速度,并且想运行最新架构的模型(比如多模态小钢炮 Qwen3.5-4B),苹果官方主导的 MLX 框架才是终极答案!

本文将手把手教你如何用 MLX 在 Mac 上部署最新的 Qwen3.5-4B-MLX-4bit 模型,并将其封装成完美兼容 OpenAI 格式的后台 API,最后丝滑接入 OpenClaw。

⚠️ 高能预警:部署最新模型往往伴随着无尽的环境报错。本文记录了我在配置过程中踩过的所有大坑,如果你遇到 command not found、model not supported 等玄学问题,看这一篇就够了!

很多小白上来就直接 pip install,结果遇到一堆类似 site-packages is not writeable 的权限报错,或者装完后终端提示 zsh: command not found。

原因:Mac 自带的 Python 版本太老(通常是 3.9),而最新的 AI 框架强制要求 Python 3.10 以上。

正确姿势:使用 Homebrew 安装 Python 3.12,并创建一个干净的虚拟环境!

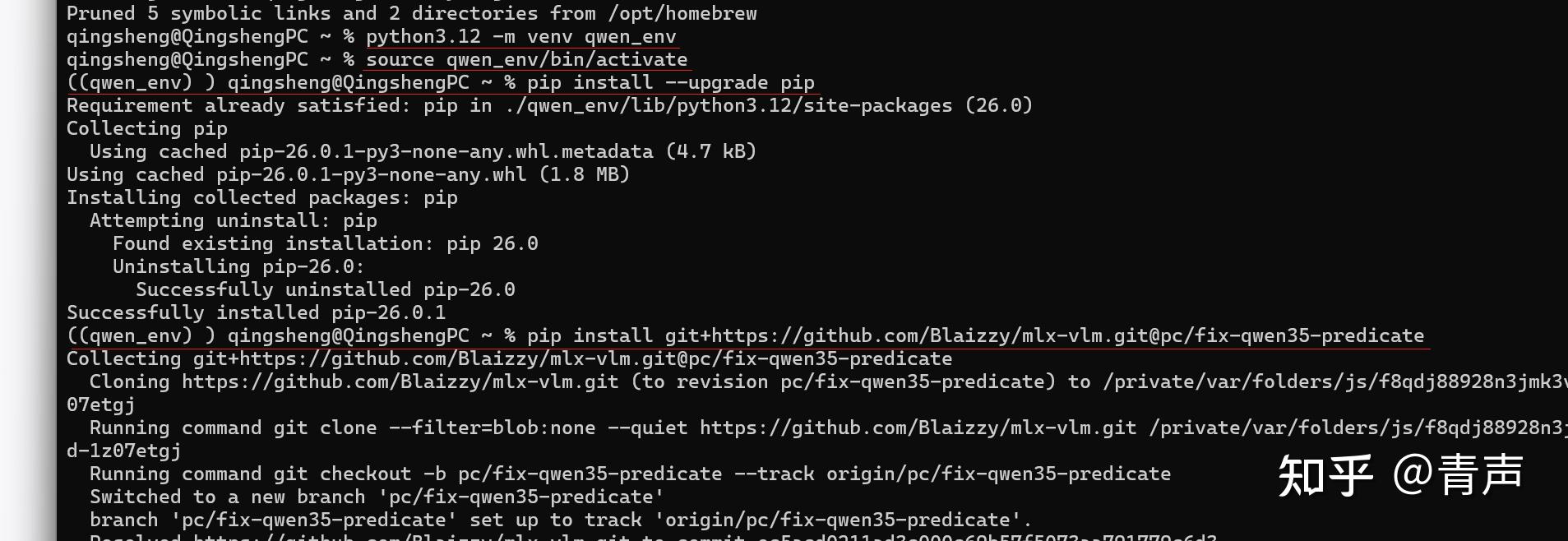

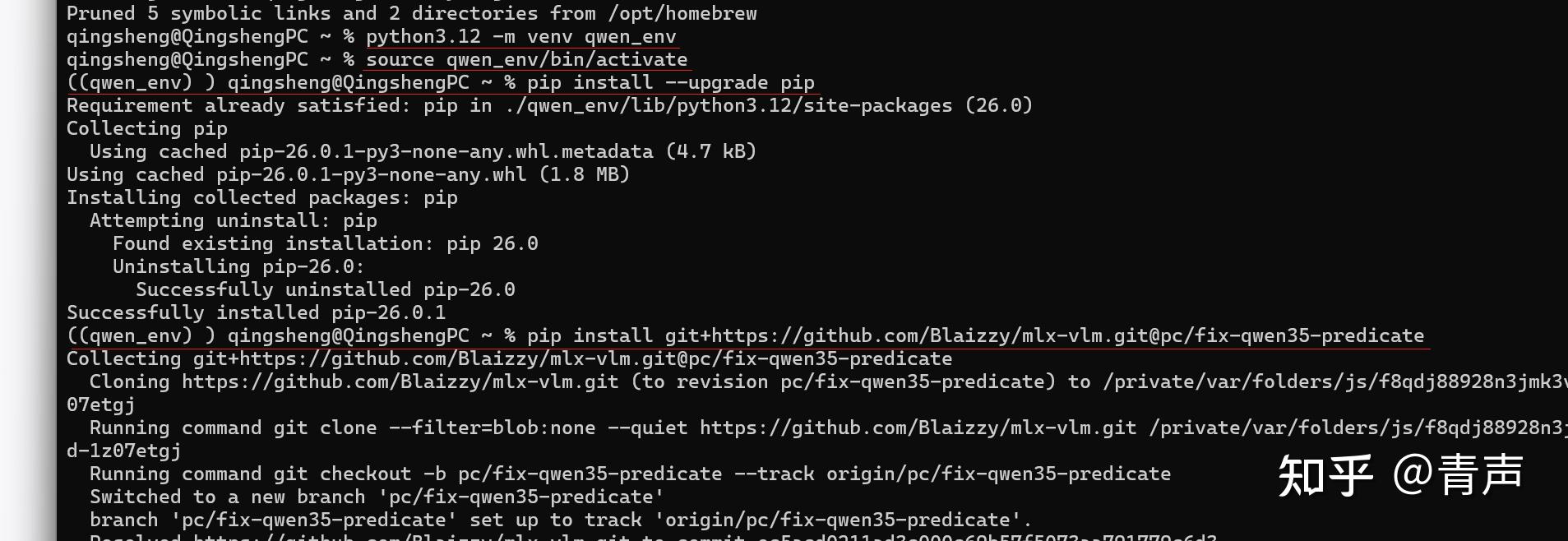

brew install python@3.12打开终端,依次执行:

# 1. 创建名为 qwen_env 的虚拟环境 python3.12 -m venv qwen_env # 2. 激活虚拟环境 source qwen_env/bin/activate # 3. 升级基础工具 pip install --upgrade pip💡

提示:执行完后,你的终端提示符最左边会出现

(qwen_env)字样,说明你已经进入了安全的“沙盒”。

我们要运行的模型是 mlx-community/Qwen3.5-4B-MLX-4bit。

Qwen 3.5 是一个支持视觉的多模态模型(VLM)。如果你习惯性地安装纯文本框架 mlx-lm,连模型都无法加载。必须使用 mlx-vlm。

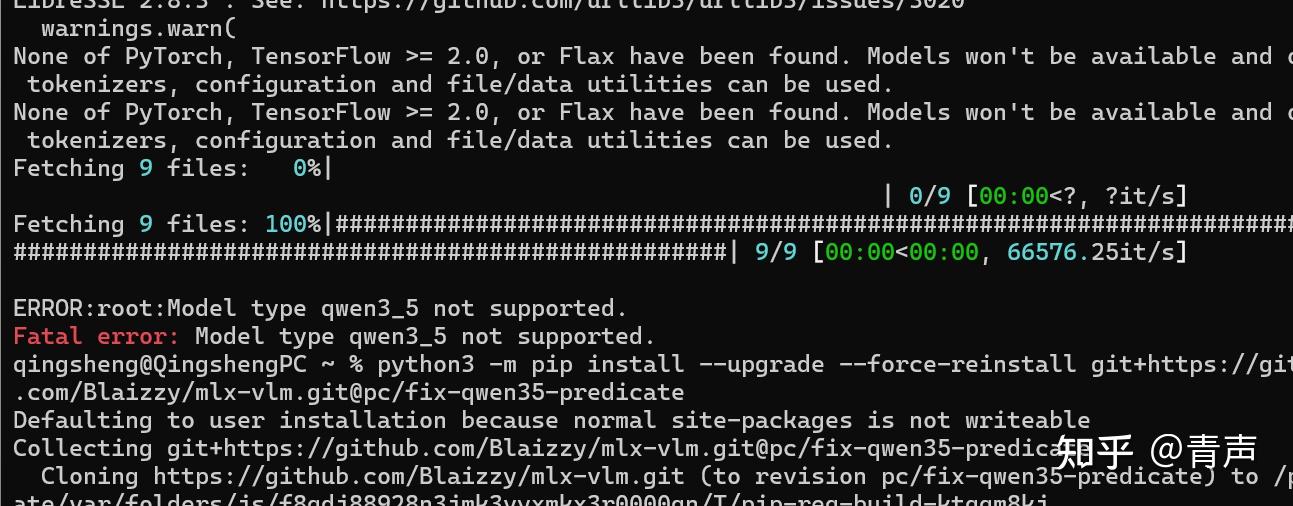

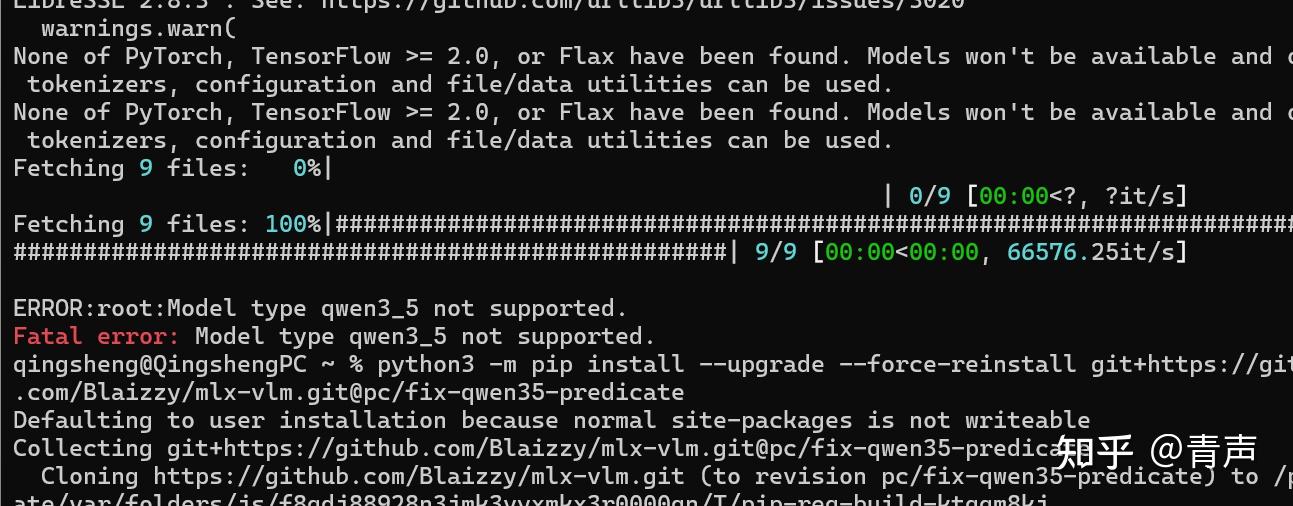

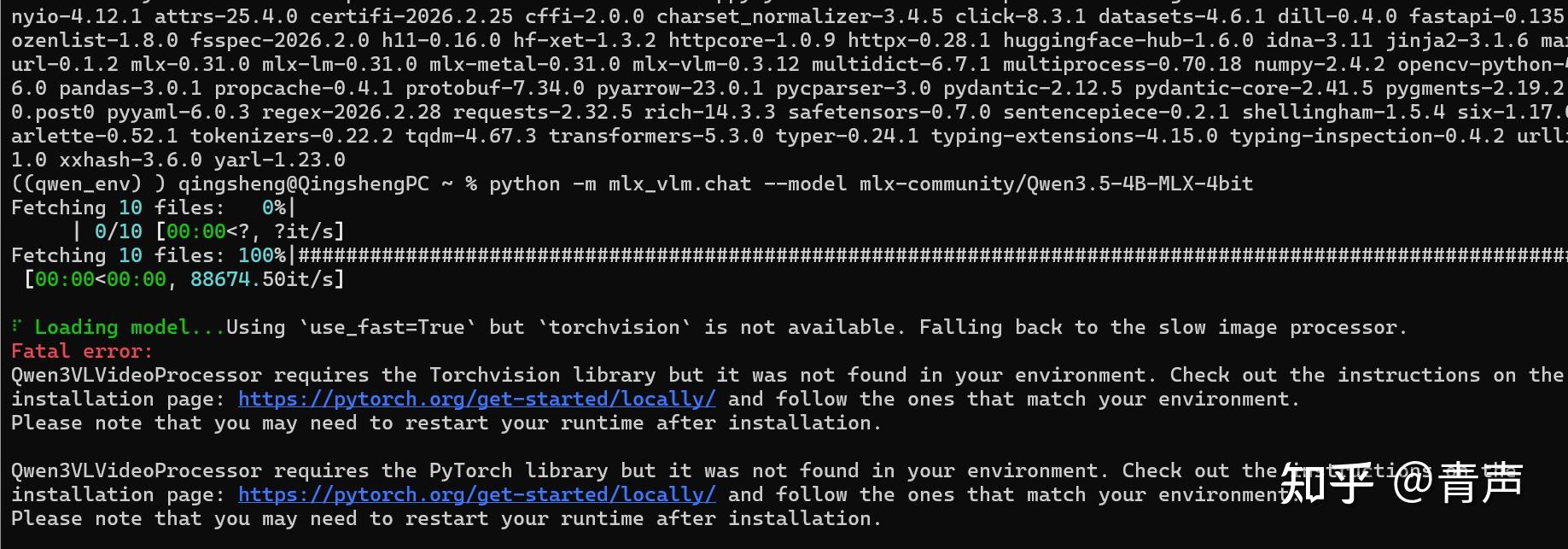

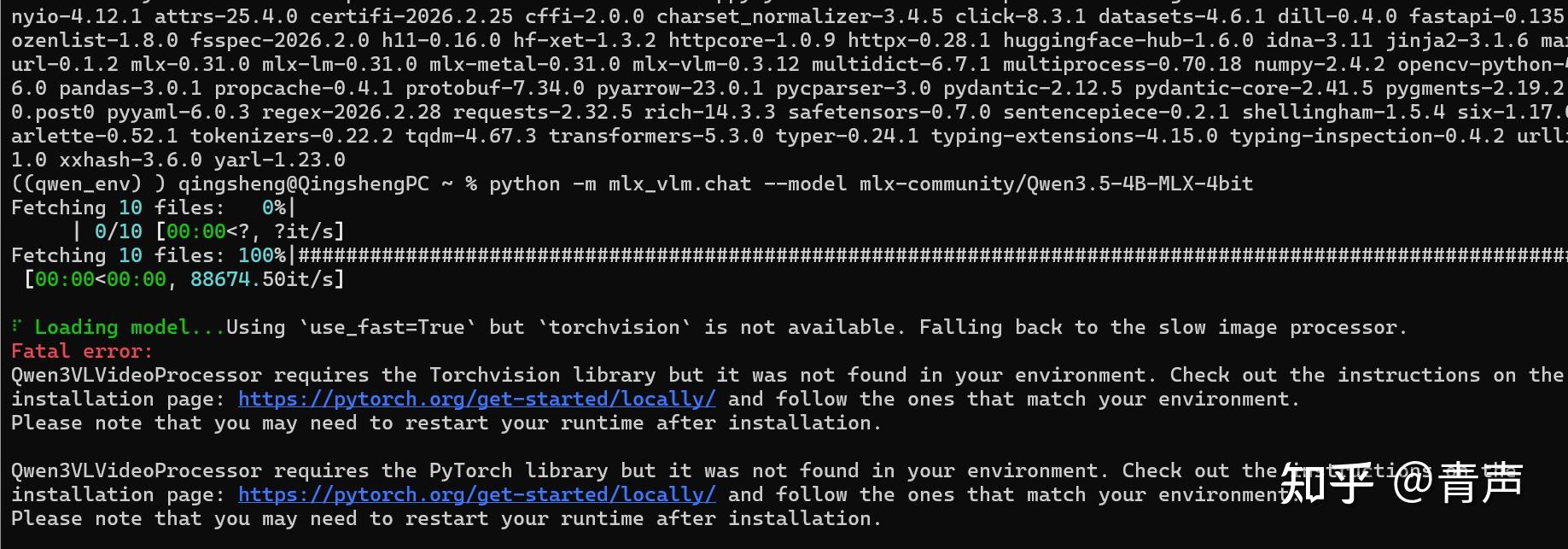

如果你直接 pip install mlx-vlm,运行模型时大概率会遇到这个报错。

原因:Qwen 3.5 架构太新了,官方稳定版代码库还没来得及合并支持!

解法:我们需要直接从开发者的测试分支安装抢先版。

在虚拟环境中运行:

pip install git+https://github.com/Blaizzy/mlx-vlm.git@pc/fix-qwen35-predicate装完框架后运行,又弹出一堆:requires the Torchvision library...

原因:既然是多模态模型,Hugging Face 的图片处理器底层强依赖 PyTorch,而我们的纯净环境里没有。

解法:顺手把图像处理的依赖补齐:

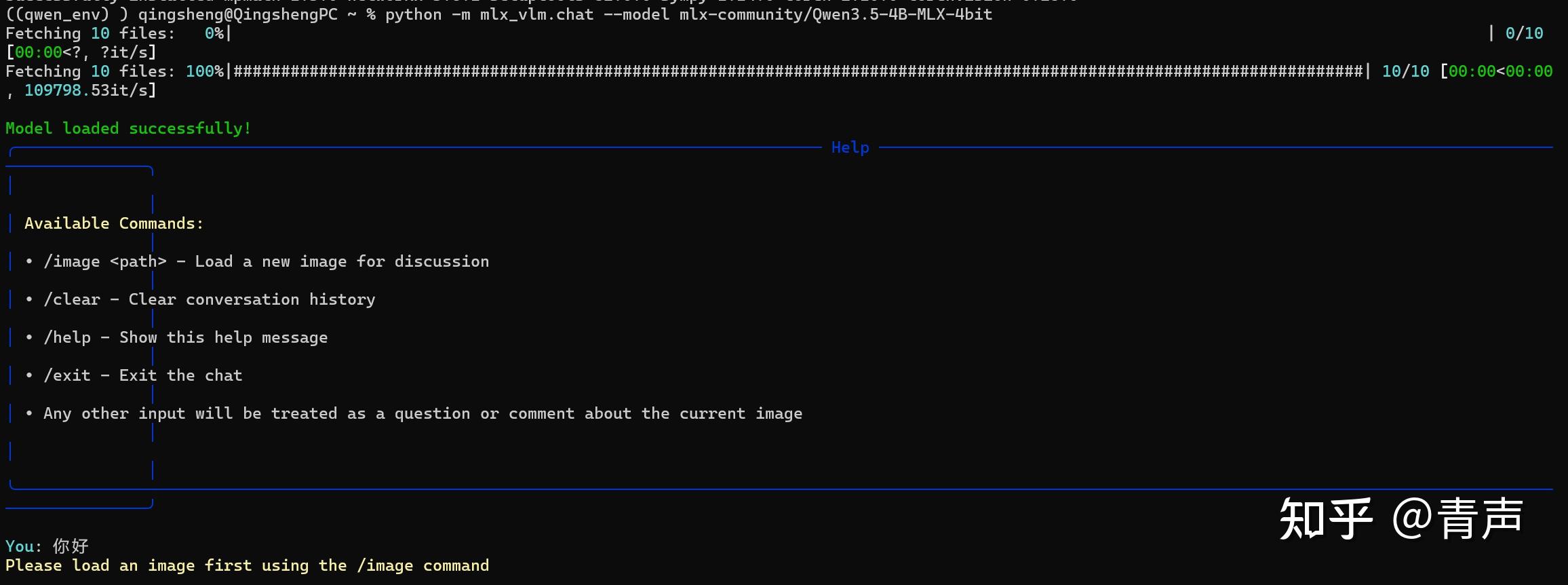

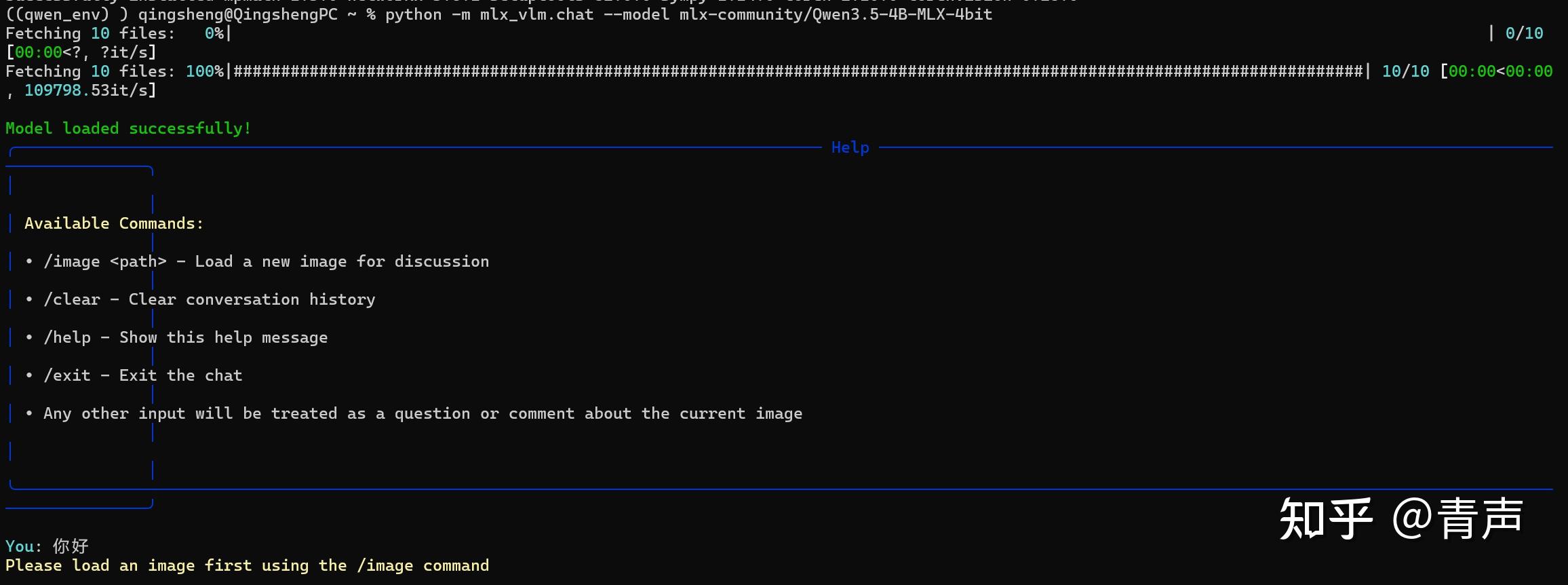

pip install torch torchvision环境终于配齐了,我们先用命令行测试一下模型能否正常对话。运行:

export HF_ENDPOINT=https://hf-mirror.com # 设置国内镜像站环境变量,如有梯子可忽略此步骤 python -m mlx_vlm.chat --model mlx-community/Qwen3.5-4B-MLX-4bit(首次运行会自动从 Hugging Face 下载约 3GB 的模型权重,速度极快,耐心等待进度条走完。)

⚠️小贴士1:如果遇到ConnectionError,不要慌!在命令前加上export HF_ENDPOINT=https://hf-mirror.com。这就像给你的下载器换了一条高速公路,实测下载速度能从几 KB 直接飙升到几十 MB。

⚠️ 小贴士2: 加载成功后,命令行可能会提示 Please load an image first。别慌!这是因为测试脚本默认你要测“看图说话”。我们直接无视,输入 /exit 退出即可。因为我们真正的目的是启动纯文本 API 服务。

如果每次都要打开一个黑框框终端来启动 API,那也太不优雅了。关掉窗口还会导致服务断线。

Mac 系统自带了极其强大的进程管理工具 launchd,我们可以把模型做成一个原生的系统后台服务!

mlx_vlm 的 API Server 采用的是动态加载(Dynamic Loading)机制。它启动时只是个“空壳”,收到带模型名字的请求时才会去加载模型。如果启动命令里硬塞 --model 参数,会直接报错退出。

打开终端(不需要进虚拟环境),直接一次性复制粘贴下面这段代码并回车,这会在你的系统里生成一个服务配置文件:

⚠️

注意:请把下方代码里的所有

/Users/你的用户名替换成你 Mac 真正的电脑用户名路径(例如

/Users/zhangsan)!

cat << 'EOF' > ~/Library/LaunchAgents/com.local.qwen-server.plist <?xml version="1.0" encoding="UTF-8"?> <!DOCTYPE plist PUBLIC "-//Apple//DTD PLIST 1.0//EN" "http://www.apple.com/DTDs/PropertyList-1.0.dtd"> <plist version="1.0"> <dict> <key>Label</key> <string>com.local.qwen-server</string> <key>ProgramArguments</key> <array> <!-- 这里一定要写你虚拟环境中的 python 绝对路径 --> <string>/Users/你的用户名/qwen_env/bin/python</string> <string>-m</string> <string>mlx_vlm.server</string> <string>--port</string> <string>8080</string> <string>--trust-remote-code</string> </array> <key>RunAtLoad</key> <true/> <key>KeepAlive</key> <true/> <key>StandardOutPath</key> <string>/Users/你的用户名/qwen_server.log</string> <key>StandardErrorPath</key> <string>/Users/你的用户名/qwen_server_error.log</string> </dict> </plist> EOF接着,激活这个服务:

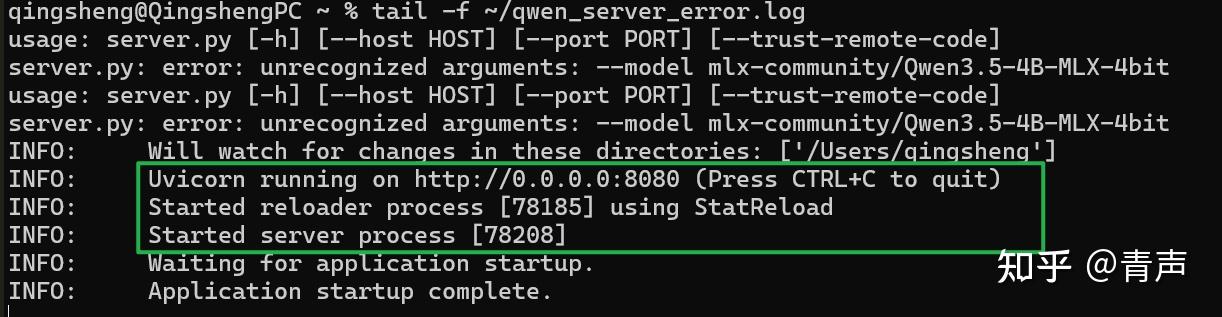

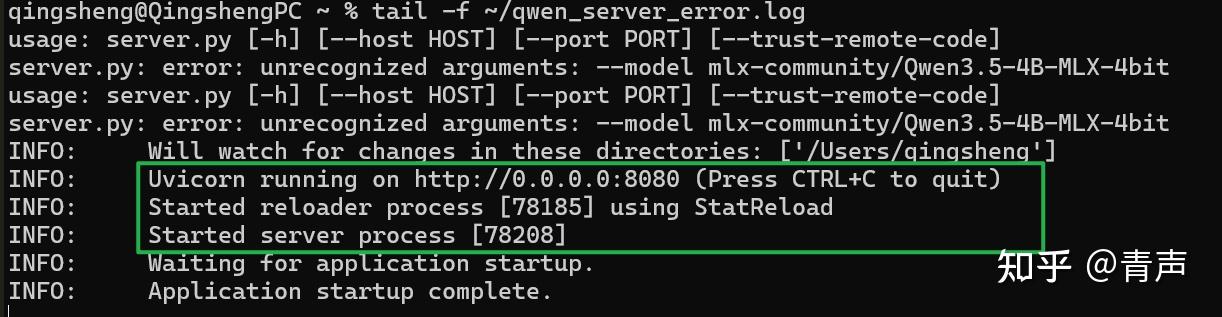

launchctl load ~/Library/LaunchAgents/com.local.qwen-server.plist至此,你的 Qwen API 已经默默在后台 http://127.0.0.1:8080 运行了,开机自启,崩溃自动重启,且完全不占你的 Dock 栏!

想要看运行日志?输入 tail -f ~/qwen_server.log 即可。

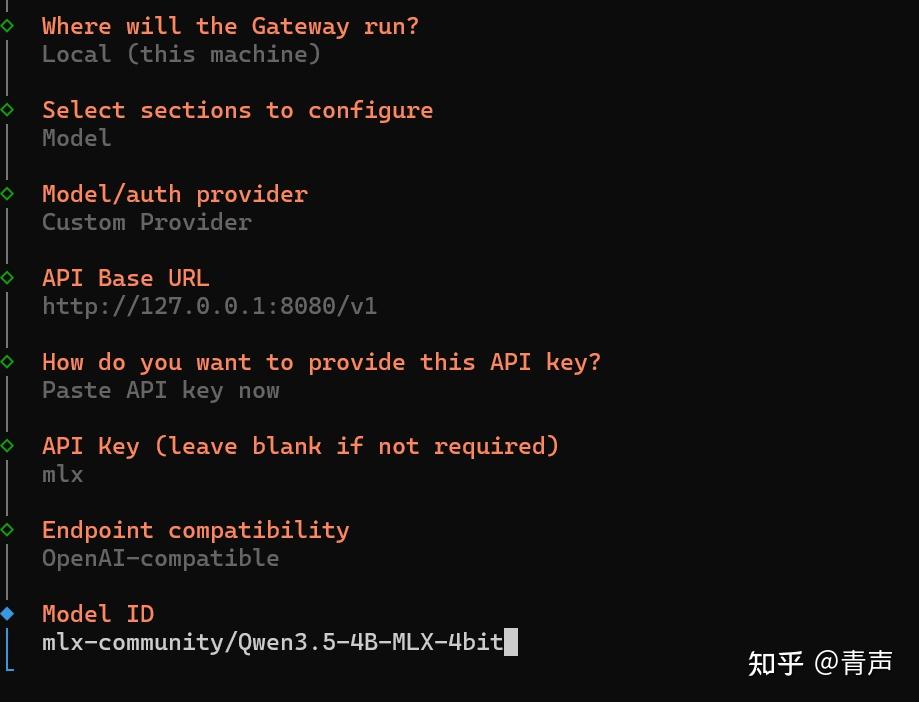

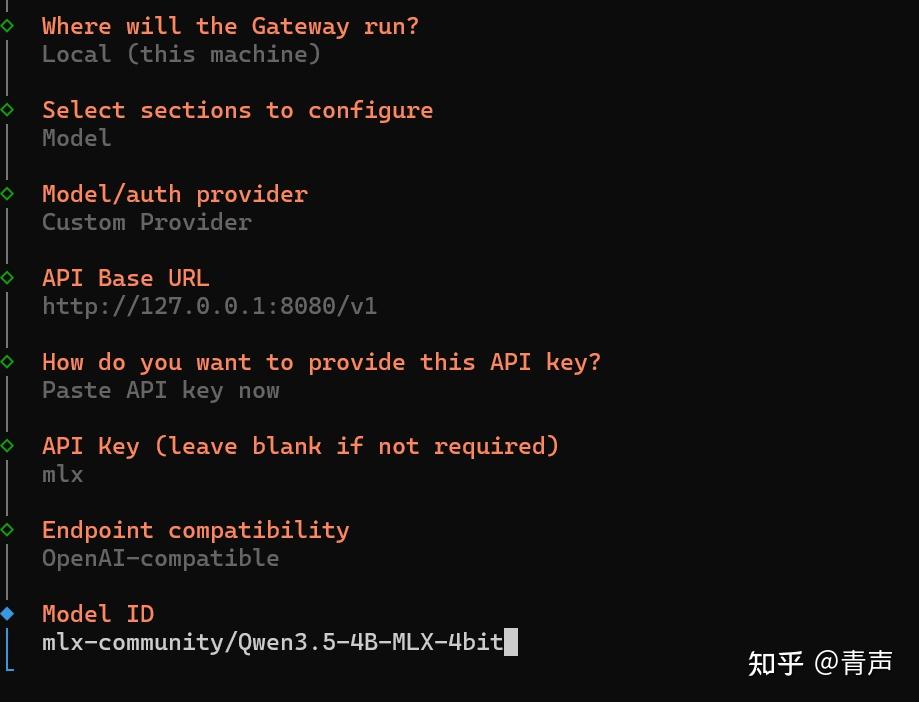

现在,万事俱备,打开 OpenClaw 的配置界面,填入你的本地最强辅助:

- API Provider (服务商):

OpenAI或Custom OpenAI - Base URL (接口地址):

常规填写:

http://127.0.0.1:8080/ 或 http://127.0.0.1:8080/v1 - ⚠️ 史诗级天坑:如果你的 OpenClaw 是用 Docker 容器运行的,千万别写

127.0.0.1,必须写http://host.docker.internal:8080/(这是 Docker 访问宿主机的专属通道)。 - API Key (密钥): 随便填(例如

mlx)。 - Model Name (模型名称): 必须一字不差地填写

mlx-community/Qwen3.5-4B-MLX-4bit。

💡 必看的“冷启动”科普

配置完成后,当你在 OpenClaw 发出第一句问候时,可能会卡住几秒甚至十几秒。别慌,没死机! 这是因为 API 服务平时处于“零显存占用”状态,收到请求时正在从硬盘把 3GB 的模型搬运到 Mac 的统一内存里。第一句回复出来后,模型就常驻内存了,接下来的对话则会正常!

https://

huggingface.co/mlx-comm

unity/models

这篇文章基于 2026.03.11 的实际可用流程整理,当前已验证:

- • macOS:可用

- • Windows:可用

- • Linux:暂未验证

要让 openClaw 在本地运行,首先需要安装两个基础环境:

- • Git:用于拉取、更新 openClaw 项目代码

- • Node.js:用于运行 openClaw,安装后的

npm命令也是必须的

- • macOS 一般自带 Git

- • Windows 需要自行安装

下载地址:

https://git-scm.com/download/win

Node.js 需要手动安装,官网地址:

https://nodejs.org/en/download

openClaw 要求 Node.js 版本必须在

22+

建议直接安装

24.x 版本即可,小版本差异基本可以忽略。

打开终端(Terminal),依次执行以下命令:

node -v git --version如果返回结果正常,则说明环境已经准备完成。

v24.xx.xx git version 2.xx.x- • 如果

node -v低于 22,需要切换 Node 版本 - • 如果

git --version报错,说明 Git 没有安装成功

确认上面的 Git 和 Node.js 都安装完成后,再继续下面的步骤。

openClaw 是开源项目,安装本质上就是从 GitHub 拉取代码并运行。

因此你必须先确认下面这个地址可以正常打开:

https://github.com/openclaw/openclaw

如果这个地址都打不开,那么后续安装基本也走不通。

- • macOS:直接搜索

Terminal - • Windows:建议以管理员身份运行终端,避免后续权限问题

这里有两个常见坑:

curl -fsSL https://openclaw.ai/install.sh | bash npm i -g openclawiwr -useb https://openclaw.ai/install.ps1 | iex执行后会看到一系列安装输出,不需要完全看懂,等待执行完成即可。

如果过程中卡住,常见原因一般有:

- • 权限不足

- • 某些基础命令未安装

- • 网络问题

- • npm 缓存异常

- • 未使用合适的镜像源

- •

←→:切换 Yes / No - •

↑↓:切换选项 - •

Enter:确认 - •

Space:多选时勾选

建议按下面的方式选择:

| 配置项 | 建议选择 | 说明 |

| Onboarding mode | QuickStart | 快速开始 |

| Config handling | Reset | 除非你之前已经配置过很多内容,否则建议重置 |

| Model/auth provider | 选免费 Qwen 或 Skip for now | 建议先选 Qwen,后续再切其他模型 |

| Model configured | qwen-portal/coder-model | 如果前一步选了 Qwen,通常会出现这个 |

| Default model | Keep current | 保持默认 |

| Select channel (QuickStart) | Skip for now | 渠道后面再配置 |

| Configure skills now? | No | 技能先不配,后续按需加 |

| Enable hooks? | 全选 | 使用空格勾选后回车 |

| How do you want to hatch your bot? | Web UI 或 TUI | 建议新手选 Web UI |

安装完成后,在终端输入:

openclaw dashboard然后就会打开 openClaw 的 Web 管理界面。

到这里,说明 openClaw 已经成功在本地运行起来了。

如果你准备先用 Qwen,需要先配置千问的 API Key。

进入阿里云百炼控制台:

https://bailian.console.aliyun.com/cn-beijing/?tab=api#/api

登录后创建并复制 API Key。

拿到 API Key 之后,需要更新 openClaw 的配置文件,重点改下面两个地方:

- •

models.providers.qwen-portal.apiKey - •

agents.defaults.workspace

其中:

- •

apiKey:替换成你刚刚生成的千问 API Key - •

workspace:替换成你的实际工作空间目录

- • macOS / Linux 默认:

/Users/你的用户名/.openclaw/workspace- • Windows 默认:

C:\Users\你的用户名\.openclaw\workspace如果目录不存在,一般会自动创建。

有时你在 Web UI 里保存 JSON 后,页面不会立即刷新,甚至会出现:

- •

disconnect 1006: no reason - • 一直显示

updating

这通常不是配置真的失败,而是前端界面没有及时刷新。

也就是说:实际配置可能已经写入成功了,只是 UI 没显示出来。

如果你熟悉终端操作,建议优先通过本地配置文件或终端方式修改,而不是完全依赖 Web UI。

不要整段无脑复制粘贴

重点只改:

- •

models.providers.qwen-portal.apiKey - •

agents.defaults.workspace

其他字段尽量不要动。

{ "meta": { "lastTouchedVersion": "2026.2.25", "lastTouchedAt": "2026-02-26T12:51:37.823Z" }, "wizard": { "lastRunAt": "2026-02-26T12:51:37.794Z", "lastRunCommand": "doctor", "lastRunVersion": "2026.2.25", "lastRunMode": "local" }, "auth": { "profiles": { "qwen-portal:default": { "provider": "qwen-portal", "mode": "oauth" } } }, "models": { "providers": { "qwen-portal": { "baseUrl": "https://portal.qwen.ai/v1", "apiKey": "<QWEN_API_KEY>", "api": "openai-completions", "models": [ { "id": "coder-model", "name": "Qwen Coder", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": , "maxTokens": 8192 }, { "id": "vision-model", "name": "Qwen Vision", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": , "maxTokens": 8192 } ] } } }, "agents": { "defaults": { "model": { "primary": "qwen-portal/coder-model" }, "models": { "qwen-portal/coder-model": { "alias": "qwen" }, "qwen-portal/vision-model": {} }, "workspace": "<你的工作空间目录>", "compaction": { "mode": "safeguard" }, "maxConcurrent": 1, "subagents": { "maxConcurrent": 2 } }, "messages": { "ackReactionScope": "group-mentions" }, "commands": { "native": "auto", "nativeSkills": "auto", "restart": true, "ownerDisplay": "raw" }, "session": { "dmScope": "per-channel-peer" }, "gateway": { "mode": "local", "port": 18789, "bind": "loopback", "auth": { "mode": "token", "token": "__OPENCLAW_REDACTED__" }, "tailscale": { "mode": "off", "resetOnExit": false }, "nodes": { "denyCommands": [ "camera.snap", "camera.clip", "screen.record", "calendar.add", "contacts.add", "reminders.add" ] } } } }回到 chat 页面,直接发消息测试即可。

如果能正常对话,说明模型配置已经生效。

很多教程会说 openClaw 可以自动搜索并安装各种 skill,这本身没错。

但如果你直接让它走默认搜索逻辑,有时会调用 web_search,这又依赖额外的搜索引擎 API Key,结果就会失败。

直接告诉它:

不要用 web_search,直接用 clawhub search/install 来安装 skills这样通常更稳。

如果你希望 openClaw 不只是运行在本地 Web UI,而是能通过飞书来对话,可以继续配置飞书渠道。

openclaw plugins install @openclaw/feishu安装完成后,在 openClaw 的 Channels 列表里应该能看到飞书渠道。

地址:

https://open.feishu.cn/?lang=zh-CN

在飞书开放平台里:

- 1. 进入开发者后台

- 2. 创建企业自建应用

- 3. 获取

App ID和App Secret - 4. 填入 openClaw 的飞书渠道配置中

在权限管理中,搜索并开通:

im:message给应用添加机器人能力。

进入“版本与管理”,创建并发布一个版本,例如:

1.0.0进入:

- • 事件与回调

- • 事件配置

- • 添加订阅方式

- • 选择长连接

完成配置后,回到飞书 App,搜索你创建的机器人名称,即可尝试发消息。

如果你在飞书里发消息后,机器人始终不回复,或者提示:

access not configured一般是以下原因:

- • DM policy 没有设置为

open - • 你的飞书账号没有被授权

这时执行配对命令:

openclaw pairing approve feishu xxx --notify其中 xxx 是 openClaw 自动生成的、限时有效的配对码。

优先排查:

- • 网络是否正常

- • GitHub 是否能访问

- • npm 是否存在缓存问题

- • 是否有权限问题

- • macOS 是否缺少 brew

可能是 UI 状态未刷新,先不要急着反复改。

尽量只改必要字段,如果改乱了,可以尝试 Reload 重置。

如果默认调用了 web_search,通常会因为没配置搜索引擎 API 而失败。

建议明确指定:

不要用 web_search,直接用 clawhub search/install 来安装 skills重点检查:

- • 应用是否已经发布版本

- • 是否已添加机器人能力

- • 是否开通了

im:message - • 是否完成配对授权

- • DM policy 是否为

open

openclaw dashboardopenclaw plugins install @openclaw/feishuopenclaw pairing approve feishu xxx --notify到这里,你就已经完成了 openClaw 的本地部署主流程:

- 1. 安装 Git 和 Node.js

- 2. 安装 openClaw

- 3. 初始化基础配置

- 4. 配置 Qwen API Key

- 5. 启动 dashboard

- 6. 按需安装 skill

- 7. 按需接入飞书

- • App ID / App Secret

- • 权限

- • 事件订阅

- • 发布版本

- • 配对授权

这些步骤配完整。

发布者:Ai探索者,转载请注明出处:https://javaforall.net/252982.html原文链接:https://javaforall.net